mirror of

https://github.com/apachecn/ailearning.git

synced 2026-04-24 18:42:25 +08:00

修改中文符号为英文

This commit is contained in:

@@ -12,15 +12,15 @@

|

||||

|

||||

## 机器学习 研究意义

|

||||

|

||||

机器学习是一门人工智能的科学,该领域的主要研究对象是人工智能,特别是如何在经验学习中改善具体算法的性能”。 “机器学习是对能通过经验自动改进的计算机算法的研究”。 “机器学习是用数据或以往的经验,以此优化计算机程序的性能标准。” 一种经常引用的英文定义是:A computer program is said to learn from experience E with respect to some class of tasks T and performance measure P, if its performance at tasks in T, as measured by P, improves with experience E.

|

||||

机器学习是一门人工智能的科学,该领域的主要研究对象是人工智能,特别是如何在经验学习中改善具体算法的性能”。 “机器学习是对能通过经验自动改进的计算机算法的研究”。 “机器学习是用数据或以往的经验,以此优化计算机程序的性能标准。” 一种经常引用的英文定义是: A computer program is said to learn from experience E with respect to some class of tasks T and performance measure P, if its performance at tasks in T, as measured by P, improves with experience E.

|

||||

|

||||

机器学习已经有了十分广泛的应用,例如:数据挖掘、计算机视觉、自然语言处理、生物特征识别、搜索引擎、医学诊断、检测信用卡欺诈、证券市场分析、DNA序列测序、语音和手写识别、战略游戏和机器人运用。

|

||||

机器学习已经有了十分广泛的应用,例如: 数据挖掘、计算机视觉、自然语言处理、生物特征识别、搜索引擎、医学诊断、检测信用卡欺诈、证券市场分析、DNA序列测序、语音和手写识别、战略游戏和机器人运用。

|

||||

## 机器学习 场景

|

||||

|

||||

* 例如:识别动物猫

|

||||

* 模式识别(官方标准):人们通过大量的经验,得到结论,从而判断它就是猫。

|

||||

* 机器学习(数据学习):人们通过阅读进行学习,观察它会叫、小眼睛、两只耳朵、四条腿、一条尾巴,得到结论,从而判断它就是猫。

|

||||

* 深度学习(深入数据):人们通过深入了解它,发现它会'喵喵'的叫、与同类的猫科动物很类似,得到结论,从而判断它就是猫。(深度学习常用领域:语音识别、图像识别)

|

||||

* 例如: 识别动物猫

|

||||

* 模式识别(官方标准): 人们通过大量的经验,得到结论,从而判断它就是猫。

|

||||

* 机器学习(数据学习): 人们通过阅读进行学习,观察它会叫、小眼睛、两只耳朵、四条腿、一条尾巴,得到结论,从而判断它就是猫。

|

||||

* 深度学习(深入数据): 人们通过深入了解它,发现它会'喵喵'的叫、与同类的猫科动物很类似,得到结论,从而判断它就是猫。(深度学习常用领域: 语音识别、图像识别)

|

||||

|

||||

* 模式识别(pattern recognition): 模式识别是最古老的(作为一个术语而言,可以说是很过时的)。

|

||||

* 我们把环境与客体统称为“模式”,识别是对模式的一种认知,是如何让一个计算机程序去做一些看起来很“智能”的事情。

|

||||

@@ -32,12 +32,12 @@

|

||||

* 深度学习(deep learning): 深度学习是非常崭新和有影响力的前沿领域,我们甚至不会去思考-后深度学习时代。

|

||||

* 深度学习是机器学习研究中的一个新的领域,其动机在于建立、模拟人脑进行分析学习的神经网络,它模仿人脑的机制来解释数据,例如图像,声音和文本。

|

||||

|

||||

* 参考地址:

|

||||

* 参考地址:

|

||||

* [深度学习 vs 机器学习 vs 模式识别](http://www.csdn.net/article/2015-03-24/2824301)

|

||||

* [深度学习 百科资料](http://baike.baidu.com/link?url=76P-uA4EBrC3G-I__P1tqeO7eoDS709Kp4wYuHxc7GNkz_xn0NxuAtEohbpey7LUa2zUQLJxvIKUx4bnrEfOmsWLKbDmvG1PCoRkJisMTQka6-QReTrIxdYY3v93f55q)

|

||||

|

||||

|

||||

> 机器学习已应用于多个领域,远远超出大多数人的想象,横跨:计算机科学、工程技术和统计学等多个学科。

|

||||

> 机器学习已应用于多个领域,远远超出大多数人的想象,横跨: 计算机科学、工程技术和统计学等多个学科。

|

||||

|

||||

* 搜索引擎: 根据你的搜索点击,优化你下次的搜索结果,是机器学习来帮助搜索引擎判断哪个结果更适合你(也判断哪个广告更适合你)。

|

||||

* 垃圾邮件: 会自动的过滤垃圾广告邮件到垃圾箱内。

|

||||

@@ -50,37 +50,37 @@

|

||||

|

||||

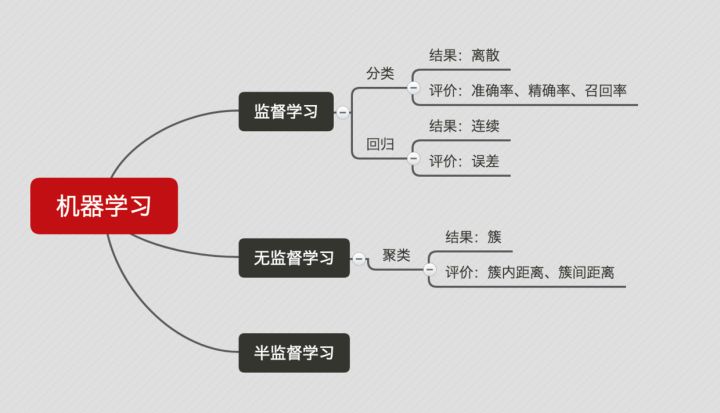

### 主要任务

|

||||

|

||||

* 分类(classification):将实例数据划分到合适的类别中。

|

||||

* 应用实例:判断网站是否被黑客入侵(二分类 ),手写数字的自动识别(多分类)

|

||||

* 回归(regression):主要用于预测数值型数据。

|

||||

* 应用实例:股票价格波动的预测,房屋价格的预测等。

|

||||

* 分类(classification): 将实例数据划分到合适的类别中。

|

||||

* 应用实例: 判断网站是否被黑客入侵(二分类 ),手写数字的自动识别(多分类)

|

||||

* 回归(regression): 主要用于预测数值型数据。

|

||||

* 应用实例: 股票价格波动的预测,房屋价格的预测等。

|

||||

|

||||

### 监督学习(supervised learning)

|

||||

|

||||

* 必须确定目标变量的值,以便机器学习算法可以发现特征和目标变量之间的关系。在监督学习中,给定一组数据,我们知道正确的输出结果应该是什么样子,并且知道在输入和输出之间有着一个特定的关系。 (包括:分类和回归)

|

||||

* 样本集:训练数据 + 测试数据

|

||||

* 必须确定目标变量的值,以便机器学习算法可以发现特征和目标变量之间的关系。在监督学习中,给定一组数据,我们知道正确的输出结果应该是什么样子,并且知道在输入和输出之间有着一个特定的关系。 (包括: 分类和回归)

|

||||

* 样本集: 训练数据 + 测试数据

|

||||

* 训练样本 = 特征(feature) + 目标变量(label: 分类-离散值/回归-连续值)

|

||||

* 特征通常是训练样本集的列,它们是独立测量得到的。

|

||||

* 目标变量: 目标变量是机器学习预测算法的测试结果。

|

||||

* 在分类算法中目标变量的类型通常是标称型(如:真与假),而在回归算法中通常是连续型(如:1~100)。

|

||||

* 监督学习需要注意的问题:

|

||||

* 在分类算法中目标变量的类型通常是标称型(如: 真与假),而在回归算法中通常是连续型(如: 1~100)。

|

||||

* 监督学习需要注意的问题:

|

||||

* 偏置方差权衡

|

||||

* 功能的复杂性和数量的训练数据

|

||||

* 输入空间的维数

|

||||

* 噪声中的输出值

|

||||

* `知识表示`:

|

||||

* 可以采用规则集的形式【例如:数学成绩大于90分为优秀】

|

||||

* 可以采用概率分布的形式【例如:通过统计分布发现,90%的同学数学成绩,在70分以下,那么大于70分定为优秀】

|

||||

* 可以使用训练样本集中的一个实例【例如:通过样本集合,我们训练出一个模型实例,得出 年轻,数学成绩中高等,谈吐优雅,我们认为是优秀】

|

||||

* `知识表示`:

|

||||

* 可以采用规则集的形式【例如: 数学成绩大于90分为优秀】

|

||||

* 可以采用概率分布的形式【例如: 通过统计分布发现,90%的同学数学成绩,在70分以下,那么大于70分定为优秀】

|

||||

* 可以使用训练样本集中的一个实例【例如: 通过样本集合,我们训练出一个模型实例,得出 年轻,数学成绩中高等,谈吐优雅,我们认为是优秀】

|

||||

|

||||

### 非监督学习(unsupervised learing)

|

||||

|

||||

* 在机器学习,无监督学习的问题是,在未加标签的数据中,试图找到隐藏的结构。因为提供给学习者的实例是未标记的,因此没有错误或报酬信号来评估潜在的解决方案。

|

||||

* 无监督学习是密切相关的统计数据密度估计的问题。然而无监督学习还包括寻求,总结和解释数据的主要特点等诸多技术。在无监督学习使用的许多方法是基于用于处理数据的数据挖掘方法。

|

||||

* 数据没有类别信息,也不会给定目标值。

|

||||

* 非监督学习包括的类型:

|

||||

* 聚类:在无监督学习中,将数据集分成由类似的对象组成多个类的过程称为聚类。

|

||||

* 密度估计:通过样本分布的紧密程度,来估计与分组的相似性。

|

||||

* 非监督学习包括的类型:

|

||||

* 聚类: 在无监督学习中,将数据集分成由类似的对象组成多个类的过程称为聚类。

|

||||

* 密度估计: 通过样本分布的紧密程度,来估计与分组的相似性。

|

||||

* 此外,无监督学习还可以减少数据特征的维度,以便我们可以使用二维或三维图形更加直观地展示数据信息。

|

||||

### 强化学习

|

||||

这个算法可以训练程序做出某一决定。程序在某一情况下尝试所有的可能行动,记录不同行动的结果并试着找出最好的一次尝试来做决定。 属于这一类算法的有马尔可夫决策过程。

|

||||

@@ -127,54 +127,54 @@

|

||||

### Python语言

|

||||

|

||||

1. 可执行伪代码

|

||||

2. Python比较流行:使用广泛、代码范例多、丰富模块库,开发周期短

|

||||

3. Python语言的特色:清晰简练、易于理解

|

||||

4. Python语言的缺点:唯一不足的是性能问题

|

||||

2. Python比较流行: 使用广泛、代码范例多、丰富模块库,开发周期短

|

||||

3. Python语言的特色: 清晰简练、易于理解

|

||||

4. Python语言的缺点: 唯一不足的是性能问题

|

||||

5. Python相关的库

|

||||

* 科学函数库:`SciPy`、`NumPy`(底层语言:C和Fortran)

|

||||

* 绘图工具库:`Matplotlib`

|

||||

* 科学函数库: `SciPy`、`NumPy`(底层语言: C和Fortran)

|

||||

* 绘图工具库: `Matplotlib`

|

||||

* 数据分析库 `Pandas`

|

||||

### 数学工具

|

||||

* Matlab

|

||||

## 附:机器学习专业术语

|

||||

* 模型(model):计算机层面的认知

|

||||

## 附: 机器学习专业术语

|

||||

* 模型(model): 计算机层面的认知

|

||||

* 学习算法(learning algorithm),从数据中产生模型的方法

|

||||

* 数据集(data set):一组记录的合集

|

||||

* 示例(instance):对于某个对象的描述

|

||||

* 样本(sample):也叫示例

|

||||

* 属性(attribute):对象的某方面表现或特征

|

||||

* 特征(feature):同属性

|

||||

* 属性值(attribute value):属性上的取值

|

||||

* 属性空间(attribute space):属性张成的空间

|

||||

* 样本空间/输入空间(samplespace):同属性空间

|

||||

* 特征向量(feature vector):在属性空间里每个点对应一个坐标向量,把一个示例称作特征向量

|

||||

* 维数(dimensionality):描述样本参数的个数(也就是空间是几维的)

|

||||

* 学习(learning)/训练(training):从数据中学得模型

|

||||

* 训练数据(training data):训练过程中用到的数据

|

||||

* 数据集(data set): 一组记录的合集

|

||||

* 示例(instance): 对于某个对象的描述

|

||||

* 样本(sample): 也叫示例

|

||||

* 属性(attribute): 对象的某方面表现或特征

|

||||

* 特征(feature): 同属性

|

||||

* 属性值(attribute value): 属性上的取值

|

||||

* 属性空间(attribute space): 属性张成的空间

|

||||

* 样本空间/输入空间(samplespace): 同属性空间

|

||||

* 特征向量(feature vector): 在属性空间里每个点对应一个坐标向量,把一个示例称作特征向量

|

||||

* 维数(dimensionality): 描述样本参数的个数(也就是空间是几维的)

|

||||

* 学习(learning)/训练(training): 从数据中学得模型

|

||||

* 训练数据(training data): 训练过程中用到的数据

|

||||

* 训练样本(training sample):训练用到的每个样本

|

||||

* 训练集(training set):训练样本组成的集合

|

||||

* 假设(hypothesis):学习模型对应了关于数据的某种潜在规则

|

||||

* 训练集(training set): 训练样本组成的集合

|

||||

* 假设(hypothesis): 学习模型对应了关于数据的某种潜在规则

|

||||

* 真相(ground-truth):真正存在的潜在规律

|

||||

* 学习器(learner):模型的另一种叫法,把学习算法在给定数据和参数空间的实例化

|

||||

* 预测(prediction):判断一个东西的属性

|

||||

* 标记(label):关于示例的结果信息,比如我是一个“好人”。

|

||||

* 样例(example):拥有标记的示例

|

||||

* 标记空间/输出空间(label space):所有标记的集合

|

||||

* 分类(classification):预测是离散值,比如把人分为好人和坏人之类的学习任务

|

||||

* 回归(regression):预测值是连续值,比如你的好人程度达到了0.9,0.6之类的

|

||||

* 二分类(binary classification):只涉及两个类别的分类任务

|

||||

* 正类(positive class):二分类里的一个

|

||||

* 反类(negative class):二分类里的另外一个

|

||||

* 多分类(multi-class classification):涉及多个类别的分类

|

||||

* 测试(testing):学习到模型之后对样本进行预测的过程

|

||||

* 测试样本(testing sample):被预测的样本

|

||||

* 聚类(clustering):把训练集中的对象分为若干组

|

||||

* 簇(cluster):每一个组叫簇

|

||||

* 监督学习(supervised learning):典范--分类和回归

|

||||

* 无监督学习(unsupervised learning):典范--聚类

|

||||

* 未见示例(unseen instance):“新样本“,没训练过的样本

|

||||

* 泛化(generalization)能力:学得的模型适用于新样本的能力

|

||||

* 分布(distribution):样本空间的全体样本服从的一种规律

|

||||

* 学习器(learner): 模型的另一种叫法,把学习算法在给定数据和参数空间的实例化

|

||||

* 预测(prediction): 判断一个东西的属性

|

||||

* 标记(label): 关于示例的结果信息,比如我是一个“好人”。

|

||||

* 样例(example): 拥有标记的示例

|

||||

* 标记空间/输出空间(label space): 所有标记的集合

|

||||

* 分类(classification): 预测是离散值,比如把人分为好人和坏人之类的学习任务

|

||||

* 回归(regression): 预测值是连续值,比如你的好人程度达到了0.9,0.6之类的

|

||||

* 二分类(binary classification): 只涉及两个类别的分类任务

|

||||

* 正类(positive class): 二分类里的一个

|

||||

* 反类(negative class): 二分类里的另外一个

|

||||

* 多分类(multi-class classification): 涉及多个类别的分类

|

||||

* 测试(testing): 学习到模型之后对样本进行预测的过程

|

||||

* 测试样本(testing sample): 被预测的样本

|

||||

* 聚类(clustering): 把训练集中的对象分为若干组

|

||||

* 簇(cluster): 每一个组叫簇

|

||||

* 监督学习(supervised learning): 典范--分类和回归

|

||||

* 无监督学习(unsupervised learning): 典范--聚类

|

||||

* 未见示例(unseen instance): “新样本“,没训练过的样本

|

||||

* 泛化(generalization)能力: 学得的模型适用于新样本的能力

|

||||

* 分布(distribution): 样本空间的全体样本服从的一种规律

|

||||

* 独立同分布(independent and identically distributed,简称i,i,d.):获得的每个样本都是独立地从这个分布上采样获得的。

|

||||

|

||||

## 机器学习基础补充

|

||||

@@ -187,10 +187,10 @@

|

||||

|

||||

### 模型拟合程度

|

||||

|

||||

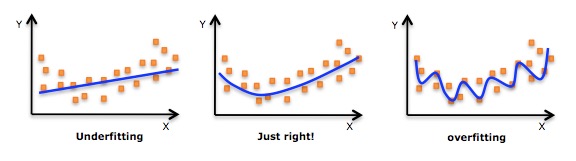

* 欠拟合(Underfitting):模型没有很好地捕捉到数据特征,不能够很好地拟合数据,对训练样本的一般性质尚未学好。类比,光看书不做题觉得自己什么都会了,上了考场才知道自己啥都不会。

|

||||

* 过拟合(Overfitting):模型把训练样本学习“太好了”,可能把一些训练样本自身的特性当做了所有潜在样本都有的一般性质,导致泛化能力下降。类比,做课后题全都做对了,超纲题也都认为是考试必考题目,上了考场还是啥都不会。

|

||||

* 欠拟合(Underfitting): 模型没有很好地捕捉到数据特征,不能够很好地拟合数据,对训练样本的一般性质尚未学好。类比,光看书不做题觉得自己什么都会了,上了考场才知道自己啥都不会。

|

||||

* 过拟合(Overfitting): 模型把训练样本学习“太好了”,可能把一些训练样本自身的特性当做了所有潜在样本都有的一般性质,导致泛化能力下降。类比,做课后题全都做对了,超纲题也都认为是考试必考题目,上了考场还是啥都不会。

|

||||

|

||||

通俗来说,欠拟合和过拟合都可以用一句话来说,欠拟合就是:“你太天真了!”,过拟合就是:“你想太多了!”。

|

||||

通俗来说,欠拟合和过拟合都可以用一句话来说,欠拟合就是: “你太天真了!”,过拟合就是: “你想太多了!”。

|

||||

|

||||

### 常见的模型指标

|

||||

|

||||

@@ -198,22 +198,22 @@

|

||||

* 召回率 —— 提取出的正确信息条数 / 样本中的信息条数

|

||||

* F 值 —— 正确率 * 召回率 * 2 / (正确率 + 召回率)(F值即为正确率和召回率的调和平均值)

|

||||

|

||||

举个例子如下:

|

||||

举个例子如下:

|

||||

|

||||

举个例子如下:

|

||||

举个例子如下:

|

||||

某池塘有 1400 条鲤鱼,300 只虾,300 只乌龟。现在以捕鲤鱼为目的。撒了一张网,逮住了 700 条鲤鱼,200 只

|

||||

虾, 100 只乌龟。那么这些指标分别如下:

|

||||

虾, 100 只乌龟。那么这些指标分别如下:

|

||||

正确率 = 700 / (700 + 200 + 100) = 70%

|

||||

召回率 = 700 / 1400 = 50%

|

||||

F 值 = 70% * 50% * 2 / (70% + 50%) = 58.3%

|

||||

|

||||

### 模型

|

||||

|

||||

* 分类问题 —— 说白了就是将一些未知类别的数据分到现在已知的类别中去。比如,根据你的一些信息,判断你是高富帅,还是穷屌丝。评判分类效果好坏的三个指标就是上面介绍的三个指标:正确率,召回率,F值。

|

||||

* 分类问题 —— 说白了就是将一些未知类别的数据分到现在已知的类别中去。比如,根据你的一些信息,判断你是高富帅,还是穷屌丝。评判分类效果好坏的三个指标就是上面介绍的三个指标: 正确率,召回率,F值。

|

||||

* 回归问题 —— 对数值型连续随机变量进行预测和建模的监督学习算法。回归往往会通过计算 误差(Error)来确定模型的精确性。

|

||||

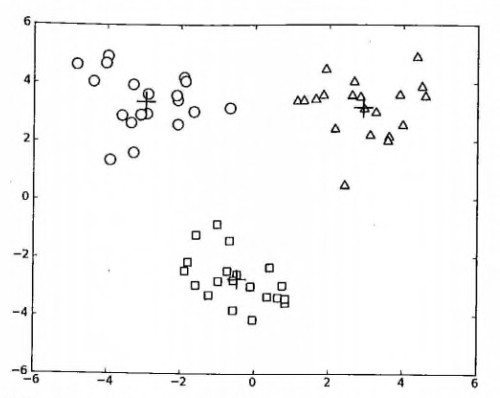

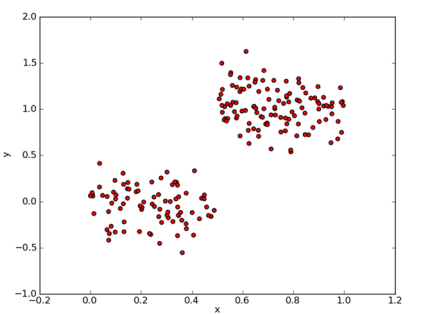

* 聚类问题 —— 聚类是一种无监督学习任务,该算法基于数据的内部结构寻找观察样本的自然族群(即集群)。聚类问题的标准一般基于距离:簇内距离(Intra-cluster Distance) 和 簇间距离(Inter-cluster Distance) 。簇内距离是越小越好,也就是簇内的元素越相似越好;而簇间距离越大越好,也就是说簇间(不同簇)元素越不相同越好。一般的,衡量聚类问题会给出一个结合簇内距离和簇间距离的公式。

|

||||

* 聚类问题 —— 聚类是一种无监督学习任务,该算法基于数据的内部结构寻找观察样本的自然族群(即集群)。聚类问题的标准一般基于距离: 簇内距离(Intra-cluster Distance) 和 簇间距离(Inter-cluster Distance) 。簇内距离是越小越好,也就是簇内的元素越相似越好;而簇间距离越大越好,也就是说簇间(不同簇)元素越不相同越好。一般的,衡量聚类问题会给出一个结合簇内距离和簇间距离的公式。

|

||||

|

||||

下面这个图可以比较直观地展示出来:

|

||||

下面这个图可以比较直观地展示出来:

|

||||

|

||||

|

||||

|

||||

@@ -223,17 +223,17 @@ F 值 = 70% * 50% * 2 / (70% + 50%) = 58.3%

|

||||

|

||||

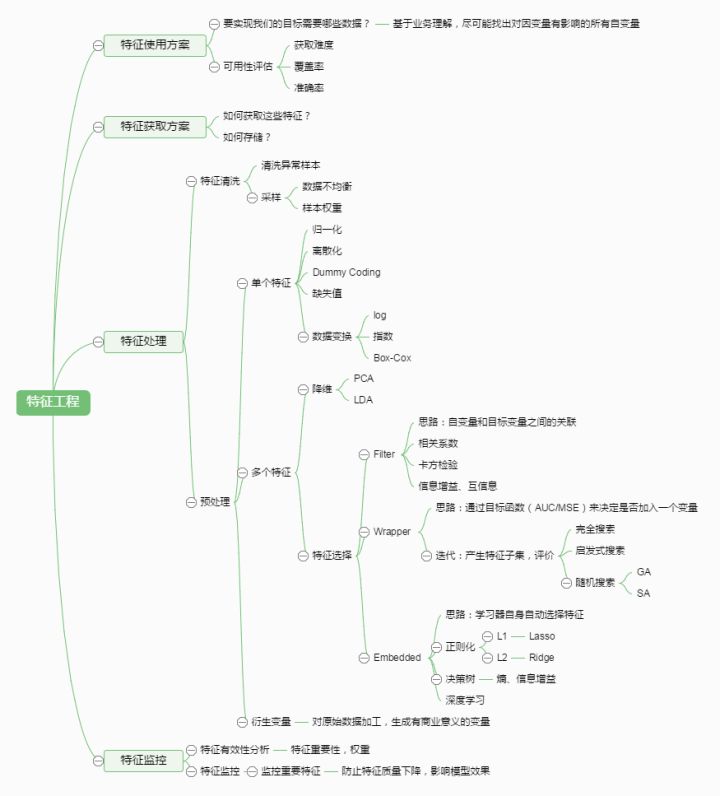

* 特征提取 —— 特征提取是计算机视觉和图像处理中的一个概念。它指的是使用计算机提取图像信息,决定每个图像的点是否属于一个图像特征。特征提取的结果是把图像上的点分为不同的子集,这些子集往往属于孤立的点,连续的曲线或者连续的区域。

|

||||

|

||||

下面给出一个特征工程的图:

|

||||

下面给出一个特征工程的图:

|

||||

|

||||

|

||||

|

||||

### 其他

|

||||

|

||||

* Learning rate —— 学习率,通俗地理解,可以理解为步长,步子大了,很容易错过最佳结果。就是本来目标尽在咫尺,可是因为我迈的步子很大,却一下子走过了。步子小了呢,就是同样的距离,我却要走很多很多步,这样导致训练的耗时费力还不讨好。

|

||||

* 一个总结的知识点很棒的链接 :https://zhuanlan.zhihu.com/p/25197792

|

||||

* 一个总结的知识点很棒的链接 : https://zhuanlan.zhihu.com/p/25197792

|

||||

|

||||

* * *

|

||||

|

||||

* **作者:[片刻](http://cwiki.apachecn.org/display/~jiangzhonglian) [1988](http://cwiki.apachecn.org/display/~lihuisong)**

|

||||

* **作者: [片刻](http://cwiki.apachecn.org/display/~jiangzhonglian) [1988](http://cwiki.apachecn.org/display/~lihuisong)**

|

||||

* [GitHub地址](https://github.com/apachecn/AiLearning): <https://github.com/apachecn/AiLearning>

|

||||

* **版权声明:欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

* **版权声明: 欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

|

||||

@@ -1,15 +1,26 @@

|

||||

|

||||

# 第 10 章 K-Means(K-均值)聚类算法

|

||||

|

||||

|

||||

|

||||

## 聚类

|

||||

|

||||

聚类,简单来说,就是将一个庞杂数据集中具有相似特征的数据自动归类到一起,称为一个簇,簇内的对象越相似,聚类的效果越好。它是一种无监督的学习(Unsupervised Learning)方法,不需要预先标注好的训练集。聚类与分类最大的区别就是分类的目标事先已知,例如猫狗识别,你在分类之前已经预先知道要将它分为猫、狗两个种类;而在你聚类之前,你对你的目标是未知的,同样以动物为例,对于一个动物集来说,你并不清楚这个数据集内部有多少种类的动物,你能做的只是利用聚类方法将它自动按照特征分为多类,然后人为给出这个聚类结果的定义(即簇识别)。例如,你将一个动物集分为了三簇(类),然后通过观察这三类动物的特征,你为每一个簇起一个名字,如大象、狗、猫等,这就是聚类的基本思想。

|

||||

|

||||

至于“相似”这一概念,是利用距离这个评价标准来衡量的,我们通过计算对象与对象之间的距离远近来判断它们是否属于同一类别,即是否是同一个簇。至于距离如何计算,科学家们提出了许多种距离的计算方法,其中欧式距离是最为简单和常用的,除此之外还有曼哈顿距离和余弦相似性距离等。

|

||||

|

||||

欧式距离,我想大家再熟悉不过了,但为免有一些基础薄弱的同学,在此再说明一下,它的定义为:

|

||||

对于x点(坐标为(x1,x2,x3,...,xn))和 y点(坐标为(y1,y2,y3,...,yn)),两者的欧式距离为

|

||||

|

||||

欧式距离,我想大家再熟悉不过了,但为免有一些基础薄弱的同学,在此再说明一下,它的定义为:

|

||||

对于x点坐标为(x1,x2,x3,...,xn)和 y点坐标为(y1,y2,y3,...,yn),两者的欧式距离为:

|

||||

|

||||

$$

|

||||

d(x,y)

|

||||

={\sqrt{

|

||||

(x_{1}-y_{1})^{2}+(x_{2}-y_{2})^{2} + \cdots +(x_{n}-y_{n})^{2}

|

||||

}}

|

||||

={\sqrt{

|

||||

\sum_{ {i=1} }^{n}(x_{i}-y_{i})^{2}

|

||||

}}

|

||||

$$

|

||||

|

||||

在二维平面,它就是我们初中时就学过的两点距离公式

|

||||

|

||||

## K-Means 算法

|

||||

@@ -68,12 +79,12 @@ kmeans,如前所述,用于数据集内种类属性不明晰,希望能够

|

||||

### K-Means 开发流程

|

||||

|

||||

```

|

||||

收集数据:使用任意方法

|

||||

准备数据:需要数值型数据类计算距离, 也可以将标称型数据映射为二值型数据再用于距离计算

|

||||

分析数据:使用任意方法

|

||||

训练算法:不适用于无监督学习,即无监督学习不需要训练步骤

|

||||

测试算法:应用聚类算法、观察结果.可以使用量化的误差指标如误差平方和(后面会介绍)来评价算法的结果.

|

||||

使用算法:可以用于所希望的任何应用.通常情况下, 簇质心可以代表整个簇的数据来做出决策.

|

||||

收集数据: 使用任意方法

|

||||

准备数据: 需要数值型数据类计算距离, 也可以将标称型数据映射为二值型数据再用于距离计算

|

||||

分析数据: 使用任意方法

|

||||

训练算法: 不适用于无监督学习,即无监督学习不需要训练步骤

|

||||

测试算法: 应用聚类算法、观察结果.可以使用量化的误差指标如误差平方和(后面会介绍)来评价算法的结果.

|

||||

使用算法: 可以用于所希望的任何应用.通常情况下, 簇质心可以代表整个簇的数据来做出决策.

|

||||

```

|

||||

### K-Means 的评价标准

|

||||

k-means算法因为手动选取k值和初始化随机质心的缘故,每一次的结果不会完全一样,而且由于手动选取k值,我们需要知道我们选取的k值是否合理,聚类效果好不好,那么如何来评价某一次的聚类效果呢?也许将它们画在图上直接观察是最好的办法,但现实是,我们的数据不会仅仅只有两个特征,一般来说都有十几个特征,而观察十几维的空间对我们来说是一个无法完成的任务。因此,我们需要一个公式来帮助我们判断聚类的性能,这个公式就是**SSE** (Sum of Squared Error, 误差平方和 ),它其实就是每一个点到其簇内质心的距离的平方值的总和,这个数值对应kmeans函数中**clusterAssment**矩阵的第一列之和。 **SSE**值越小表示数据点越接近于它们的质心,聚类效果也越好。 因为对误差取了平方,因此更加重视那些远离中心的点。一种肯定可以降低**SSE**值的方法是增加簇的个数,但这违背了聚类的目标。聚类的目标是在保持簇数目不变的情况下提高簇的质量。

|

||||

@@ -166,7 +177,7 @@ def kMeans(dataSet, k, distMeas=distEclud, createCent=randCent):

|

||||

|

||||

为了保持簇总数不变,可以将某两个簇进行合并。从上图中很明显就可以看出,应该将上图下部两个出错的簇质心进行合并。那么问题来了,我们可以很容易对二维数据上的聚类进行可视化, 但是如果遇到40维的数据应该如何去做?

|

||||

|

||||

有两种可以量化的办法:合并最近的质心,或者合并两个使得**SSE**增幅最小的质心。 第一种思路通过计算所有质心之间的距离, 然后合并距离最近的两个点来实现。第二种方法需要合并两个簇然后计算总**SSE**值。必须在所有可能的两个簇上重复上述处理过程,直到找到合并最佳的两个簇为止。

|

||||

有两种可以量化的办法: 合并最近的质心,或者合并两个使得**SSE**增幅最小的质心。 第一种思路通过计算所有质心之间的距离, 然后合并距离最近的两个点来实现。第二种方法需要合并两个簇然后计算总**SSE**值。必须在所有可能的两个簇上重复上述处理过程,直到找到合并最佳的两个簇为止。

|

||||

|

||||

因为上述后处理过程实在是有些繁琐,所以有更厉害的大佬提出了另一个称之为二分K-均值(bisecting K-Means)的算法.

|

||||

|

||||

@@ -206,7 +217,7 @@ def biKMeans(dataSet, k, distMeas=distEclud):

|

||||

sseSplit = sum(splitClustAss[:,1]) # 将二分 kMeans 结果中的平方和的距离进行求和

|

||||

sseNotSplit = sum(clusterAssment[nonzero(clusterAssment[:,0].A!=i)[0],1]) # 将未参与二分 kMeans 分配结果中的平方和的距离进行求和

|

||||

print "sseSplit, and notSplit: ",sseSplit,sseNotSplit

|

||||

if (sseSplit + sseNotSplit) < lowestSSE: # 总的(未拆分和已拆分)误差和越小,越相似,效果越优化,划分的结果更好(注意:这里的理解很重要,不明白的地方可以和我们一起讨论)

|

||||

if (sseSplit + sseNotSplit) < lowestSSE: # 总的(未拆分和已拆分)误差和越小,越相似,效果越优化,划分的结果更好(注意: 这里的理解很重要,不明白的地方可以和我们一起讨论)

|

||||

bestCentToSplit = i

|

||||

bestNewCents = centroidMat

|

||||

bestClustAss = splitClustAss.copy()

|

||||

@@ -230,6 +241,6 @@ def biKMeans(dataSet, k, distMeas=distEclud):

|

||||

运行参考结果如下:

|

||||

|

||||

|

||||

* **作者:[那伊抹微笑](http://cwiki.apachecn.org/display/~xuxin), [清都江水郎](http://cwiki.apachecn.org/display/~xuzhaoqing)**

|

||||

* **作者: [那伊抹微笑](http://cwiki.apachecn.org/display/~xuxin), [清都江水郎](http://cwiki.apachecn.org/display/~xuzhaoqing)**

|

||||

* [GitHub地址](https://github.com/apachecn/AiLearning): <https://github.com/apachecn/AiLearning>

|

||||

* **版权声明:欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

* **版权声明: 欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

@@ -47,20 +47,20 @@

|

||||

Apriori 算法优缺点

|

||||

|

||||

```

|

||||

* 优点:易编码实现

|

||||

* 缺点:在大数据集上可能较慢

|

||||

* 适用数据类型:数值型 或者 标称型数据。

|

||||

* 优点: 易编码实现

|

||||

* 缺点: 在大数据集上可能较慢

|

||||

* 适用数据类型: 数值型 或者 标称型数据。

|

||||

```

|

||||

|

||||

Apriori 算法流程步骤:

|

||||

Apriori 算法流程步骤:

|

||||

|

||||

```

|

||||

* 收集数据:使用任意方法。

|

||||

* 准备数据:任何数据类型都可以,因为我们只保存集合。

|

||||

* 分析数据:使用任意方法。

|

||||

* 训练数据:使用Apiori算法来找到频繁项集。

|

||||

* 测试算法:不需要测试过程。

|

||||

* 使用算法:用于发现频繁项集以及物品之间的关联规则。

|

||||

* 收集数据: 使用任意方法。

|

||||

* 准备数据: 任何数据类型都可以,因为我们只保存集合。

|

||||

* 分析数据: 使用任意方法。

|

||||

* 训练数据: 使用Apiori算法来找到频繁项集。

|

||||

* 测试算法: 不需要测试过程。

|

||||

* 使用算法: 用于发现频繁项集以及物品之间的关联规则。

|

||||

```

|

||||

|

||||

## Apriori 算法的使用

|

||||

@@ -288,7 +288,7 @@ def apriori(dataSet, minSupport=0.5):

|

||||

# 计算可信度(confidence)

|

||||

def calcConf(freqSet, H

|

||||

, supportData, brl, minConf=0.7):

|

||||

"""calcConf(对两个元素的频繁项,计算可信度,例如: {1,2}/{1} 或者 {1,2}/{2} 看是否满足条件)

|

||||

"""calcConf(对两个元素的频繁项,计算可信度,例如: {1,2}/{1} 或者 {1,2}/{2} 看是否满足条件)

|

||||

|

||||

Args:

|

||||

freqSet 频繁项集中的元素,例如: frozenset([1, 3])

|

||||

@@ -369,7 +369,7 @@ def generateRules(L, supportData, minConf=0.7):

|

||||

for i in range(1, len(L)):

|

||||

# 获取频繁项集中每个组合的所有元素

|

||||

for freqSet in L[i]:

|

||||

# 假设:freqSet= frozenset([1, 3]), H1=[frozenset([1]), frozenset([3])]

|

||||

# 假设: freqSet= frozenset([1, 3]), H1=[frozenset([1]), frozenset([3])]

|

||||

# 组合总的元素并遍历子元素,并转化为 frozenset 集合,再存放到 list 列表中

|

||||

H1 = [frozenset([item]) for item in freqSet]

|

||||

# 2 个的组合,走 else, 2 个以上的组合,走 if

|

||||

@@ -382,15 +382,15 @@ def generateRules(L, supportData, minConf=0.7):

|

||||

|

||||

到这里为止,通过调用 generateRules 函数即可得出我们所需的 `关联规则`。

|

||||

|

||||

* 分级法: 频繁项集->关联规则

|

||||

* 分级法: 频繁项集->关联规则

|

||||

* 1.首先从一个频繁项集开始,接着创建一个规则列表,其中规则右部分只包含一个元素,然后对这个规则进行测试。

|

||||

* 2.接下来合并所有剩余规则来创建一个新的规则列表,其中规则右部包含两个元素。

|

||||

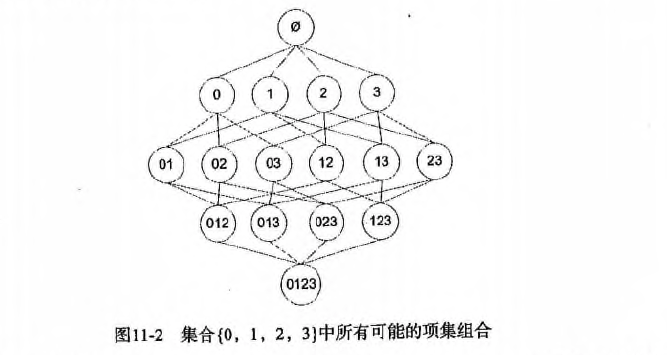

* 如下图:

|

||||

* 如下图:

|

||||

*

|

||||

* 最后: 每次增加频繁项集的大小,Apriori 算法都会重新扫描整个数据集,是否有优化空间呢? 下一章:FP-growth算法等着你的到来

|

||||

* 最后: 每次增加频繁项集的大小,Apriori 算法都会重新扫描整个数据集,是否有优化空间呢? 下一章: FP-growth算法等着你的到来

|

||||

|

||||

* * *

|

||||

|

||||

* **作者:[片刻](https://github.com/jiangzhonglian)**

|

||||

* **作者: [片刻](https://github.com/jiangzhonglian)**

|

||||

* [GitHub地址](https://github.com/apachecn/AiLearning): <https://github.com/apachecn/AiLearning>

|

||||

* **版权声明:欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

* **版权声明: 欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

|

||||

@@ -69,13 +69,13 @@ class treeNode:

|

||||

FP-growth 算法优缺点:

|

||||

|

||||

```

|

||||

* 优点: 1. 因为 FP-growth 算法只需要对数据集遍历两次,所以速度更快。

|

||||

* 优点: 1. 因为 FP-growth 算法只需要对数据集遍历两次,所以速度更快。

|

||||

2. FP树将集合按照支持度降序排序,不同路径如果有相同前缀路径共用存储空间,使得数据得到了压缩。

|

||||

3. 不需要生成候选集。

|

||||

4. 比Apriori更快。

|

||||

* 缺点: 1. FP-Tree第二次遍历会存储很多中间过程的值,会占用很多内存。

|

||||

* 缺点: 1. FP-Tree第二次遍历会存储很多中间过程的值,会占用很多内存。

|

||||

2. 构建FP-Tree是比较昂贵的。

|

||||

* 适用数据类型:标称型数据(离散型数据)。

|

||||

* 适用数据类型: 标称型数据(离散型数据)。

|

||||

```

|

||||

|

||||

|

||||

@@ -97,6 +97,6 @@ if __name__ == "__main__":

|

||||

|

||||

* * *

|

||||

|

||||

* **作者:[mikechengwei](https://github.com/mikechengwei)**

|

||||

* **作者: [mikechengwei](https://github.com/mikechengwei)**

|

||||

* [GitHub地址](https://github.com/apachecn/AiLearning): <https://github.com/apachecn/AiLearning>

|

||||

* **版权声明:欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

* **版权声明: 欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

|

||||

@@ -11,7 +11,7 @@

|

||||

* 人们实时的将显示器上的百万像素转换成为一个三维图像,该图像就给出运动场上球的位置。

|

||||

* 在这个过程中,人们已经将百万像素点的数据,降至为三维。这个过程就称为`降维(dimensionality reduction)`

|

||||

|

||||

> 数据显示 并非大规模特征下的唯一难题,对数据进行简化还有如下一系列的原因:

|

||||

> 数据显示 并非大规模特征下的唯一难题,对数据进行简化还有如下一系列的原因:

|

||||

|

||||

* 1) 使得数据集更容易使用

|

||||

* 2) 降低很多算法的计算开销

|

||||

@@ -26,19 +26,19 @@

|

||||

> 在以下3种降维技术中, PCA的应用目前最为广泛,因此本章主要关注PCA。

|

||||

|

||||

* 1) 主成分分析(Principal Component Analysis, PCA)

|

||||

* `通俗理解:就是找出一个最主要的特征,然后进行分析。`

|

||||

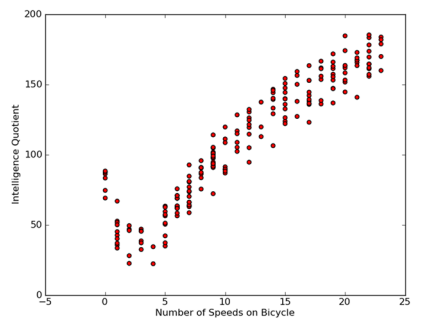

* `例如: 考察一个人的智力情况,就直接看数学成绩就行(存在:数学、语文、英语成绩)`

|

||||

* `通俗理解: 就是找出一个最主要的特征,然后进行分析。`

|

||||

* `例如: 考察一个人的智力情况,就直接看数学成绩就行(存在: 数学、语文、英语成绩)`

|

||||

* 2) 因子分析(Factor Analysis)

|

||||

* `通俗理解:将多个实测变量转换为少数几个综合指标。它反映一种降维的思想,通过降维将相关性高的变量聚在一起,从而减少需要分析的变量的数量,而减少问题分析的复杂性`

|

||||

* `例如: 考察一个人的整体情况,就直接组合3样成绩(隐变量),看平均成绩就行(存在:数学、语文、英语成绩)`

|

||||

* 应用的领域:社会科学、金融和其他领域

|

||||

* `通俗理解: 将多个实测变量转换为少数几个综合指标。它反映一种降维的思想,通过降维将相关性高的变量聚在一起,从而减少需要分析的变量的数量,而减少问题分析的复杂性`

|

||||

* `例如: 考察一个人的整体情况,就直接组合3样成绩(隐变量),看平均成绩就行(存在: 数学、语文、英语成绩)`

|

||||

* 应用的领域: 社会科学、金融和其他领域

|

||||

* 在因子分析中,我们

|

||||

* 假设观察数据的成分中有一些观察不到的隐变量(latent variable)。

|

||||

* 假设观察数据是这些隐变量和某些噪音的线性组合。

|

||||

* 那么隐变量的数据可能比观察数据的数目少,也就说通过找到隐变量就可以实现数据的降维。

|

||||

* 3) 独立成分分析(Independ Component Analysis, ICA)

|

||||

* `通俗理解:ICA 认为观测信号是若干个独立信号的线性组合,ICA 要做的是一个解混过程。`

|

||||

* `例如:我们去ktv唱歌,想辨别唱的是什么歌曲?ICA 是观察发现是原唱唱的一首歌【2个独立的声音(原唱/主唱)】。`

|

||||

* `通俗理解: ICA 认为观测信号是若干个独立信号的线性组合,ICA 要做的是一个解混过程。`

|

||||

* `例如: 我们去ktv唱歌,想辨别唱的是什么歌曲?ICA 是观察发现是原唱唱的一首歌【2个独立的声音(原唱/主唱)】。`

|

||||

* ICA 是假设数据是从 N 个数据源混合组成的,这一点和因子分析有些类似,这些数据源之间在统计上是相互独立的,而在 PCA 中只假设数据是不 相关(线性关系)的。

|

||||

* 同因子分析一样,如果数据源的数目少于观察数据的数目,则可以实现降维过程。

|

||||

|

||||

@@ -47,11 +47,11 @@

|

||||

|

||||

### PCA 概述

|

||||

|

||||

主成分分析(Principal Component Analysis, PCA):`通俗理解:就是找出一个最主要的特征,然后进行分析。`

|

||||

主成分分析(Principal Component Analysis, PCA): `通俗理解: 就是找出一个最主要的特征,然后进行分析。`

|

||||

|

||||

### PCA 场景

|

||||

|

||||

`例如: 考察一个人的智力情况,就直接看数学成绩就行(存在:数学、语文、英语成绩)`

|

||||

`例如: 考察一个人的智力情况,就直接看数学成绩就行(存在: 数学、语文、英语成绩)`

|

||||

|

||||

### PCA 原理

|

||||

|

||||

@@ -68,16 +68,16 @@

|

||||

1. 正交是为了数据有效性损失最小

|

||||

2. 正交的一个原因是特征值的特征向量是正交的

|

||||

|

||||

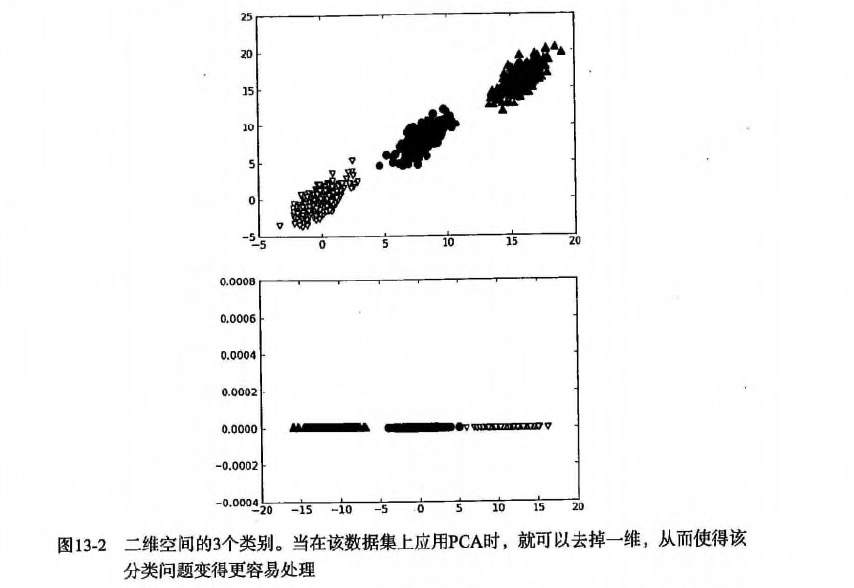

例如下图:

|

||||

例如下图:

|

||||

|

||||

|

||||

|

||||

> PCA 优缺点

|

||||

|

||||

```

|

||||

优点:降低数据的复杂性,识别最重要的多个特征。

|

||||

缺点:不一定需要,且可能损失有用信息。

|

||||

适用数据类型:数值型数据。

|

||||

优点: 降低数据的复杂性,识别最重要的多个特征。

|

||||

缺点: 不一定需要,且可能损失有用信息。

|

||||

适用数据类型: 数值型数据。

|

||||

```

|

||||

|

||||

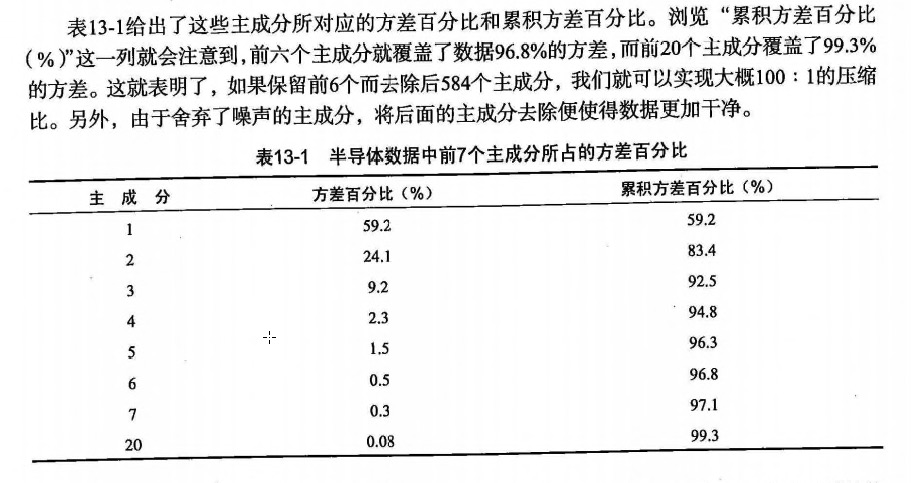

### 项目案例: 对半导体数据进行降维处理

|

||||

@@ -92,16 +92,16 @@

|

||||

具体来讲,它拥有590个特征。我们看看能否对这些特征进行降维处理。

|

||||

|

||||

对于数据的缺失值的问题,我们有一些处理方法(参考第5章)

|

||||

目前该章节处理的方案是:将缺失值NaN(Not a Number缩写),全部用平均值来替代(如果用0来处理的策略就太差劲了)。

|

||||

目前该章节处理的方案是: 将缺失值NaN(Not a Number缩写),全部用平均值来替代(如果用0来处理的策略就太差劲了)。

|

||||

```

|

||||

|

||||

#### 开发流程

|

||||

|

||||

> 收集数据:提供文本文件

|

||||

> 收集数据: 提供文本文件

|

||||

|

||||

文件名:secom.data

|

||||

文件名: secom.data

|

||||

|

||||

文本文件数据格式如下:

|

||||

文本文件数据格式如下:

|

||||

|

||||

```

|

||||

3030.93 2564 2187.7333 1411.1265 1.3602 100 97.6133 0.1242 1.5005 0.0162 -0.0034 0.9455 202.4396 0 7.9558 414.871 10.0433 0.968 192.3963 12.519 1.4026 -5419 2916.5 -4043.75 751 0.8955 1.773 3.049 64.2333 2.0222 0.1632 3.5191 83.3971 9.5126 50.617 64.2588 49.383 66.3141 86.9555 117.5132 61.29 4.515 70 352.7173 10.1841 130.3691 723.3092 1.3072 141.2282 1 624.3145 218.3174 0 4.592 4.841 2834 0.9317 0.9484 4.7057 -1.7264 350.9264 10.6231 108.6427 16.1445 21.7264 29.5367 693.7724 0.9226 148.6009 1 608.17 84.0793 NaN NaN 0 0.0126 -0.0206 0.0141 -0.0307 -0.0083 -0.0026 -0.0567 -0.0044 7.2163 0.132 NaN 2.3895 0.969 1747.6049 0.1841 8671.9301 -0.3274 -0.0055 -0.0001 0.0001 0.0003 -0.2786 0 0.3974 -0.0251 0.0002 0.0002 0.135 -0.0042 0.0003 0.0056 0 -0.2468 0.3196 NaN NaN NaN NaN 0.946 0 748.6115 0.9908 58.4306 0.6002 0.9804 6.3788 15.88 2.639 15.94 15.93 0.8656 3.353 0.4098 3.188 -0.0473 0.7243 0.996 2.2967 1000.7263 39.2373 123 111.3 75.2 46.2 350.671 0.3948 0 6.78 0.0034 0.0898 0.085 0.0358 0.0328 12.2566 0 4.271 10.284 0.4734 0.0167 11.8901 0.41 0.0506 NaN NaN 1017 967 1066 368 0.09 0.048 0.095 2 0.9 0.069 0.046 0.725 0.1139 0.3183 0.5888 0.3184 0.9499 0.3979 0.16 0 0 20.95 0.333 12.49 16.713 0.0803 5.72 0 11.19 65.363 0 0 0 0 0 0 0.292 5.38 20.1 0.296 10.62 10.3 5.38 4.04 16.23 0.2951 8.64 0 10.3 97.314 0 0.0772 0.0599 0.07 0.0547 0.0704 0.052 0.0301 0.1135 3.4789 0.001 NaN 0.0707 0.0211 175.2173 0.0315 1940.3994 0 0.0744 0.0546 0 0 0 0 0 0 0 0 0 0.0027 0.004 0 0 0 0 NaN NaN NaN NaN 0.0188 0 219.9453 0.0011 2.8374 0.0189 0.005 0.4269 0 0 0 0 0 0 0 0 0 0 0 0.0472 40.855 4.5152 30.9815 33.9606 22.9057 15.9525 110.2144 0.131 0 2.5883 0.001 0.0319 0.0197 0.012 0.0109 3.9321 0 1.5123 3.5811 0.1337 0.0055 3.8447 0.1077 0.0167 NaN NaN 418.1363 398.3185 496.1582 158.333 0.0373 0.0202 0.0462 0.6083 0.3032 0.02 0.0174 0.2827 0.0434 0.1342 0.2419 0.1343 0.367 0.1431 0.061 0 0 0 6.2698 0.1181 3.8208 5.3737 0.0254 1.6252 0 3.2461 18.0118 0 0 0 0 0 0 0.0752 1.5989 6.5893 0.0913 3.0911 8.4654 1.5989 1.2293 5.3406 0.0867 2.8551 0 2.9971 31.8843 NaN NaN 0 0.0215 0.0274 0.0315 0.0238 0.0206 0.0238 0.0144 0.0491 1.2708 0.0004 NaN 0.0229 0.0065 55.2039 0.0105 560.2658 0 0.017 0.0148 0.0124 0.0114 0 0 0 0 0 0 0 0.001 0.0013 0 0 0 0 NaN NaN NaN NaN 0.0055 0 61.5932 0.0003 0.9967 0.0082 0.0017 0.1437 0 0 0 0 0 0 0 0 0 0 0 0.0151 14.2396 1.4392 5.6188 3.6721 2.9329 2.1118 24.8504 29.0271 0 6.9458 2.738 5.9846 525.0965 0 3.4641 6.0544 0 53.684 2.4788 4.7141 1.7275 6.18 3.275 3.6084 18.7673 33.1562 26.3617 49.0013 10.0503 2.7073 3.1158 3.1136 44.5055 42.2737 1.3071 0.8693 1.1975 0.6288 0.9163 0.6448 1.4324 0.4576 0.1362 0 0 0 5.9396 3.2698 9.5805 2.3106 6.1463 4.0502 0 1.7924 29.9394 0 0 0 0 0 0 6.2052 311.6377 5.7277 2.7864 9.7752 63.7987 24.7625 13.6778 2.3394 31.9893 5.8142 0 1.6936 115.7408 0 613.3069 291.4842 494.6996 178.1759 843.1138 0 53.1098 0 48.2091 0.7578 NaN 2.957 2.1739 10.0261 17.1202 22.3756 0 0 0 0 0 0 0 0 0 0 0 0 64.6707 0 0 0 0 0 NaN NaN NaN NaN 1.9864 0 29.3804 0.1094 4.856 3.1406 0.5064 6.6926 0 0 0 0 0 0 0 0 0 0 0 2.057 4.0825 11.5074 0.1096 0.0078 0.0026 7.116 1.0616 395.57 75.752 0.4234 12.93 0.78 0.1827 5.7349 0.3363 39.8842 3.2687 1.0297 1.0344 0.4385 0.1039 42.3877 NaN NaN NaN NaN NaN NaN NaN NaN 533.85 2.1113 8.95 0.3157 3.0624 0.1026 1.6765 14.9509 NaN NaN NaN NaN 0.5005 0.0118 0.0035 2.363 NaN NaN NaN NaN

|

||||

@@ -111,7 +111,7 @@

|

||||

3032.24 2502.87 2233.3667 1326.52 1.5334 100 100.3967 0.1235 1.5031 -0.0031 -0.0072 0.9569 201.9424 0 10.5661 420.5925 10.3387 0.9735 191.6037 12.4735 1.3888 -5476.25 2635.25 -3987.5 117 1.2887 1.9912 7.2748 62.8333 3.1556 0.2696 3.2728 86.3269 8.7677 50.248 64.1511 49.752 66.1542 86.1468 121.4364 76.39 2.209 70 353.34 10.4091 176.3136 789.7523 1.0341 138.0882 1 667.7418 233.5491 0 4.624 4.894 2865 0.9298 0.9449 4.6414 -12.2945 355.0809 9.7948 144.0191 21.9782 32.2945 44.1498 745.6025 0.9256 146.6636 1 645.7636 65.8417 NaN NaN 0 -0.0534 0.0183 -0.0167 -0.0449 0.0034 -0.0178 -0.0123 -0.0048 7.5017 0.1342 NaN 2.453 0.9902 1828.3846 0.1829 9014.46 0.0448 -0.0077 -0.0001 -0.0001 -0.0001 0.2189 0 -0.6704 -0.0167 0.0004 -0.0003 0.0696 -0.0045 0.0002 0.0078 0 -0.0799 -0.2038 NaN NaN NaN NaN 0.9424 0 796.595 0.9908 58.3858 0.5913 0.9628 6.3551 15.75 3.148 15.73 15.71 0.946 3.027 0.5328 3.299 -0.5677 0.778 1.001 2.3715 993.1274 38.1448 119 143.2 123.1 48.8 296.303 0.3744 0 3.64 0.0041 0.0634 0.0451 0.0623 0.024 14.2354 0 9.005 12.506 0.4434 0.0126 13.9047 0.43 0.0538 NaN NaN 699 283 1747 1443 0.147 0.04 0.113 3.9 0.8 0.101 0.499 0.576 0.0631 0.3053 0.583 0.3053 0.8285 0.1308 0.922 0 0 15.24 0.282 10.85 37.715 0.1189 3.98 0 25.54 72.149 0 0 0 0 0 0 0.25 5.52 15.76 0.519 10.71 19.77 5.52 8.446 33.832 0.3951 9.09 0 19.77 92.307 0 0.0915 0.0506 0.0769 0.1079 0.0797 0.1047 0.0924 0.1015 4.1338 0.003 NaN 0.0802 0.0004 69.151 0.197 1406.4004 0 0.0227 0.0272 0 0 0 0 0 0 0 0 0 0.0067 0.0031 0 0 0 0 NaN NaN NaN NaN 0.024 0 149.2172 0.0006 2.5775 0.0177 0.0214 0.4051 0 0 0 0 0 0 0 0 0 0 0 0.0488 19.862 3.6163 34.125 55.9626 53.0876 17.4864 88.7672 0.1092 0 1.0929 0.0013 0.0257 0.0116 0.0163 0.008 4.4239 0 3.2376 3.6536 0.1293 0.004 4.3474 0.1275 0.0181 NaN NaN 319.1252 128.0296 799.5884 628.3083 0.0755 0.0181 0.0476 1.35 0.2698 0.032 0.1541 0.2155 0.031 0.1354 0.2194 0.1354 0.3072 0.0582 0.3574 0 0 0 4.8956 0.0766 2.913 11.0583 0.0327 1.1229 0 7.3296 23.116 0 0 0 0 0 0 0.0822 1.6216 4.7279 0.1773 3.155 9.7777 1.6216 2.5923 10.5352 0.1301 3.0939 0 6.3767 32.0537 NaN NaN 0 0.0246 0.0221 0.0329 0.0522 0.0256 0.0545 0.0476 0.0463 1.553 0.001 NaN 0.0286 0.0001 21.0312 0.0573 494.7368 0 0.0063 0.0077 0.0052 0.0027 0 0 0 0 0 0 0 0.0025 0.0012 0 0 0 0 NaN NaN NaN NaN 0.0089 0 57.2692 0.0002 0.8495 0.0065 0.0077 0.1356 0 0 0 0 0 0 0 0 0 0 0 0.0165 7.1493 1.1704 5.3823 4.7226 4.9184 2.185 22.3369 24.4142 0 3.6256 3.3208 4.2178 0 866.0295 2.5046 7.0492 0 85.2255 2.9734 4.2892 1.2943 7.257 3.4473 3.8754 12.7642 10.739 43.8119 0 11.4064 2.0088 1.5533 6.2069 25.3521 37.4691 15.247 0.6672 0.7198 0.6076 0.9088 0.6136 1.2524 0.1518 0.7592 0 0 0 4.3131 2.7092 6.1538 4.7756 11.4945 2.8822 0 3.8248 30.8924 0 0 0 0 0 0 5.3863 44.898 4.4384 5.2987 7.4365 89.9529 17.0927 19.1303 4.5375 42.6838 6.1979 0 3.0615 140.1953 0 171.4486 276.881 461.8619 240.1781 0 587.3773 748.1781 0 55.1057 2.2358 NaN 3.2712 0.0372 3.7821 107.6905 15.6016 0 293.1396 0 0 0 0 0 0 0 0 0 0 148.0663 0 0 0 0 0 NaN NaN NaN NaN 2.5512 0 18.7319 0.0616 4.4146 2.9954 2.2181 6.3745 0 0 0 0 0 0 0 0 0 0 0 2.0579 1.9999 9.4805 0.1096 0.0078 0.0026 7.116 1.4636 399.914 79.156 1.0388 19.63 1.98 0.4287 9.7608 0.8311 70.9706 4.9086 2.5014 0.9778 0.2156 0.0461 22.05 NaN NaN NaN NaN NaN NaN NaN NaN 532.0155 2.0275 8.83 0.2224 3.1776 0.0706 1.6597 10.9698 NaN NaN NaN NaN 0.48 0.4766 0.1045 99.3032 0.0202 0.0149 0.0044 73.8432

|

||||

```

|

||||

|

||||

> 准备数据:将value为NaN的替换为均值

|

||||

> 准备数据: 将value为NaN的替换为均值

|

||||

|

||||

```python

|

||||

def replaceNanWithMean():

|

||||

@@ -126,7 +126,7 @@ def replaceNanWithMean():

|

||||

return datMat

|

||||

```

|

||||

|

||||

> 分析数据:统计分析 N 的阈值

|

||||

> 分析数据: 统计分析 N 的阈值

|

||||

|

||||

|

||||

|

||||

@@ -134,7 +134,7 @@ def replaceNanWithMean():

|

||||

|

||||

在等式 Av=入v 中,v 是特征向量, 入是特征值。<br/>

|

||||

表示 如果特征向量 v 被某个矩阵 A 左乘,那么它就等于某个标量 入 乘以 v.<br/>

|

||||

幸运的是: Numpy 中有寻找特征向量和特征值的模块 linalg,它有 eig() 方法,该方法用于求解特征向量和特征值。

|

||||

幸运的是: Numpy 中有寻找特征向量和特征值的模块 linalg,它有 eig() 方法,该方法用于求解特征向量和特征值。

|

||||

|

||||

```python

|

||||

def pca(dataMat, topNfeat=9999999):

|

||||

@@ -158,9 +158,9 @@ def pca(dataMat, topNfeat=9999999):

|

||||

|

||||

# cov协方差=[(x1-x均值)*(y1-y均值)+(x2-x均值)*(y2-y均值)+...+(xn-x均值)*(yn-y均值)+]/(n-1)

|

||||

'''

|

||||

方差:(一维)度量两个随机变量关系的统计量

|

||||

协方差: (二维)度量各个维度偏离其均值的程度

|

||||

协方差矩阵:(多维)度量各个维度偏离其均值的程度

|

||||

方差: (一维)度量两个随机变量关系的统计量

|

||||

协方差: (二维)度量各个维度偏离其均值的程度

|

||||

协方差矩阵: (多维)度量各个维度偏离其均值的程度

|

||||

|

||||

当 cov(X, Y)>0时,表明X与Y正相关;(X越大,Y也越大;X越小Y,也越小。这种情况,我们称为“正相关”。)

|

||||

当 cov(X, Y)<0时,表明X与Y负相关;

|

||||

@@ -212,7 +212,7 @@ def pca(dataMat, topNfeat=9999999):

|

||||

```

|

||||

降维技术使得数据变的更易使用,并且它们往往能够去除数据中的噪音,使得其他机器学习任务更加精确。

|

||||

降维往往作为预处理步骤,在数据应用到其他算法之前清洗数据。

|

||||

比较流行的降维技术: 独立成分分析、因子分析 和 主成分分析, 其中又以主成分分析应用最广泛。

|

||||

比较流行的降维技术: 独立成分分析、因子分析 和 主成分分析, 其中又以主成分分析应用最广泛。

|

||||

|

||||

本章中的PCA将所有的数据集都调入了内存,如果无法做到,就需要其他的方法来寻找其特征值。

|

||||

如果使用在线PCA分析的方法,你可以参考一篇优秀的论文 "Incremental Eigenanalysis for Classification"。

|

||||

@@ -221,6 +221,6 @@ def pca(dataMat, topNfeat=9999999):

|

||||

|

||||

* * *

|

||||

|

||||

* **作者:[片刻](http://cwiki.apachecn.org/display/~jiangzhonglian) [1988](http://cwiki.apachecn.org/display/~lihuisong)**

|

||||

* **作者: [片刻](http://cwiki.apachecn.org/display/~jiangzhonglian) [1988](http://cwiki.apachecn.org/display/~lihuisong)**

|

||||

* [GitHub地址](https://github.com/apachecn/AiLearning): <https://github.com/apachecn/AiLearning>

|

||||

* **版权声明:欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

* **版权声明: 欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

|

||||

@@ -14,7 +14,7 @@

|

||||

|

||||

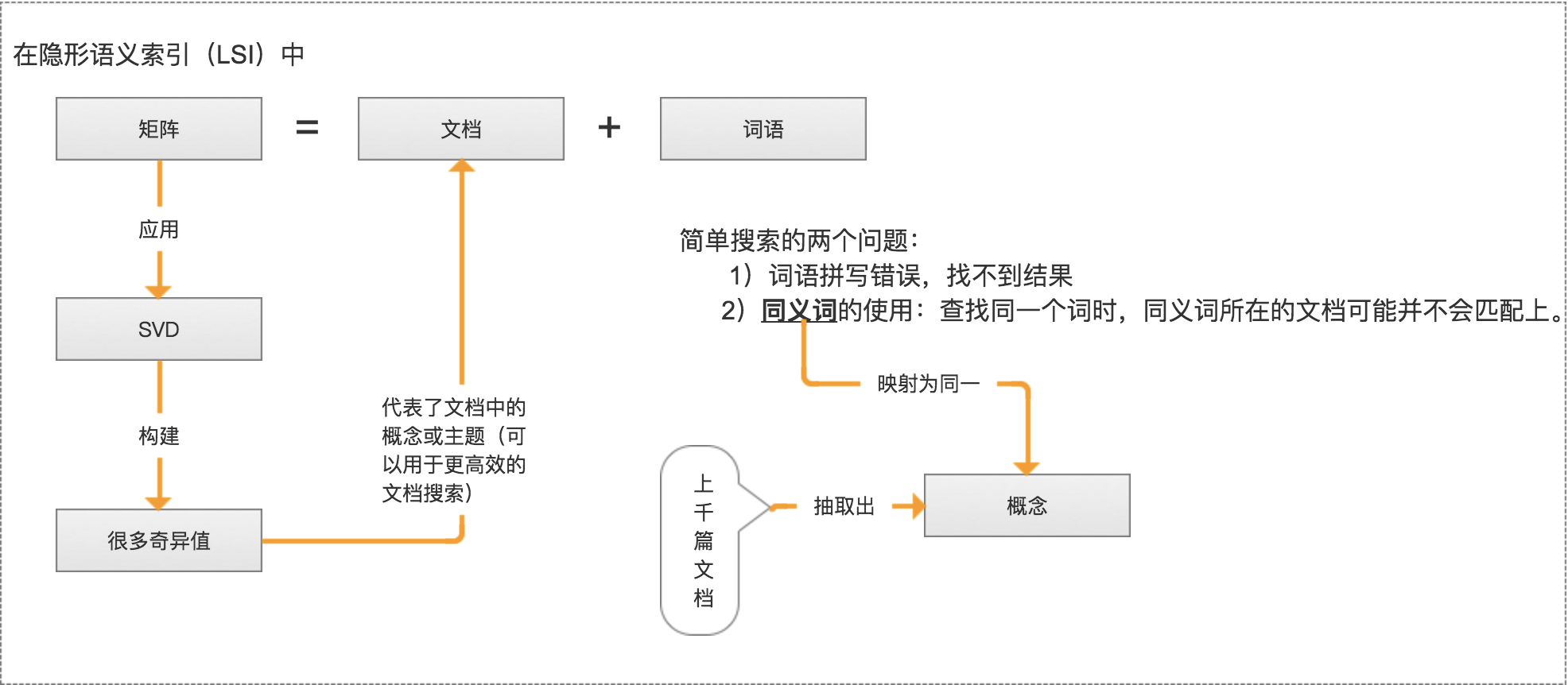

> 信息检索-隐性语义检索(Latent Semantic Indexing, LSI)或 隐形语义分析(Latent Semantic Analysis, LSA)

|

||||

|

||||

隐性语义索引:矩阵 = 文档 + 词语

|

||||

隐性语义索引: 矩阵 = 文档 + 词语

|

||||

* 是最早的 SVD 应用之一,我们称利用 SVD 的方法为隐性语义索引(LSI)或隐性语义分析(LSA)。

|

||||

|

||||

|

||||

@@ -30,7 +30,7 @@

|

||||

|

||||

> 图像压缩

|

||||

|

||||

例如:`32*32=1024 => 32*2+2*1+32*2=130`(2*1表示去掉了除对角线的0), 几乎获得了10倍的压缩比。

|

||||

例如: `32*32=1024 => 32*2+2*1+32*2=130`(2*1表示去掉了除对角线的0), 几乎获得了10倍的压缩比。

|

||||

|

||||

|

||||

|

||||

@@ -42,12 +42,12 @@

|

||||

|

||||

* 矩阵分解是将数据矩阵分解为多个独立部分的过程。

|

||||

* 矩阵分解可以将原始矩阵表示成新的易于处理的形式,这种新形式是两个或多个矩阵的乘积。(类似代数中的因数分解)

|

||||

* 举例:如何将12分解成两个数的乘积?(1,12)、(2,6)、(3,4)都是合理的答案。

|

||||

* 举例: 如何将12分解成两个数的乘积?(1,12)、(2,6)、(3,4)都是合理的答案。

|

||||

|

||||

> SVD 是矩阵分解的一种类型,也是矩阵分解最常见的技术

|

||||

|

||||

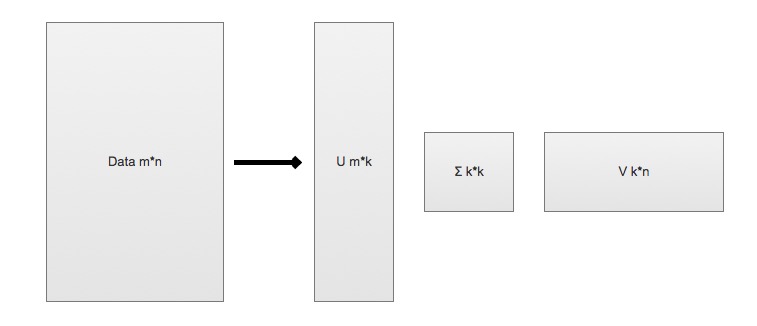

* SVD 将原始的数据集矩阵 Data 分解成三个矩阵 U、∑、V

|

||||

* 举例:如果原始矩阵 \\(Data_{m*n}\\) 是m行n列,

|

||||

* 举例: 如果原始矩阵 \\(Data_{m*n}\\) 是m行n列,

|

||||

* \\(U_{m * k}\\) 表示m行k列

|

||||

* \\(∑_{k * k}\\) 表示k行k列

|

||||

* \\(V_{k * n}\\) 表示k行n列。

|

||||

@@ -56,20 +56,20 @@

|

||||

|

||||

|

||||

|

||||

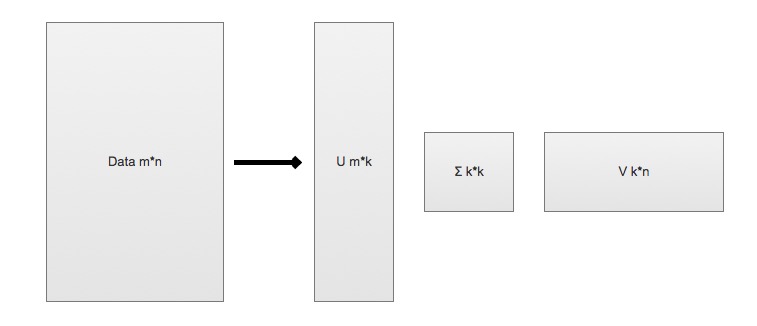

具体的案例:(大家可以试着推导一下:https://wenku.baidu.com/view/b7641217866fb84ae45c8d17.html )

|

||||

具体的案例: (大家可以试着推导一下: https://wenku.baidu.com/view/b7641217866fb84ae45c8d17.html )

|

||||

|

||||

|

||||

|

||||

* 上述分解中会构建出一个矩阵∑,该矩阵只有对角元素,其他元素均为0(近似于0)。另一个惯例就是,∑的对角元素是从大到小排列的。这些对角元素称为奇异值。

|

||||

* 奇异值与特征值(PCA 数据中重要特征)是有关系的。这里的奇异值就是矩阵 \\(Data * Data^T\\) 特征值的平方根。

|

||||

* 普遍的事实:在某个奇异值的数目(r 个=>奇异值的平方和累加到总值的90%以上)之后,其他的奇异值都置为0(近似于0)。这意味着数据集中仅有 r 个重要特征,而其余特征则都是噪声或冗余特征。

|

||||

* 普遍的事实: 在某个奇异值的数目(r 个=>奇异值的平方和累加到总值的90%以上)之后,其他的奇异值都置为0(近似于0)。这意味着数据集中仅有 r 个重要特征,而其余特征则都是噪声或冗余特征。

|

||||

|

||||

### SVD 算法特点

|

||||

|

||||

```

|

||||

优点:简化数据,去除噪声,优化算法的结果

|

||||

缺点:数据的转换可能难以理解

|

||||

使用的数据类型:数值型数据

|

||||

优点: 简化数据,去除噪声,优化算法的结果

|

||||

缺点: 数据的转换可能难以理解

|

||||

使用的数据类型: 数值型数据

|

||||

```

|

||||

|

||||

## 推荐系统

|

||||

@@ -89,17 +89,17 @@

|

||||

> 基于协同过滤(collaborative filtering) 的推荐引擎

|

||||

|

||||

* 利用Python 实现 SVD(Numpy 有一个称为 linalg 的线性代数工具箱)

|

||||

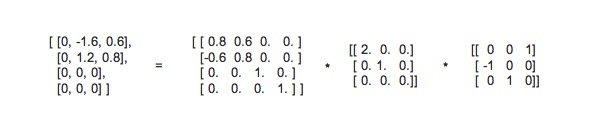

* 协同过滤:是通过将用户和其他用户的数据进行对比来实现推荐的。

|

||||

* 协同过滤: 是通过将用户和其他用户的数据进行对比来实现推荐的。

|

||||

* 当知道了两个用户或两个物品之间的相似度,我们就可以利用已有的数据来预测未知用户的喜好。

|

||||

|

||||

> 基于物品的相似度和基于用户的相似度:物品比较少则选择物品相似度,用户比较少则选择用户相似度。【矩阵还是小一点好计算】

|

||||

> 基于物品的相似度和基于用户的相似度: 物品比较少则选择物品相似度,用户比较少则选择用户相似度。【矩阵还是小一点好计算】

|

||||

|

||||

* 基于物品的相似度:计算物品之间的距离。【耗时会随物品数量的增加而增加】

|

||||

* 基于物品的相似度: 计算物品之间的距离。【耗时会随物品数量的增加而增加】

|

||||

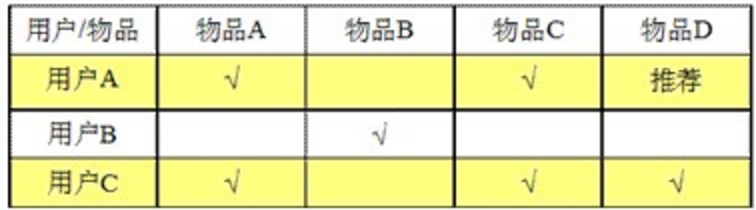

* 由于物品A和物品C 相似度(相关度)很高,所以给买A的人推荐C。

|

||||

|

||||

|

||||

|

||||

* 基于用户的相似度:计算用户之间的距离。【耗时会随用户数量的增加而增加】

|

||||

* 基于用户的相似度: 计算用户之间的距离。【耗时会随用户数量的增加而增加】

|

||||

* 由于用户A和用户C 相似度(相关度)很高,所以A和C是兴趣相投的人,对于C买的物品就会推荐给A。

|

||||

|

||||

|

||||

@@ -107,15 +107,15 @@

|

||||

> 相似度计算

|

||||

|

||||

* inA, inB 对应的是 列向量

|

||||

1. 欧氏距离:指在m维空间中两个点之间的真实距离,或者向量的自然长度(即该点到原点的距离)。二维或三维中的欧氏距离就是两点之间的实际距离。

|

||||

1. 欧氏距离: 指在m维空间中两个点之间的真实距离,或者向量的自然长度(即该点到原点的距离)。二维或三维中的欧氏距离就是两点之间的实际距离。

|

||||

* 相似度= 1/(1+欧式距离)

|

||||

* `相似度= 1.0/(1.0 + la.norm(inA - inB))`

|

||||

* 物品对越相似,它们的相似度值就越大。

|

||||

2. 皮尔逊相关系数:度量的是两个向量之间的相似度。

|

||||

2. 皮尔逊相关系数: 度量的是两个向量之间的相似度。

|

||||

* 相似度= 0.5 + 0.5*corrcoef() 【皮尔逊相关系数的取值范围从 -1 到 +1,通过函数0.5 + 0.5\*corrcoef()这个函数计算,把值归一化到0到1之间】

|

||||

* `相似度= 0.5 + 0.5 * corrcoef(inA, inB, rowvar = 0)[0][1]`

|

||||

* 相对欧氏距离的优势:它对用户评级的量级并不敏感。

|

||||

3. 余弦相似度:计算的是两个向量夹角的余弦值。

|

||||

* 相对欧氏距离的优势: 它对用户评级的量级并不敏感。

|

||||

3. 余弦相似度: 计算的是两个向量夹角的余弦值。

|

||||

* 余弦值 = (A·B)/(||A||·||B||) 【余弦值的取值范围也在-1到+1之间】

|

||||

* 相似度= 0.5 + 0.5*余弦值

|

||||

* `相似度= 0.5 + 0.5*( float(inA.T*inB) / la.norm(inA)*la.norm(inB))`

|

||||

@@ -124,15 +124,15 @@

|

||||

> 推荐系统的评价

|

||||

|

||||

* 采用交叉测试的方法。【拆分数据为训练集和测试集】

|

||||

* 推荐引擎评价的指标: 最小均方根误差(Root mean squared error, RMSE),也称标准误差(Standard error),就是计算均方误差的平均值然后取其平方根。

|

||||

* 推荐引擎评价的指标: 最小均方根误差(Root mean squared error, RMSE),也称标准误差(Standard error),就是计算均方误差的平均值然后取其平方根。

|

||||

* 如果RMSE=1, 表示相差1个星级;如果RMSE=2.5, 表示相差2.5个星级。

|

||||

|

||||

### 推荐系统 原理

|

||||

|

||||

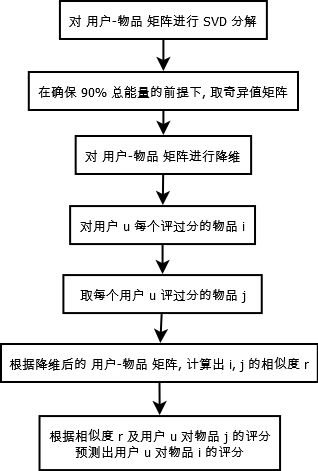

* 推荐系统的工作过程:给定一个用户,系统会为此用户返回N个最好的推荐菜。

|

||||

* 实现流程大致如下:

|

||||

* 推荐系统的工作过程: 给定一个用户,系统会为此用户返回N个最好的推荐菜。

|

||||

* 实现流程大致如下:

|

||||

1. 寻找用户没有评级的菜肴,即在用户-物品矩阵中的0值。

|

||||

2. 在用户没有评级的所有物品中,对每个物品预计一个可能的评级分数。这就是说:我们认为用户可能会对物品的打分(这就是相似度计算的初衷)。

|

||||

2. 在用户没有评级的所有物品中,对每个物品预计一个可能的评级分数。这就是说: 我们认为用户可能会对物品的打分(这就是相似度计算的初衷)。

|

||||

3. 对这些物品的评分从高到低进行排序,返回前N个物品。

|

||||

|

||||

|

||||

@@ -152,9 +152,9 @@

|

||||

def loadExData3():

|

||||

# 利用SVD提高推荐效果,菜肴矩阵

|

||||

"""

|

||||

行:代表人

|

||||

列:代表菜肴名词

|

||||

值:代表人对菜肴的评分,0表示未评分

|

||||

行: 代表人

|

||||

列: 代表菜肴名词

|

||||

值: 代表人对菜肴的评分,0表示未评分

|

||||

"""

|

||||

return[[2, 0, 0, 4, 4, 0, 0, 0, 0, 0, 0],

|

||||

[0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 5],

|

||||

@@ -227,7 +227,7 @@ def standEst(dataMat, user, simMeas, item):

|

||||

return ratSimTotal/simTotal

|

||||

```

|

||||

|

||||

* 2.基于SVD(参考地址:http://www.codeweblog.com/svd-%E7%AC%94%E8%AE%B0/)

|

||||

* 2.基于SVD(参考地址: http://www.codeweblog.com/svd-%E7%AC%94%E8%AE%B0/)

|

||||

|

||||

|

||||

|

||||

@@ -315,14 +315,14 @@ def recommend(dataMat, user, N=3, simMeas=cosSim, estMethod=standEst):

|

||||

|

||||

1. 通过各种标签来标记菜肴

|

||||

2. 将这些属性作为相似度计算所需要的数据

|

||||

3. 这就是:基于内容的推荐。

|

||||

3. 这就是: 基于内容的推荐。

|

||||

|

||||

> 构建推荐引擎面临的挑战

|

||||

|

||||

问题

|

||||

* 1)在大规模的数据集上,SVD分解会降低程序的速度

|

||||

* 2)存在其他很多规模扩展性的挑战性问题,比如矩阵的表示方法和计算相似度得分消耗资源。

|

||||

* 3)如何在缺乏数据时给出好的推荐-称为冷启动【简单说:用户不会喜欢一个无效的物品,而用户不喜欢的物品又无效】

|

||||

* 3)如何在缺乏数据时给出好的推荐-称为冷启动【简单说: 用户不会喜欢一个无效的物品,而用户不喜欢的物品又无效】

|

||||

|

||||

建议

|

||||

* 1)在大型系统中,SVD分解(可以在程序调入时运行一次)每天运行一次或者其频率更低,并且还要离线运行。

|

||||

@@ -372,13 +372,13 @@ def analyse_data(Sigma, loopNum=20):

|

||||

|

||||

通常保留矩阵 80% ~ 90% 的能量,就可以得到重要的特征并取出噪声。

|

||||

'''

|

||||

print '主成分:%s, 方差占比:%s%%' % (format(i+1, '2.0f'), format(SigmaI/SigmaSum*100, '4.2f'))

|

||||

print '主成分: %s, 方差占比: %s%%' % (format(i+1, '2.0f'), format(SigmaI/SigmaSum*100, '4.2f'))

|

||||

```

|

||||

|

||||

> 使用算法: 对比使用 SVD 前后的数据差异对比,对于存储大家可以试着写写

|

||||

|

||||

|

||||

例如:`32*32=1024 => 32*2+2*1+32*2=130`(2*1表示去掉了除对角线的0), 几乎获得了10倍的压缩比。

|

||||

例如: `32*32=1024 => 32*2+2*1+32*2=130`(2*1表示去掉了除对角线的0), 几乎获得了10倍的压缩比。

|

||||

|

||||

```python

|

||||

# 打印矩阵

|

||||

@@ -428,6 +428,6 @@ def imgCompress(numSV=3, thresh=0.8):

|

||||

|

||||

* * *

|

||||

|

||||

* **作者:[片刻](http://cwiki.apachecn.org/display/~jiangzhonglian) [1988](http://cwiki.apachecn.org/display/~lihuisong)**

|

||||

* **作者: [片刻](http://cwiki.apachecn.org/display/~jiangzhonglian) [1988](http://cwiki.apachecn.org/display/~lihuisong)**

|

||||

* [GitHub地址](https://github.com/apachecn/AiLearning): <https://github.com/apachecn/AiLearning>

|

||||

* **版权声明:欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

* **版权声明: 欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

|

||||

@@ -13,7 +13,7 @@

|

||||

假如你为一家网络购物商店工作,很多用户访问该网站,其中有些人会购买商品,有些人则随意浏览后就离开。

|

||||

对于你来说,可能很想识别那些有购物意愿的用户。

|

||||

那么问题就来了,数据集可能会非常大,在单机上训练要运行好几天。

|

||||

接下来:我们讲讲 MapRedece 如何来解决这样的问题

|

||||

接下来: 我们讲讲 MapRedece 如何来解决这样的问题

|

||||

```

|

||||

|

||||

|

||||

@@ -79,17 +79,17 @@ cat data/15.BigData_MapReduce/inputFile.txt | python src/python/15.BigData_MapRe

|

||||

|

||||

#### Mahout in Action

|

||||

|

||||

1. 简单贝叶斯:它属于为数不多的可以很自然的使用MapReduce的算法。通过统计在某个类别下某特征的概率。

|

||||

2. k-近邻算法:高维数据下(如文本、图像和视频)流行的近邻查找方法是局部敏感哈希算法。

|

||||

3. 支持向量机(SVM):使用随机梯度下降算法求解,如Pegasos算法。

|

||||

4. 奇异值分解:Lanczos算法是一个有效的求解近似特征值的算法。

|

||||

5. k-均值聚类:canopy算法初始化k个簇,然后再运行K-均值求解结果。

|

||||

1. 简单贝叶斯: 它属于为数不多的可以很自然的使用MapReduce的算法。通过统计在某个类别下某特征的概率。

|

||||

2. k-近邻算法: 高维数据下(如文本、图像和视频)流行的近邻查找方法是局部敏感哈希算法。

|

||||

3. 支持向量机(SVM): 使用随机梯度下降算法求解,如Pegasos算法。

|

||||

4. 奇异值分解: Lanczos算法是一个有效的求解近似特征值的算法。

|

||||

5. k-均值聚类: canopy算法初始化k个簇,然后再运行K-均值求解结果。

|

||||

|

||||

### 使用 mrjob 库将 MapReduce 自动化

|

||||

|

||||

> 理论简介

|

||||

|

||||

* MapReduce 作业流自动化的框架:Cascading 和 Oozie.

|

||||

* MapReduce 作业流自动化的框架: Cascading 和 Oozie.

|

||||

* mrjob 是一个不错的学习工具,与2010年底实现了开源,来之于 Yelp(一个餐厅点评网站).

|

||||

|

||||

```Shell

|

||||

@@ -106,7 +106,7 @@ python src/python/15.BigData_MapReduce/mrMean.py < data/15.BigData_MapReduce/inp

|

||||

python src/python/15.BigData_MapReduce/mrMean.py < data/15.BigData_MapReduce/inputFile.txt

|

||||

```

|

||||

|

||||

### 项目案例:分布式 SVM 的 Pegasos 算法

|

||||

### 项目案例: 分布式 SVM 的 Pegasos 算法

|

||||

|

||||

Pegasos是指原始估计梯度求解器(Peimal Estimated sub-GrAdient Solver)

|

||||

|

||||

@@ -118,14 +118,14 @@ Pegasos是指原始估计梯度求解器(Peimal Estimated sub-GrAdient Solver)

|

||||

* 如果不是则将其加入到待更新集合。

|

||||

3. 批处理完毕后,权重向量按照这些错分的样本进行更新。

|

||||

|

||||

上述算法伪代码如下:

|

||||

上述算法伪代码如下:

|

||||

|

||||

```

|

||||

将 回归系数w 初始化为0

|

||||

对每次批处理

|

||||

随机选择 k 个样本点(向量)

|

||||

对每个向量

|

||||

如果该向量被错分:

|

||||

如果该向量被错分:

|

||||

更新权重向量 w

|

||||

累加对 w 的更新

|

||||

```

|

||||

@@ -133,17 +133,17 @@ Pegasos是指原始估计梯度求解器(Peimal Estimated sub-GrAdient Solver)

|

||||

#### 开发流程

|

||||

|

||||

```

|

||||

收集数据:数据按文本格式存放。

|

||||

准备数据:输入数据已经是可用的格式,所以不需任何准备工作。如果你需要解析一个大规模的数据集,建议使用 map 作业来完成,从而达到并行处理的目的。

|

||||

分析数据:无。

|

||||

训练算法:与普通的 SVM 一样,在分类器训练上仍需花费大量的时间。

|

||||

测试算法:在二维空间上可视化之后,观察超平面,判断算法是否有效。

|

||||

使用算法:本例不会展示一个完整的应用,但会展示如何在大数据集上训练SVM。该算法其中一个应用场景就是本文分类,通常在文本分类里可能有大量的文档和成千上万的特征。

|

||||

收集数据: 数据按文本格式存放。

|

||||

准备数据: 输入数据已经是可用的格式,所以不需任何准备工作。如果你需要解析一个大规模的数据集,建议使用 map 作业来完成,从而达到并行处理的目的。

|

||||

分析数据: 无。

|

||||

训练算法: 与普通的 SVM 一样,在分类器训练上仍需花费大量的时间。

|

||||

测试算法: 在二维空间上可视化之后,观察超平面,判断算法是否有效。

|

||||

使用算法: 本例不会展示一个完整的应用,但会展示如何在大数据集上训练SVM。该算法其中一个应用场景就是本文分类,通常在文本分类里可能有大量的文档和成千上万的特征。

|

||||

```

|

||||

|

||||

> 收集数据

|

||||

|

||||

文本文件数据格式如下:

|

||||

文本文件数据格式如下:

|

||||

|

||||

```python

|

||||

0.365032 2.465645 -1

|

||||

@@ -213,11 +213,11 @@ def batchPegasos(dataSet, labels, lam, T, k):

|

||||

|

||||

[完整代码地址](https://github.com/apachecn/AiLearning/blob/master/src/py2.x/ml/15.BigData_MapReduce/pegasos.py): <https://github.com/apachecn/AiLearning/blob/master/src/py2.x/ml/15.BigData_MapReduce/pegasos.py>

|

||||

|

||||

运行方式:`python /opt/git/MachineLearning/src/python/15.BigData_MapReduce/mrSVM.py < data/15.BigData_MapReduce/inputFile.txt`

|

||||

运行方式: `python /opt/git/MachineLearning/src/python/15.BigData_MapReduce/mrSVM.py < data/15.BigData_MapReduce/inputFile.txt`

|

||||

[MR版本的代码地址](https://github.com/apachecn/AiLearning/blob/master/src/py2.x/ml/15.BigData_MapReduce/mrSVM.py): <https://github.com/apachecn/AiLearning/blob/master/src/py2.x/ml/15.BigData_MapReduce/mrSVM.py>

|

||||

|

||||

* * *

|

||||

|

||||

* **作者:[片刻](http://cwiki.apachecn.org/display/~jiangzhonglian) [小瑶](http://cwiki.apachecn.org/display/~chenyao)**

|

||||

* **作者: [片刻](http://cwiki.apachecn.org/display/~jiangzhonglian) [小瑶](http://cwiki.apachecn.org/display/~chenyao)**

|

||||

* [GitHub地址](https://github.com/apachecn/AiLearning): <https://github.com/apachecn/AiLearning>

|

||||

* **版权声明:欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

* **版权声明: 欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

|

||||

@@ -2,9 +2,9 @@

|

||||

|

||||

## 背景与挖掘目标

|

||||

|

||||

随着互联网的快速发展,用户很难快速从海量信息中寻找到自己感兴趣的信息。因此诞生了:搜索引擎+推荐系统

|

||||

随着互联网的快速发展,用户很难快速从海量信息中寻找到自己感兴趣的信息。因此诞生了: 搜索引擎+推荐系统

|

||||

|

||||

本章节-推荐系统:

|

||||

本章节-推荐系统:

|

||||

|

||||

1. 帮助用户发现其感兴趣和可能感兴趣的信息。

|

||||

2. 让网站价值信息脱颖而出,得到广大用户的认可。

|

||||

@@ -23,9 +23,9 @@

|

||||

|

||||

正常的情况下,需要对用户的兴趣爱好以及需求进行分类。

|

||||

因为在用户访问记录中,没有记录用户访问页面时间的长短,因此不容易判断用户兴趣爱好。

|

||||

因此,本文根据用户浏览的网页信息进行分析处理,主要采用以下方法处理:以用户浏览网页的类型进行分类,然后对每个类型中的内容进行推荐。

|

||||

因此,本文根据用户浏览的网页信息进行分析处理,主要采用以下方法处理: 以用户浏览网页的类型进行分类,然后对每个类型中的内容进行推荐。

|

||||

|

||||

分析过程如下:

|

||||

分析过程如下:

|

||||

|

||||

* 从系统中获取用户访问网站的原始记录。

|

||||

* 对数据进行多维分析,包括用户访问内容,流失用户分析以及用户分类等分析。

|

||||

@@ -65,21 +65,21 @@

|

||||

* 矩阵分解通过把原始的评分矩阵R分解为两个矩阵相乘,并且只考虑有评分的值,训练时不考虑missing项的值。R矩阵分解成为U与V两个矩阵后,评分矩阵R中missing的值就可以通过U矩阵中的某列和V矩阵的某行相乘得到

|

||||

* 矩阵分解的目标函数: U矩阵与V矩阵的可以通过梯度下降(gradient descent)算法求得,通过交替更新u与v多次迭代收敛之后可求出U与V。

|

||||

* 矩阵分解背后的核心思想,找到两个矩阵,它们相乘之后得到的那个矩阵的值,与评分矩阵R中有值的位置中的值尽可能接近。这样一来,分解出来的两个矩阵相乘就尽可能还原了评分矩阵R,因为有值的地方,值都相差得尽可能地小,那么missing的值通过这样的方式计算得到,比较符合趋势。

|

||||

* 协同过滤中主要存在如下两个问题:稀疏性与冷启动问题。已有的方案通常会通过引入多个不同的数据源或者辅助信息(Side information)来解决这些问题,用户的Side information可以是用户的基本个人信息、用户画像信息等,而Item的Side information可以是物品的content信息等。

|

||||

* 协同过滤中主要存在如下两个问题: 稀疏性与冷启动问题。已有的方案通常会通过引入多个不同的数据源或者辅助信息(Side information)来解决这些问题,用户的Side information可以是用户的基本个人信息、用户画像信息等,而Item的Side information可以是物品的content信息等。

|

||||

|

||||

## 效果评估

|

||||

|

||||

1. 召回率和准确率 【人为统计分析】

|

||||

2. F值(P-R曲线) 【偏重:非均衡问题】

|

||||

3. ROC和AUC 【偏重:不同结果的对比】

|

||||

2. F值(P-R曲线) 【偏重: 非均衡问题】

|

||||

3. ROC和AUC 【偏重: 不同结果的对比】

|

||||

|

||||

* * *

|

||||

|

||||

* **作者:[片刻](https://github.com/jiangzhonglian)**

|

||||

* **作者: [片刻](https://github.com/jiangzhonglian)**

|

||||

* [GitHub地址](https://github.com/apachecn/AiLearning): <https://github.com/apachecn/AiLearning>

|

||||

* **版权声明:欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

* **版权声明: 欢迎转载学习 => 请标注信息来源于 [ApacheCN](http://www.apachecn.org/)**

|

||||

|

||||

> 摘录的原文地址:

|

||||

> 摘录的原文地址:

|

||||

|

||||

* [推荐系统中常用算法 以及优点缺点对比](http://www.36dsj.com/archives/9519)

|

||||

* [推荐算法的基于知识推荐](https://zhidao.baidu.com/question/2013524494179442228.html)

|

||||

|

||||

@@ -7,7 +7,7 @@

|

||||

|

||||

`k-近邻(kNN, k-NearestNeighbor)算法是一种基本分类与回归方法,我们这里只讨论分类问题中的 k-近邻算法。`

|

||||

|

||||

**一句话总结:近朱者赤近墨者黑!**

|

||||

**一句话总结: 近朱者赤近墨者黑!**

|

||||

|

||||

`k 近邻算法的输入为实例的特征向量,对应于特征空间的点;输出为实例的类别,可以取多类。k 近邻算法假设给定一个训练数据集,其中的实例类别已定。分类时,对新的实例,根据其 k 个最近邻的训练实例的类别,通过多数表决等方式进行预测。因此,k近邻算法不具有显式的学习过程。`

|

||||

|

||||

@@ -16,8 +16,8 @@

|

||||

## KNN 场景

|

||||

|

||||

电影可以按照题材分类,那么如何区分 `动作片` 和 `爱情片` 呢?<br/>

|

||||

1. 动作片:打斗次数更多

|

||||

2. 爱情片:亲吻次数更多

|

||||

1. 动作片: 打斗次数更多

|

||||

2. 爱情片: 亲吻次数更多

|

||||

|

||||

基于电影中的亲吻、打斗出现的次数,使用 k-近邻算法构造程序,就可以自动划分电影的题材类型。

|

||||

|

||||

@@ -47,20 +47,20 @@ knn 算法按照距离最近的三部电影的类型,决定未知电影的类

|

||||

> KNN 开发流程

|

||||

|

||||

```

|

||||

收集数据:任何方法

|

||||

准备数据:距离计算所需要的数值,最好是结构化的数据格式

|

||||

分析数据:任何方法

|

||||

训练算法:此步骤不适用于 k-近邻算法

|

||||

测试算法:计算错误率

|

||||

使用算法:输入样本数据和结构化的输出结果,然后运行 k-近邻算法判断输入数据分类属于哪个分类,最后对计算出的分类执行后续处理

|

||||

收集数据: 任何方法

|

||||

准备数据: 距离计算所需要的数值,最好是结构化的数据格式

|

||||

分析数据: 任何方法

|

||||

训练算法: 此步骤不适用于 k-近邻算法

|

||||

测试算法: 计算错误率

|

||||

使用算法: 输入样本数据和结构化的输出结果,然后运行 k-近邻算法判断输入数据分类属于哪个分类,最后对计算出的分类执行后续处理

|

||||

```

|

||||

|

||||

> KNN 算法特点

|

||||

|

||||

```

|

||||

优点:精度高、对异常值不敏感、无数据输入假定

|

||||

缺点:计算复杂度高、空间复杂度高

|

||||

适用数据范围:数值型和标称型

|

||||

优点: 精度高、对异常值不敏感、无数据输入假定

|

||||

缺点: 计算复杂度高、空间复杂度高

|

||||

适用数据范围: 数值型和标称型

|

||||

```

|

||||

|

||||

## KNN 项目案例

|

||||

@@ -76,7 +76,7 @@ knn 算法按照距离最近的三部电影的类型,决定未知电影的类

|

||||

* 魅力一般的人

|

||||

* 极具魅力的人

|

||||

|

||||

她希望:

|

||||

她希望:

|

||||

1. 工作日与魅力一般的人约会

|

||||

2. 周末与极具魅力的人约会

|

||||

3. 不喜欢的人则直接排除掉

|

||||

@@ -86,25 +86,25 @@ knn 算法按照距离最近的三部电影的类型,决定未知电影的类

|

||||

#### 开发流程

|

||||

|

||||

```

|

||||

收集数据:提供文本文件

|

||||

准备数据:使用 Python 解析文本文件

|

||||

分析数据:使用 Matplotlib 画二维散点图

|

||||

训练算法:此步骤不适用于 k-近邻算法

|

||||

测试算法:使用海伦提供的部分数据作为测试样本。

|

||||

测试样本和非测试样本的区别在于:

|

||||

收集数据: 提供文本文件

|

||||

准备数据: 使用 Python 解析文本文件

|

||||

分析数据: 使用 Matplotlib 画二维散点图

|

||||

训练算法: 此步骤不适用于 k-近邻算法

|

||||

测试算法: 使用海伦提供的部分数据作为测试样本。

|

||||

测试样本和非测试样本的区别在于:

|

||||

测试样本是已经完成分类的数据,如果预测分类与实际类别不同,则标记为一个错误。

|

||||

使用算法:产生简单的命令行程序,然后海伦可以输入一些特征数据以判断对方是否为自己喜欢的类型。

|

||||

使用算法: 产生简单的命令行程序,然后海伦可以输入一些特征数据以判断对方是否为自己喜欢的类型。

|

||||

```

|

||||

|

||||

> 收集数据:提供文本文件

|

||||

> 收集数据: 提供文本文件

|

||||

|

||||

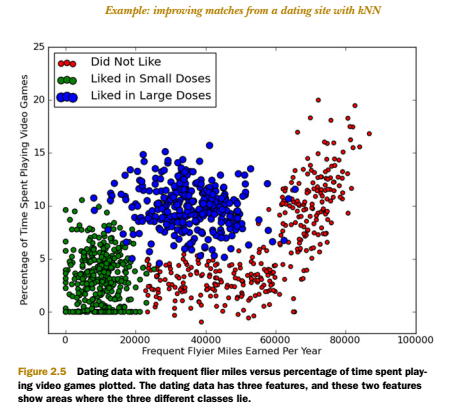

海伦把这些约会对象的数据存放在文本文件 [datingTestSet2.txt](/data/2.KNN/datingTestSet2.txt) 中,总共有 1000 行。海伦约会的对象主要包含以下 3 种特征:

|

||||

海伦把这些约会对象的数据存放在文本文件 [datingTestSet2.txt](/data/2.KNN/datingTestSet2.txt) 中,总共有 1000 行。海伦约会的对象主要包含以下 3 种特征:

|

||||

|

||||

* 每年获得的飞行常客里程数

|

||||

* 玩视频游戏所耗时间百分比

|

||||

* 每周消费的冰淇淋公升数

|

||||

|

||||

文本文件数据格式如下:

|

||||

文本文件数据格式如下:

|

||||

```

|

||||

40920 8.326976 0.953952 3

|

||||

14488 7.153469 1.673904 2

|

||||

@@ -112,7 +112,7 @@ knn 算法按照距离最近的三部电影的类型,决定未知电影的类

|

||||

75136 13.147394 0.428964 1

|

||||

38344 1.669788 0.134296 1

|

||||

```

|

||||

> 准备数据:使用 Python 解析文本文件

|

||||

> 准备数据: 使用 Python 解析文本文件

|

||||

|

||||

将文本记录转换为 NumPy 的解析程序

|

||||

|

||||

@@ -130,7 +130,7 @@ def file2matrix(filename):

|

||||

# 获得文件中的数据行的行数

|

||||

numberOfLines = len(fr.readlines())

|

||||

# 生成对应的空矩阵

|

||||

# 例如:zeros(2,3)就是生成一个 2*3的矩阵,各个位置上全是 0

|

||||

# 例如: zeros(2,3)就是生成一个 2*3的矩阵,各个位置上全是 0

|

||||

returnMat = zeros((numberOfLines, 3)) # prepare matrix to return

|

||||

classLabelVector = [] # prepare labels return

|

||||

fr = open(filename)

|

||||

@@ -149,7 +149,7 @@ def file2matrix(filename):

|

||||

return returnMat, classLabelVector

|

||||

```

|

||||

|

||||

> 分析数据:使用 Matplotlib 画二维散点图

|

||||

> 分析数据: 使用 Matplotlib 画二维散点图

|

||||

|

||||

```python

|

||||

import matplotlib

|

||||

@@ -164,7 +164,7 @@ plt.show()

|

||||

|

||||

|

||||

|

||||

* 归一化数据 (归一化是一个让权重变为统一的过程,更多细节请参考: https://www.zhihu.com/question/19951858 )

|

||||

* 归一化数据 (归一化是一个让权重变为统一的过程,更多细节请参考: https://www.zhihu.com/question/19951858 )

|

||||

|

||||

| 序号 | 玩视频游戏所耗时间百分比 | 每年获得的飞行常客里程数 | 每周消费的冰淇淋公升数 | 样本分类 |

|

||||

| ------------- |:-------------:| -----:| -----:| -----:|

|

||||

@@ -173,34 +173,34 @@ plt.show()

|

||||

| 3 | 0 | 20 000 | 1.1 | 2 |

|

||||

| 4 | 67 | 32 000 | 0.1 | 2 |

|

||||

|

||||

样本3和样本4的距离:

|

||||

样本3和样本4的距离:

|

||||

$$\sqrt{(0-67)^2 + (20000-32000)^2 + (1.1-0.1)^2 }$$

|

||||

|

||||

归一化特征值,消除特征之间量级不同导致的影响

|

||||

|

||||

**归一化定义:** 我是这样认为的,归一化就是要把你需要处理的数据经过处理后(通过某种算法)限制在你需要的一定范围内。首先归一化是为了后面数据处理的方便,其次是保正程序运行时收敛加快。 方法有如下:

|

||||

**归一化定义: ** 我是这样认为的,归一化就是要把你需要处理的数据经过处理后(通过某种算法)限制在你需要的一定范围内。首先归一化是为了后面数据处理的方便,其次是保正程序运行时收敛加快。 方法有如下:

|

||||

|

||||

1) 线性函数转换,表达式如下:

|

||||

1) 线性函数转换,表达式如下:

|

||||

|

||||

y=(x-MinValue)/(MaxValue-MinValue)

|

||||

|

||||

说明:x、y分别为转换前、后的值,MaxValue、MinValue分别为样本的最大值和最小值。

|

||||

说明: x、y分别为转换前、后的值,MaxValue、MinValue分别为样本的最大值和最小值。

|

||||

|

||||

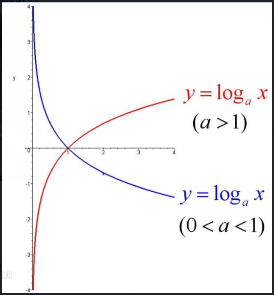

2) 对数函数转换,表达式如下:

|

||||

2) 对数函数转换,表达式如下:

|

||||

|

||||

y=log10(x)

|

||||

|

||||

说明:以10为底的对数函数转换。

|

||||

说明: 以10为底的对数函数转换。

|

||||

|

||||

如图:

|

||||

如图:

|

||||

|

||||

|

||||

|

||||

3) 反余切函数转换,表达式如下:

|

||||

3) 反余切函数转换,表达式如下:

|

||||

|

||||

y=arctan(x)*2/PI

|

||||

|

||||

如图:

|

||||

如图:

|

||||

|

||||

|

||||

|

||||

@@ -220,7 +220,7 @@ def autoNorm(dataSet):

|

||||

return:

|

||||

归一化后的数据集 normDataSet. ranges和minVals即最小值与范围,并没有用到

|

||||

|

||||

归一化公式:

|

||||

归一化公式:

|

||||

Y = (X-Xmin)/(Xmax-Xmin)

|

||||

其中的 min 和 max 分别是数据集中的最小特征值和最大特征值。该函数可以自动将数字特征值转化为0到1的区间。

|

||||

"""

|

||||

@@ -238,15 +238,15 @@ def autoNorm(dataSet):

|

||||

return normDataSet, ranges, minVals

|

||||

```

|

||||

|

||||

> 训练算法:此步骤不适用于 k-近邻算法

|

||||

> 训练算法: 此步骤不适用于 k-近邻算法

|

||||

|

||||

因为测试数据每一次都要与全量的训练数据进行比较,所以这个过程是没有必要的。

|

||||

|

||||

kNN 算法伪代码:

|

||||

kNN 算法伪代码:

|

||||

|

||||

对于每一个在数据集中的数据点:

|

||||

对于每一个在数据集中的数据点:

|

||||

计算目标的数据点(需要分类的数据点)与该数据点的距离

|

||||

将距离排序:从小到大

|

||||

将距离排序: 从小到大

|

||||

选取前K个最短距离

|

||||

选取这K个中最多的分类类别

|

||||

返回该类别来作为目标数据点的预测值

|

||||

@@ -259,11 +259,11 @@ def classify0(inX, dataSet, labels, k):

|

||||

sqDistances = sqDiffMat.sum(axis=1)

|

||||

distances = sqDistances**0.5

|

||||

|

||||

#将距离排序:从小到大

|

||||

#将距离排序: 从小到大

|

||||

sortedDistIndicies = distances.argsort()

|

||||

#选取前K个最短距离, 选取这K个中最多的分类类别

|

||||

classCount={}

|

||||

for i in range(k):

|

||||

for i in range(k):

|

||||

voteIlabel = labels[sortedDistIndicies[i]]

|

||||

classCount[voteIlabel] = classCount.get(voteIlabel,0) + 1

|

||||

sortedClassCount = sorted(classCount.iteritems(), key=operator.itemgetter(1), reverse=True)

|

||||

@@ -271,7 +271,7 @@ def classify0(inX, dataSet, labels, k):

|

||||

```

|

||||

|

||||

|

||||

> 测试算法:使用海伦提供的部分数据作为测试样本。如果预测分类与实际类别不同,则标记为一个错误。

|

||||

> 测试算法: 使用海伦提供的部分数据作为测试样本。如果预测分类与实际类别不同,则标记为一个错误。

|

||||

|

||||

kNN 分类器针对约会网站的测试代码

|

||||

|

||||

@@ -306,7 +306,7 @@ def datingClassTest():

|

||||

print errorCount

|

||||

```

|

||||

|

||||

> 使用算法:产生简单的命令行程序,然后海伦可以输入一些特征数据以判断对方是否为自己喜欢的类型。

|

||||

> 使用算法: 产生简单的命令行程序,然后海伦可以输入一些特征数据以判断对方是否为自己喜欢的类型。

|

||||

|

||||

约会网站预测函数

|

||||

|

||||

@@ -343,19 +343,19 @@ You will probably like this person: in small doses

|

||||

|

||||

构造一个能识别数字 0 到 9 的基于 KNN 分类器的手写数字识别系统。

|

||||

|

||||

需要识别的数字是存储在文本文件中的具有相同的色彩和大小:宽高是 32 像素 * 32 像素的黑白图像。

|

||||

需要识别的数字是存储在文本文件中的具有相同的色彩和大小: 宽高是 32 像素 * 32 像素的黑白图像。

|

||||

|

||||

#### 开发流程

|

||||

|

||||

```

|

||||

收集数据:提供文本文件。

|

||||

准备数据:编写函数 img2vector(), 将图像格式转换为分类器使用的向量格式

|

||||

分析数据:在 Python 命令提示符中检查数据,确保它符合要求

|

||||

训练算法:此步骤不适用于 KNN

|

||||

测试算法:编写函数使用提供的部分数据集作为测试样本,测试样本与非测试样本的

|

||||

收集数据: 提供文本文件。

|

||||

准备数据: 编写函数 img2vector(), 将图像格式转换为分类器使用的向量格式

|

||||

分析数据: 在 Python 命令提示符中检查数据,确保它符合要求

|

||||

训练算法: 此步骤不适用于 KNN

|

||||

测试算法: 编写函数使用提供的部分数据集作为测试样本,测试样本与非测试样本的

|

||||

区别在于测试样本是已经完成分类的数据,如果预测分类与实际类别不同,

|

||||

则标记为一个错误

|

||||

使用算法:本例没有完成此步骤,若你感兴趣可以构建完整的应用程序,从图像中提取

|

||||

使用算法: 本例没有完成此步骤,若你感兴趣可以构建完整的应用程序,从图像中提取

|

||||

数字,并完成数字识别,美国的邮件分拣系统就是一个实际运行的类似系统

|

||||

```

|

||||

|

||||

@@ -380,7 +380,7 @@ def img2vector(filename):

|

||||

return returnVect

|

||||

```

|

||||

|

||||

> 分析数据:在 Python 命令提示符中检查数据,确保它符合要求

|

||||

> 分析数据: 在 Python 命令提示符中检查数据,确保它符合要求

|

||||

|

||||

在 Python 命令行中输入下列命令测试 img2vector 函数,然后与文本编辑器打开的文件进行比较:

|

||||

|

||||

@@ -392,11 +392,11 @@ array([0., 0., 0., 0., 0., 0., 0., 0., 0., 0., 0., 0., 0., 0., 1., 1., 1., 1., 0

|

||||

array([0., 0., 0., 0., 0., 0., 0., 0., 0., 0., 0., 0., 1., 1., 1., 1., 1., 1., 1., 0., 0., 0., 0., 0., 0., 0., 0., 0., 0., 0., 0.])

|

||||

```

|

||||

|

||||

> 训练算法:此步骤不适用于 KNN

|

||||

> 训练算法: 此步骤不适用于 KNN

|

||||

|

||||

因为测试数据每一次都要与全量的训练数据进行比较,所以这个过程是没有必要的。

|

||||

|

||||

> 测试算法:编写函数使用提供的部分数据集作为测试样本,如果预测分类与实际类别不同,则标记为一个错误

|

||||

> 测试算法: 编写函数使用提供的部分数据集作为测试样本,如果预测分类与实际类别不同,则标记为一个错误

|

||||

|

||||

```python

|

||||

def handwritingClassTest():

|

||||

@@ -430,17 +430,17 @@ def handwritingClassTest():

|

||||

print "\nthe total error rate is: %f" % (errorCount / float(mTest))

|

||||

```

|

||||

|

||||

> 使用算法:本例没有完成此步骤,若你感兴趣可以构建完整的应用程序,从图像中提取数字,并完成数字识别,美国的邮件分拣系统就是一个实际运行的类似系统。

|

||||

> 使用算法: 本例没有完成此步骤,若你感兴趣可以构建完整的应用程序,从图像中提取数字,并完成数字识别,美国的邮件分拣系统就是一个实际运行的类似系统。

|

||||

|

||||

## KNN 小结

|

||||

|

||||

KNN 是什么?定义: 监督学习? 非监督学习?

|

||||

KNN 是什么?定义: 监督学习? 非监督学习?

|

||||

|

||||

KNN 是一个简单的无显示学习过程,非泛化学习的监督学习模型。在分类和回归中均有应用。

|

||||

|

||||

### 基本原理

|

||||

|

||||

简单来说: 通过距离度量来计算查询点(query point)与每个训练数据点的距离,然后选出与查询点(query point)相近的K个最邻点(K nearest neighbors),使用分类决策来选出对应的标签来作为该查询点的标签。

|

||||

简单来说: 通过距离度量来计算查询点(query point)与每个训练数据点的距离,然后选出与查询点(query point)相近的K个最邻点(K nearest neighbors),使用分类决策来选出对应的标签来作为该查询点的标签。

|

||||

|

||||

### KNN 三要素

|

||||

|

||||

@@ -454,7 +454,7 @@ KNN 是一个简单的无显示学习过程,非泛化学习的监督学习模

|

||||

|

||||

>>>>太大太小都不太好,可以用交叉验证(cross validation)来选取适合的k值。

|

||||

|

||||

>>>>近似误差和估计误差,请看这里:https://www.zhihu.com/question/60793482

|

||||

>>>>近似误差和估计误差,请看这里: https://www.zhihu.com/question/60793482

|

||||

|

||||

>距离度量 Metric/Distance Measure

|

||||

|

||||

@@ -464,7 +464,7 @@ KNN 是一个简单的无显示学习过程,非泛化学习的监督学习模

|

||||

|

||||

>>>>分类决策 在 分类问题中 通常为通过少数服从多数 来选取票数最多的标签,在回归问题中通常为 K个最邻点的标签的平均值。

|

||||

|

||||

### 算法:(sklearn 上有三种)

|

||||

### 算法: (sklearn 上有三种)

|

||||

|

||||

>Brute Force 暴力计算/线性扫描

|

||||

|

||||

@@ -474,27 +474,27 @@ KNN 是一个简单的无显示学习过程,非泛化学习的监督学习模

|

||||

|

||||

>树结构的算法都有建树和查询两个过程。Brute Force 没有建树的过程。

|

||||

|

||||

>算法特点:

|

||||

>算法特点:

|

||||

|

||||

>>>>优点: High Accuracy, No Assumption on data, not sensitive to outliers

|

||||

>>>>优点: High Accuracy, No Assumption on data, not sensitive to outliers

|

||||

|

||||

>>>>缺点:时间和空间复杂度 高

|

||||

>>>>缺点: 时间和空间复杂度 高

|

||||

|

||||

>>>>适用范围: continuous values and nominal values

|

||||

>>>>适用范围: continuous values and nominal values

|

||||

|

||||

>相似同源产物:

|

||||

>相似同源产物:

|

||||

|

||||

>>>>radius neighbors 根据制定的半径来找寻邻点

|

||||

|

||||

>影响算法因素:

|

||||

>影响算法因素:

|

||||

|

||||

>>>>N 数据集样本数量(number of samples), D 数据维度 (number of features)

|

||||

|

||||

>总消耗:

|

||||

>总消耗:

|

||||

|

||||

>>>>Brute Force: O[DN^2]

|

||||

|

||||

>>>>此处考虑的是最蠢的方法:把所有训练的点之间的距离都算一遍。当然有更快的实现方式, 比如 O(ND + kN) 和 O(NDK) , 最快的是 O[DN] 。感兴趣的可以阅读这个链接: [k-NN computational complexity](https://stats.stackexchange.com/questions/219655/k-nn-computational-complexity)

|

||||

>>>>此处考虑的是最蠢的方法: 把所有训练的点之间的距离都算一遍。当然有更快的实现方式, 比如 O(ND + kN) 和 O(NDK) , 最快的是 O[DN] 。感兴趣的可以阅读这个链接: [k-NN computational complexity](https://stats.stackexchange.com/questions/219655/k-nn-computational-complexity)

|

||||

|

||||

>>>>KD Tree: O[DN log(N)]

|

||||

|

||||

@@ -530,7 +530,7 @@ KNN 是一个简单的无显示学习过程,非泛化学习的监督学习模

|

||||

|

||||

>>>>查询点较少的时候用Brute Force。查询点较多的时候可以使用树结构算法。

|

||||

|

||||

>关于 sklearn 中模型的一些额外干货:

|

||||

>关于 sklearn 中模型的一些额外干货:

|

||||

|

||||

>>>>如果KD Tree,Ball Tree 和Brute Force 应用场景傻傻分不清楚,可以直接使用 含有algorithm='auto'的模组。 algorithm='auto' 自动为您选择最优算法。

|

||||

>>>>有 regressor 和 classifier 可以来选择。

|

||||

@@ -539,11 +539,11 @@ KNN 是一个简单的无显示学习过程,非泛化学习的监督学习模

|

||||

|

||||

>leaf size 对KD Tree 和 Ball Tree 的影响

|

||||

|

||||

>>>>建树时间:leaf size 比较大的时候,建树时间也就快点。

|

||||

>>>>建树时间: leaf size 比较大的时候,建树时间也就快点。

|

||||

|

||||

>>>>查询时间: leaf size 太大太小都不太好。如果leaf size 趋向于 N(训练数据的样本数量),算法其实就是 brute force了。如果leaf size 太小了,趋向于1,那查询的时候 遍历树的时间就会大大增加。leaf size 建议的数值是 30,也就是默认值。

|

||||

>>>>查询时间: leaf size 太大太小都不太好。如果leaf size 趋向于 N(训练数据的样本数量),算法其实就是 brute force了。如果leaf size 太小了,趋向于1,那查询的时候 遍历树的时间就会大大增加。leaf size 建议的数值是 30,也就是默认值。

|

||||

|

||||

>>>>内存: leaf size 变大,存树结构的内存变小。

|

||||

>>>>内存: leaf size 变大,存树结构的内存变小。

|

||||

|

||||

>Nearest Centroid Classifier

|

||||

|

||||

@@ -551,17 +551,17 @@ KNN 是一个简单的无显示学习过程,非泛化学习的监督学习模

|

||||

|

||||

>>>>该模型假设在所有维度中方差相同。 是一个很好的base line。

|

||||

|

||||

>进阶版: Nearest Shrunken Centroid

|

||||

>进阶版: Nearest Shrunken Centroid

|

||||

|

||||

>>>>可以通过shrink_threshold来设置。

|

||||

|

||||

>>>>作用: 可以移除某些影响分类的特征,例如移除噪音特征的影响

|

||||

>>>>作用: 可以移除某些影响分类的特征,例如移除噪音特征的影响

|

||||

|

||||

|

||||

|

||||

|

||||

* * *

|

||||

|

||||

* **作者:[羊三](http://cwiki.apachecn.org/display/~xuxin) [小瑶](http://cwiki.apachecn.org/display/~chenyao)**

|

||||

* **作者: [羊三](http://cwiki.apachecn.org/display/~xuxin) [小瑶](http://cwiki.apachecn.org/display/~chenyao)**

|

||||