mirror of

https://github.com/Estom/notes.git

synced 2026-04-08 05:19:22 +08:00

循环序列模型

This commit is contained in:

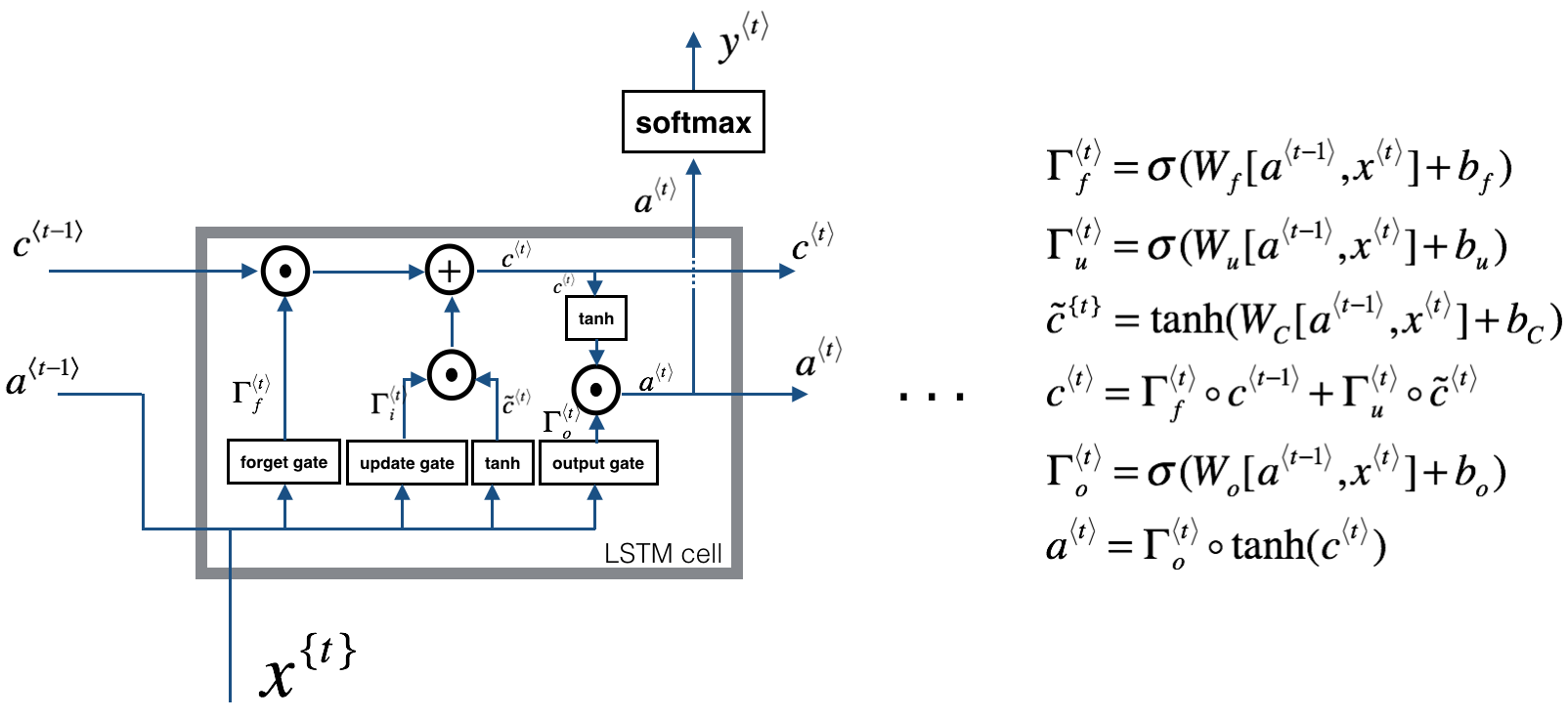

@@ -179,7 +179,7 @@ $$c^{⟨t⟩} = Γ^{⟨t⟩}_u \times \tilde c^{⟨t⟩} + Γ^{⟨t⟩}_f \times

|

||||

|

||||

$$a^{⟨t⟩} = Γ_o^{⟨t⟩} \times tanh(c^{⟨t⟩})$$-->

|

||||

|

||||

|

||||

|

||||

|

||||

将多个 LSTM 单元按时间次序连接起来,就得到一个 LSTM 网络。

|

||||

|

||||

@@ -193,7 +193,7 @@ $c^{0}$ 常被初始化为零向量。

|

||||

|

||||

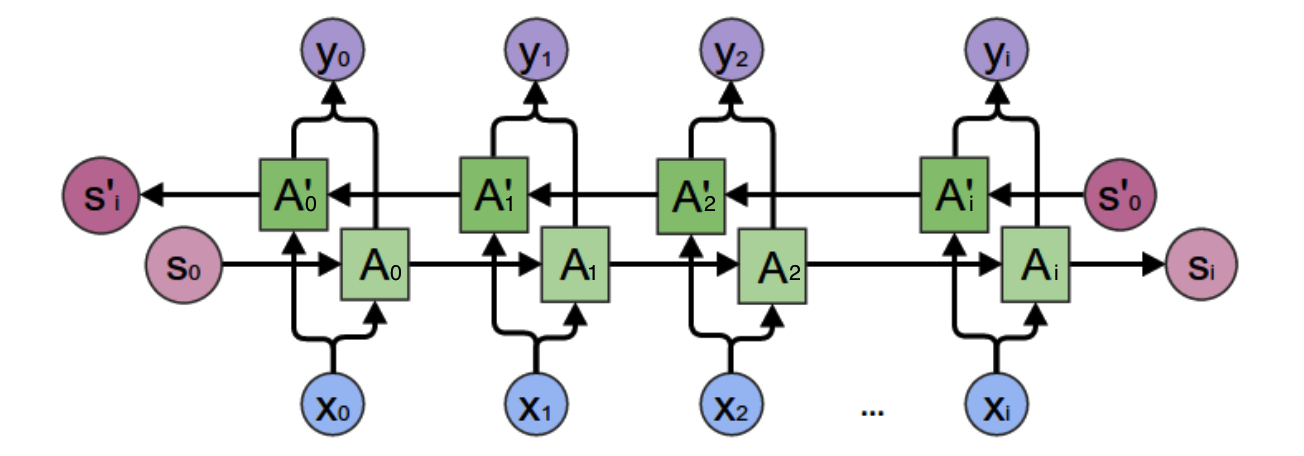

单向的循环神经网络在某一时刻的预测结果只能使用之前输入的序列信息。**双向循环神经网络(Bidirectional RNN,BRNN)**可以在序列的任意位置使用之前和之后的数据。其工作原理是增加一个反向循环层,结构如下图所示:

|

||||

|

||||

|

||||

|

||||

|

||||

因此,有

|

||||

|

||||

@@ -205,7 +205,7 @@ $$y^{⟨t⟩} = g(W_y[\overrightarrow a^{⟨t⟩}, \overleftarrow a^{⟨t⟩}]

|

||||

|

||||

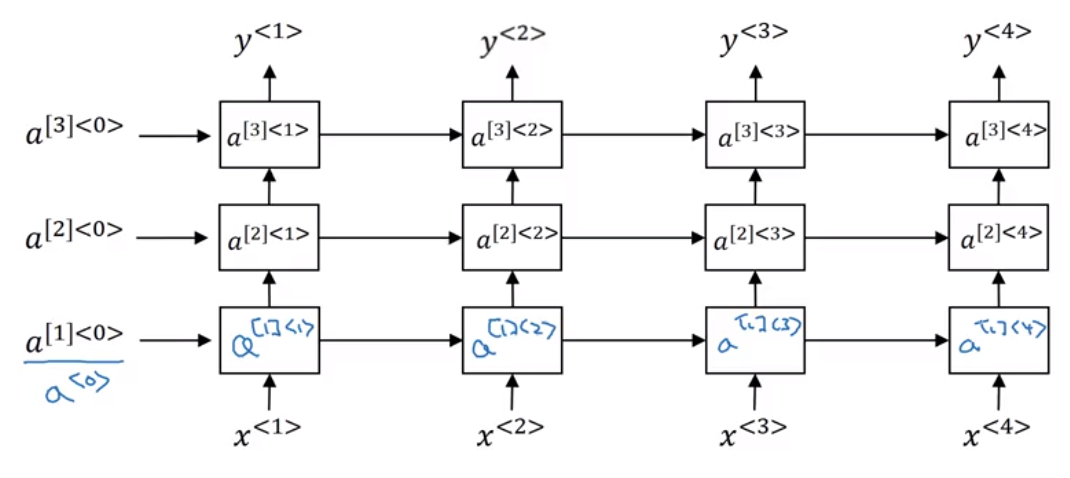

循环神经网络的每个时间步上也可以包含多个隐藏层,形成**深度循环神经网络(Deep RNN)**。结构如下图所示:

|

||||

|

||||

|

||||

|

||||

|

||||

以 $a^{[2]⟨3⟩}$为例,有 $a^{[2]⟨3⟩} = g(W_a^{[2]}[a^{[2]⟨2⟩}, a^{[1]⟨3⟩}] + b_a^{[2]})$。

|

||||

|

||||

|

||||

Reference in New Issue

Block a user