mirror of

https://github.com/Estom/notes.git

synced 2026-04-14 10:21:08 +08:00

java 教程又编辑了一会

This commit is contained in:

8

.vscode/settings.json

vendored

8

.vscode/settings.json

vendored

@@ -190,7 +190,11 @@

|

||||

],

|

||||

"java.format.settings.url": ".vscode/java-formatter.xml",

|

||||

"java.project.sourcePaths": [

|

||||

"Java源代码/Java1",

|

||||

"Java源代码/Code1"

|

||||

"Java源代码/Lesson01",

|

||||

"Java源代码/Lesson02",

|

||||

"Java源代码/Lesson03",

|

||||

"Java源代码/Lesson04",

|

||||

"Java源代码/Lesson05",

|

||||

"Java源代码/Lesson06"

|

||||

],

|

||||

}

|

||||

7

JavaScript/Bower/概述.md

Normal file

7

JavaScript/Bower/概述.md

Normal file

@@ -0,0 +1,7 @@

|

||||

Bower是一款优秀的包管理器,它由Twitter公司开发,支持以命令行的方式来对包进行搜索、下载、更新和卸载。

|

||||

|

||||

基于nodejs的模块化思想,把功能分散到各个模块中,让模块和模块之间存在联系,通过 Bower 来管理模块间的这种联系。

|

||||

|

||||

bower ,从一开始,就是专门为前端表现设计的包管理器,一切全部为前端考虑的。npm 和bower 的最大区别,就是 npm 支持嵌套地依赖管理,而 bower只能支持扁平的依赖(嵌套的依赖,由程序员自己解决)。

|

||||

|

||||

当然,bower 是运行在node.js 基础上,所以你的当前环境确保已经安装 node.js .一般来说,npm管理后台的包,bower管理前台的包

|

||||

@@ -1,8 +0,0 @@

|

||||

package com.ykl;

|

||||

public class Java01HelloWorld {

|

||||

public static void main(String[] args) {

|

||||

System.out.println("Hello");

|

||||

// System.exit(0);

|

||||

|

||||

}

|

||||

}

|

||||

@@ -1,28 +0,0 @@

|

||||

// package com.ykl.innerclass;

|

||||

import java.lang.Thread;

|

||||

/**

|

||||

* AnonymousClass

|

||||

*/

|

||||

public class AnonymousClass {

|

||||

|

||||

private int a;

|

||||

|

||||

public static void main(String[] args){

|

||||

new AnonymousClass().test(2);

|

||||

}

|

||||

|

||||

//事实证明匿名内部类

|

||||

public void test(final int a){

|

||||

int b =10;

|

||||

int c =11;

|

||||

new Thread(){

|

||||

public void run() {

|

||||

System.out.println(a);

|

||||

System.out.println(b);

|

||||

}

|

||||

}.start();

|

||||

b = 12;

|

||||

System.out.print(b);

|

||||

}

|

||||

|

||||

}

|

||||

@@ -1,5 +1,7 @@

|

||||

package com.ykl;

|

||||

|

||||

/**

|

||||

* 整个项目的启动程序

|

||||

*/

|

||||

public class HelloWorld {

|

||||

/*

|

||||

* 多行注释,可以注释一段文字

|

||||

@@ -3,6 +3,7 @@ package com.ykl;

|

||||

* @author ykl

|

||||

* @since 2022

|

||||

* @version 1.0

|

||||

* 验证前置类型转换的有效性

|

||||

*/

|

||||

public class Demo5 {

|

||||

/**

|

||||

@@ -1,5 +1,9 @@

|

||||

// package com.ykl.exceptions;

|

||||

|

||||

/**

|

||||

* Java工程目录结构

|

||||

* * src下的内容才能被识别

|

||||

*/

|

||||

public class ExceptionTest{

|

||||

public static void main(String[] args) {

|

||||

System.out.println("Hello World!");

|

||||

@@ -0,0 +1,20 @@

|

||||

package com.ykl.extentions;

|

||||

|

||||

/**

|

||||

* 验证静态变量能够被类的实例访问

|

||||

*/

|

||||

|

||||

class Book{

|

||||

private String name;

|

||||

private int price;

|

||||

static final String id="BOOK";

|

||||

public static void main(String[] args) {

|

||||

Book book = new Book();

|

||||

System.out.println(book.name);

|

||||

System.out.println(book.price);

|

||||

// 事实证明这三种方法都能够访问到类变量

|

||||

System.out.println(id);

|

||||

System.out.println(Book.id);

|

||||

System.out.println(book.id);

|

||||

}

|

||||

}

|

||||

@@ -0,0 +1,45 @@

|

||||

|

||||

import java.lang.Thread;

|

||||

/**

|

||||

* AnonymousClass

|

||||

*/

|

||||

public class AnonymousClass {

|

||||

|

||||

private int a;

|

||||

|

||||

public static void main(String[] args){

|

||||

new AnonymousClass().test(2);

|

||||

// 成员内部类需要创建对象

|

||||

AnonymousClass ac = new AnonymousClass();

|

||||

ac.new Inner().getName();

|

||||

//静态内部类可以直接访问

|

||||

new AnonymousClass.StaticInner().getName();

|

||||

}

|

||||

|

||||

public class Inner{

|

||||

public void getName(){

|

||||

System.out.println("成员内部类");

|

||||

}

|

||||

}

|

||||

|

||||

public static class StaticInner{

|

||||

public void getName(){

|

||||

System.out.println("静态内部类");

|

||||

}

|

||||

}

|

||||

|

||||

//事实证明匿名内部类必须访问final类型的变量,或者事实上final类型的变量。

|

||||

public void test(final int a){

|

||||

int b =10;

|

||||

int c =11;

|

||||

new Thread(){

|

||||

public void run() {

|

||||

System.out.println(a);

|

||||

System.out.println(b);

|

||||

}

|

||||

}.start();

|

||||

// b = 12;

|

||||

System.out.print(b);

|

||||

}

|

||||

|

||||

}

|

||||

@@ -0,0 +1,31 @@

|

||||

package com.ykl.innerclass;

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

public class PartialDemo {

|

||||

static String name = "王五";

|

||||

String name2 = "周七";

|

||||

public void demo() {

|

||||

String name = "张三";

|

||||

class Inner{

|

||||

String name = "李四";

|

||||

public void showInner(String name) {

|

||||

System.out.println("这是外部类变量:"+PartialDemo.this.name2);

|

||||

System.out.println("这是外部类变量(静态变量可以):"+PartialDemo.name);

|

||||

System.out.println("这是方法中局部变量变量:"+name);

|

||||

System.out.println("这是局部内部类中的变量:"+this.name);

|

||||

|

||||

}

|

||||

}

|

||||

Inner inner=new Inner();

|

||||

inner.showInner(name);

|

||||

}

|

||||

|

||||

public static void main(String[] args) {

|

||||

PartialDemo partialDemo = new PartialDemo();

|

||||

partialDemo.demo();

|

||||

}

|

||||

|

||||

}

|

||||

@@ -1,5 +1,7 @@

|

||||

package com.ykl;

|

||||

|

||||

/**

|

||||

* 验证函数重载和类型转换的优先级

|

||||

*/

|

||||

|

||||

import java.sql.Array;

|

||||

|

||||

@@ -2,6 +2,9 @@ package com.ykl;

|

||||

|

||||

import java.util.Scanner;

|

||||

|

||||

/**

|

||||

* 验证scanner输入输出的有效性

|

||||

*/

|

||||

public class ScannerTest {

|

||||

public static void main(String[] args) {

|

||||

Scanner s = new Scanner(System.in);

|

||||

@@ -0,0 +1,23 @@

|

||||

package com.ykl.wrapper;

|

||||

|

||||

/**

|

||||

* 用来验证拆箱装箱的有效性

|

||||

*/

|

||||

public class WrapperTest {

|

||||

public static void main(String[] args) {

|

||||

int a=1;

|

||||

int b=2;

|

||||

|

||||

Integer c =1;

|

||||

Integer d =2;

|

||||

Integer e =new Integer(1);

|

||||

System.out.println(a==b);

|

||||

System.out.println(a==c);

|

||||

System.out.println(c==d);

|

||||

System.out.println(c==e);//不拆箱

|

||||

System.out.println(c.equals(d));

|

||||

System.out.println(c.equals(e));

|

||||

System.out.println(e.equals(a));//类型不转换

|

||||

|

||||

}

|

||||

}

|

||||

3

Java基础教程/Java源代码/Lesson02/.idea/.gitignore

generated

vendored

3

Java基础教程/Java源代码/Lesson02/.idea/.gitignore

generated

vendored

@@ -1,3 +0,0 @@

|

||||

# Default ignored files

|

||||

/shelf/

|

||||

/workspace.xml

|

||||

12

Java基础教程/Java源代码/Lesson02/.idea/basicLesson/pom.xml

generated

12

Java基础教程/Java源代码/Lesson02/.idea/basicLesson/pom.xml

generated

@@ -1,12 +0,0 @@

|

||||

<?xml version="1.0" encoding="UTF-8"?>

|

||||

<project xmlns="http://maven.apache.org/POM/4.0.0"

|

||||

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

|

||||

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

|

||||

<modelVersion>4.0.0</modelVersion>

|

||||

|

||||

<groupId>org.example</groupId>

|

||||

<artifactId>basicLesson</artifactId>

|

||||

<version>1.0-SNAPSHOT</version>

|

||||

|

||||

|

||||

</project>

|

||||

@@ -1,24 +0,0 @@

|

||||

/**

|

||||

* Alipay.com Inc.

|

||||

* Copyright (c) 2004-2022 All Rights Reserved.

|

||||

*/

|

||||

package com.ykl;

|

||||

|

||||

/**

|

||||

* @author yinkanglong

|

||||

* @version : Application, v 0.1 2022-07-11 09:20 yinkanglong Exp $

|

||||

*/

|

||||

public class Application {

|

||||

public static void main(String[] args) {

|

||||

String a = "test";

|

||||

String b = "test";

|

||||

String c = new String("test");

|

||||

String d = new String("test");

|

||||

|

||||

System.out.println(a==b);

|

||||

System.out.println(c==d);

|

||||

System.out.println("hello world");

|

||||

|

||||

|

||||

}

|

||||

}

|

||||

@@ -1,38 +0,0 @@

|

||||

/**

|

||||

* Alipay.com Inc.

|

||||

* Copyright (c) 2004-2022 All Rights Reserved.

|

||||

*/

|

||||

package com.ykl.annotationtest;

|

||||

|

||||

import java.lang.reflect.Field;

|

||||

import java.lang.reflect.Method;

|

||||

|

||||

/**

|

||||

* @author yinkanglong

|

||||

* @version : AnnotationTest, v 0.1 2022-07-12 09:50 yinkanglong Exp $

|

||||

*/

|

||||

public class AnnotationTest {

|

||||

|

||||

public static void main(String[] args) throws Exception {

|

||||

// 获取类上的注解

|

||||

Class<Demo> clazz = Demo.class;

|

||||

MyAnnotation annotationOnClass = clazz.getAnnotation(MyAnnotation.class);

|

||||

System.out.println(annotationOnClass.getValue());

|

||||

|

||||

// 获取成员变量上的注解

|

||||

Field name = clazz.getField("name");

|

||||

MyAnnotation annotationOnField = name.getAnnotation(MyAnnotation.class);

|

||||

System.out.println(annotationOnField.getValue());

|

||||

|

||||

// 获取hello方法上的注解

|

||||

Method hello = clazz.getMethod("hello", (Class<?>[]) null);

|

||||

MyAnnotation annotationOnMethod = hello.getAnnotation(MyAnnotation.class);

|

||||

System.out.println(annotationOnMethod.getValue());

|

||||

|

||||

// 获取defaultMethod方法上的注解

|

||||

Method defaultMethod = clazz.getMethod("defaultMethod", (Class<?>[]) null);

|

||||

MyAnnotation annotationOnDefaultMethod = defaultMethod.getAnnotation(MyAnnotation.class);

|

||||

System.out.println(annotationOnDefaultMethod.getValue());

|

||||

|

||||

}

|

||||

}

|

||||

@@ -1,25 +0,0 @@

|

||||

/**

|

||||

* Alipay.com Inc.

|

||||

* Copyright (c) 2004-2022 All Rights Reserved.

|

||||

*/

|

||||

package com.ykl.annotationtest;

|

||||

|

||||

/**

|

||||

* @author yinkanglong

|

||||

* @version : Demo, v 0.1 2022-07-12 09:49 yinkanglong Exp $

|

||||

*/

|

||||

/**

|

||||

* @author qiyu

|

||||

*/

|

||||

@MyAnnotation(getValue = "annotation on class")

|

||||

public class Demo {

|

||||

|

||||

@MyAnnotation(getValue = "annotation on field")

|

||||

public String name;

|

||||

|

||||

@MyAnnotation(getValue = "annotation on method")

|

||||

public void hello() {}

|

||||

|

||||

@MyAnnotation() // 故意不指定getValue

|

||||

public void defaultMethod() {}

|

||||

}

|

||||

@@ -1,17 +0,0 @@

|

||||

/**

|

||||

* Alipay.com Inc.

|

||||

* Copyright (c) 2004-2022 All Rights Reserved.

|

||||

*/

|

||||

package com.ykl.annotationtest;

|

||||

|

||||

import java.lang.annotation.Retention;

|

||||

import java.lang.annotation.RetentionPolicy;

|

||||

|

||||

/**

|

||||

* @author yinkanglong

|

||||

* @version : MyAnnotation, v 0.1 2022-07-12 09:48 yinkanglong Exp $

|

||||

*/

|

||||

@Retention(RetentionPolicy.RUNTIME)

|

||||

public @interface MyAnnotation {

|

||||

String getValue() default "no description";

|

||||

}

|

||||

@@ -1,27 +0,0 @@

|

||||

/**

|

||||

* Alipay.com Inc.

|

||||

* Copyright (c) 2004-2022 All Rights Reserved.

|

||||

*/

|

||||

package com.ykl.eceptiontest;

|

||||

|

||||

/**

|

||||

* @author yinkanglong

|

||||

* @version : ExceptionTest, v 0.1 2022-07-11 19:45 yinkanglong Exp $

|

||||

*/

|

||||

public class ExceptionTest {

|

||||

|

||||

public static void main(String args[]) {

|

||||

int a[] = new int[2];

|

||||

try {

|

||||

System.out.println("Access element three :" + a[3]);

|

||||

} catch (ArrayIndexOutOfBoundsException e) {

|

||||

System.out.println("Exception thrown :" + e);

|

||||

return ;

|

||||

} finally {

|

||||

a[0] = 6;

|

||||

System.out.println("First element value: " + a[0]);

|

||||

System.out.println("The finally statement is executed");

|

||||

}

|

||||

}

|

||||

}

|

||||

|

||||

15

Java基础教程/Java源代码/Lesson02/.idea/misc.xml

generated

15

Java基础教程/Java源代码/Lesson02/.idea/misc.xml

generated

@@ -1,15 +0,0 @@

|

||||

<?xml version="1.0" encoding="UTF-8"?>

|

||||

<project version="4">

|

||||

<component name="JavadocGenerationManager">

|

||||

<option name="OUTPUT_DIRECTORY" value="$PROJECT_DIR$/.." />

|

||||

<option name="OPTION_SCOPE" value="private" />

|

||||

<option name="OPTION_DOCUMENT_TAG_USE" value="true" />

|

||||

<option name="OPTION_DOCUMENT_TAG_AUTHOR" value="true" />

|

||||

<option name="OPTION_DOCUMENT_TAG_VERSION" value="true" />

|

||||

<option name="OTHER_OPTIONS" value="-encoding utf-8 -charset utf-8" />

|

||||

<option name="LOCALE" value="zh_CN" />

|

||||

</component>

|

||||

<component name="ProjectRootManager" version="2" languageLevel="JDK_1_8" project-jdk-name="1.8" project-jdk-type="JavaSDK">

|

||||

<output url="file://$PROJECT_DIR$/out" />

|

||||

</component>

|

||||

</project>

|

||||

9

Java基础教程/Java源代码/Lesson02/.idea/modules.xml

generated

9

Java基础教程/Java源代码/Lesson02/.idea/modules.xml

generated

@@ -1,9 +0,0 @@

|

||||

<?xml version="1.0" encoding="UTF-8"?>

|

||||

<project version="4">

|

||||

<component name="ProjectModuleManager">

|

||||

<modules>

|

||||

<module fileurl="file://$PROJECT_DIR$/BasicLanguage/BasicLanguage.iml" filepath="$PROJECT_DIR$/BasicLanguage/BasicLanguage.iml" />

|

||||

<module fileurl="file://$PROJECT_DIR$/Lesson02.iml" filepath="$PROJECT_DIR$/Lesson02.iml" />

|

||||

</modules>

|

||||

</component>

|

||||

</project>

|

||||

124

Java基础教程/Java源代码/Lesson02/.idea/uiDesigner.xml

generated

124

Java基础教程/Java源代码/Lesson02/.idea/uiDesigner.xml

generated

@@ -1,124 +0,0 @@

|

||||

<?xml version="1.0" encoding="UTF-8"?>

|

||||

<project version="4">

|

||||

<component name="Palette2">

|

||||

<group name="Swing">

|

||||

<item class="com.intellij.uiDesigner.HSpacer" tooltip-text="Horizontal Spacer" icon="/com/intellij/uiDesigner/icons/hspacer.svg" removable="false" auto-create-binding="false" can-attach-label="false">

|

||||

<default-constraints vsize-policy="1" hsize-policy="6" anchor="0" fill="1" />

|

||||

</item>

|

||||

<item class="com.intellij.uiDesigner.VSpacer" tooltip-text="Vertical Spacer" icon="/com/intellij/uiDesigner/icons/vspacer.svg" removable="false" auto-create-binding="false" can-attach-label="false">

|

||||

<default-constraints vsize-policy="6" hsize-policy="1" anchor="0" fill="2" />

|

||||

</item>

|

||||

<item class="javax.swing.JPanel" icon="/com/intellij/uiDesigner/icons/panel.svg" removable="false" auto-create-binding="false" can-attach-label="false">

|

||||

<default-constraints vsize-policy="3" hsize-policy="3" anchor="0" fill="3" />

|

||||

</item>

|

||||

<item class="javax.swing.JScrollPane" icon="/com/intellij/uiDesigner/icons/scrollPane.svg" removable="false" auto-create-binding="false" can-attach-label="true">

|

||||

<default-constraints vsize-policy="7" hsize-policy="7" anchor="0" fill="3" />

|

||||

</item>

|

||||

<item class="javax.swing.JButton" icon="/com/intellij/uiDesigner/icons/button.svg" removable="false" auto-create-binding="true" can-attach-label="false">

|

||||

<default-constraints vsize-policy="0" hsize-policy="3" anchor="0" fill="1" />

|

||||

<initial-values>

|

||||

<property name="text" value="Button" />

|

||||

</initial-values>

|

||||

</item>

|

||||

<item class="javax.swing.JRadioButton" icon="/com/intellij/uiDesigner/icons/radioButton.svg" removable="false" auto-create-binding="true" can-attach-label="false">

|

||||

<default-constraints vsize-policy="0" hsize-policy="3" anchor="8" fill="0" />

|

||||

<initial-values>

|

||||

<property name="text" value="RadioButton" />

|

||||

</initial-values>

|

||||

</item>

|

||||

<item class="javax.swing.JCheckBox" icon="/com/intellij/uiDesigner/icons/checkBox.svg" removable="false" auto-create-binding="true" can-attach-label="false">

|

||||

<default-constraints vsize-policy="0" hsize-policy="3" anchor="8" fill="0" />

|

||||

<initial-values>

|

||||

<property name="text" value="CheckBox" />

|

||||

</initial-values>

|

||||

</item>

|

||||

<item class="javax.swing.JLabel" icon="/com/intellij/uiDesigner/icons/label.svg" removable="false" auto-create-binding="false" can-attach-label="false">

|

||||

<default-constraints vsize-policy="0" hsize-policy="0" anchor="8" fill="0" />

|

||||

<initial-values>

|

||||

<property name="text" value="Label" />

|

||||

</initial-values>

|

||||

</item>

|

||||

<item class="javax.swing.JTextField" icon="/com/intellij/uiDesigner/icons/textField.svg" removable="false" auto-create-binding="true" can-attach-label="true">

|

||||

<default-constraints vsize-policy="0" hsize-policy="6" anchor="8" fill="1">

|

||||

<preferred-size width="150" height="-1" />

|

||||

</default-constraints>

|

||||

</item>

|

||||

<item class="javax.swing.JPasswordField" icon="/com/intellij/uiDesigner/icons/passwordField.svg" removable="false" auto-create-binding="true" can-attach-label="true">

|

||||

<default-constraints vsize-policy="0" hsize-policy="6" anchor="8" fill="1">

|

||||

<preferred-size width="150" height="-1" />

|

||||

</default-constraints>

|

||||

</item>

|

||||

<item class="javax.swing.JFormattedTextField" icon="/com/intellij/uiDesigner/icons/formattedTextField.svg" removable="false" auto-create-binding="true" can-attach-label="true">

|

||||

<default-constraints vsize-policy="0" hsize-policy="6" anchor="8" fill="1">

|

||||

<preferred-size width="150" height="-1" />

|

||||

</default-constraints>

|

||||

</item>

|

||||

<item class="javax.swing.JTextArea" icon="/com/intellij/uiDesigner/icons/textArea.svg" removable="false" auto-create-binding="true" can-attach-label="true">

|

||||

<default-constraints vsize-policy="6" hsize-policy="6" anchor="0" fill="3">

|

||||

<preferred-size width="150" height="50" />

|

||||

</default-constraints>

|

||||

</item>

|

||||

<item class="javax.swing.JTextPane" icon="/com/intellij/uiDesigner/icons/textPane.svg" removable="false" auto-create-binding="true" can-attach-label="true">

|

||||

<default-constraints vsize-policy="6" hsize-policy="6" anchor="0" fill="3">

|

||||

<preferred-size width="150" height="50" />

|

||||

</default-constraints>

|

||||

</item>

|

||||

<item class="javax.swing.JEditorPane" icon="/com/intellij/uiDesigner/icons/editorPane.svg" removable="false" auto-create-binding="true" can-attach-label="true">

|

||||

<default-constraints vsize-policy="6" hsize-policy="6" anchor="0" fill="3">

|

||||

<preferred-size width="150" height="50" />

|

||||

</default-constraints>

|

||||

</item>

|

||||

<item class="javax.swing.JComboBox" icon="/com/intellij/uiDesigner/icons/comboBox.svg" removable="false" auto-create-binding="true" can-attach-label="true">

|

||||

<default-constraints vsize-policy="0" hsize-policy="2" anchor="8" fill="1" />

|

||||

</item>

|

||||

<item class="javax.swing.JTable" icon="/com/intellij/uiDesigner/icons/table.svg" removable="false" auto-create-binding="true" can-attach-label="false">

|

||||

<default-constraints vsize-policy="6" hsize-policy="6" anchor="0" fill="3">

|

||||

<preferred-size width="150" height="50" />

|

||||

</default-constraints>

|

||||

</item>

|

||||

<item class="javax.swing.JList" icon="/com/intellij/uiDesigner/icons/list.svg" removable="false" auto-create-binding="true" can-attach-label="false">

|

||||

<default-constraints vsize-policy="6" hsize-policy="2" anchor="0" fill="3">

|

||||

<preferred-size width="150" height="50" />

|

||||

</default-constraints>

|

||||

</item>

|

||||

<item class="javax.swing.JTree" icon="/com/intellij/uiDesigner/icons/tree.svg" removable="false" auto-create-binding="true" can-attach-label="false">

|

||||

<default-constraints vsize-policy="6" hsize-policy="6" anchor="0" fill="3">

|

||||

<preferred-size width="150" height="50" />

|

||||

</default-constraints>

|

||||

</item>

|

||||

<item class="javax.swing.JTabbedPane" icon="/com/intellij/uiDesigner/icons/tabbedPane.svg" removable="false" auto-create-binding="true" can-attach-label="false">

|

||||

<default-constraints vsize-policy="3" hsize-policy="3" anchor="0" fill="3">

|

||||

<preferred-size width="200" height="200" />

|

||||

</default-constraints>

|

||||

</item>

|

||||

<item class="javax.swing.JSplitPane" icon="/com/intellij/uiDesigner/icons/splitPane.svg" removable="false" auto-create-binding="false" can-attach-label="false">

|

||||

<default-constraints vsize-policy="3" hsize-policy="3" anchor="0" fill="3">

|

||||

<preferred-size width="200" height="200" />

|

||||

</default-constraints>

|

||||

</item>

|

||||

<item class="javax.swing.JSpinner" icon="/com/intellij/uiDesigner/icons/spinner.svg" removable="false" auto-create-binding="true" can-attach-label="true">

|

||||

<default-constraints vsize-policy="0" hsize-policy="6" anchor="8" fill="1" />

|

||||

</item>

|

||||

<item class="javax.swing.JSlider" icon="/com/intellij/uiDesigner/icons/slider.svg" removable="false" auto-create-binding="true" can-attach-label="false">

|

||||

<default-constraints vsize-policy="0" hsize-policy="6" anchor="8" fill="1" />

|

||||

</item>

|

||||

<item class="javax.swing.JSeparator" icon="/com/intellij/uiDesigner/icons/separator.svg" removable="false" auto-create-binding="false" can-attach-label="false">

|

||||

<default-constraints vsize-policy="6" hsize-policy="6" anchor="0" fill="3" />

|

||||

</item>

|

||||

<item class="javax.swing.JProgressBar" icon="/com/intellij/uiDesigner/icons/progressbar.svg" removable="false" auto-create-binding="true" can-attach-label="false">

|

||||

<default-constraints vsize-policy="0" hsize-policy="6" anchor="0" fill="1" />

|

||||

</item>

|

||||

<item class="javax.swing.JToolBar" icon="/com/intellij/uiDesigner/icons/toolbar.svg" removable="false" auto-create-binding="false" can-attach-label="false">

|

||||

<default-constraints vsize-policy="0" hsize-policy="6" anchor="0" fill="1">

|

||||

<preferred-size width="-1" height="20" />

|

||||

</default-constraints>

|

||||

</item>

|

||||

<item class="javax.swing.JToolBar$Separator" icon="/com/intellij/uiDesigner/icons/toolbarSeparator.svg" removable="false" auto-create-binding="false" can-attach-label="false">

|

||||

<default-constraints vsize-policy="0" hsize-policy="0" anchor="0" fill="1" />

|

||||

</item>

|

||||

<item class="javax.swing.JScrollBar" icon="/com/intellij/uiDesigner/icons/scrollbar.svg" removable="false" auto-create-binding="true" can-attach-label="false">

|

||||

<default-constraints vsize-policy="6" hsize-policy="0" anchor="0" fill="2" />

|

||||

</item>

|

||||

</group>

|

||||

</component>

|

||||

</project>

|

||||

6

Java基础教程/Java源代码/Lesson02/.idea/vcs.xml

generated

6

Java基础教程/Java源代码/Lesson02/.idea/vcs.xml

generated

@@ -1,6 +0,0 @@

|

||||

<?xml version="1.0" encoding="UTF-8"?>

|

||||

<project version="4">

|

||||

<component name="VcsDirectoryMappings">

|

||||

<mapping directory="$PROJECT_DIR$/../.." vcs="Git" />

|

||||

</component>

|

||||

</project>

|

||||

@@ -1,11 +0,0 @@

|

||||

<?xml version="1.0" encoding="UTF-8"?>

|

||||

<module type="JAVA_MODULE" version="4">

|

||||

<component name="NewModuleRootManager" inherit-compiler-output="true">

|

||||

<exclude-output />

|

||||

<content url="file://$MODULE_DIR$">

|

||||

<sourceFolder url="file://$MODULE_DIR$/src" isTestSource="false" />

|

||||

</content>

|

||||

<orderEntry type="jdk" jdkName="1.8" jdkType="JavaSDK" />

|

||||

<orderEntry type="sourceFolder" forTests="false" />

|

||||

</component>

|

||||

</module>

|

||||

@@ -41,25 +41,50 @@ public class Dog {

|

||||

|

||||

- 成员变量Field:描述类或者对象的属性信息的。

|

||||

- 成员方法Method:描述类或者对象的行为的。

|

||||

- 构造器(构造方法,Constructor): 初始化类的一个对象返回。

|

||||

- 代码块:代码块按照有无static可以分为静态代码块和实例代码块。

|

||||

- 内部类:将一个类定义在另一个类里面或者一个方法里面,这样的类称为内部类。

|

||||

- 构造器(构造方法)Constructor: 初始化类的一个对象返回。

|

||||

- 代码块Block:代码块按照有无static可以分为静态代码块和实例代码块。

|

||||

- 内部类InnerClass:将一个类定义在另一个类里面或者一个方法里面,这样的类称为内部类。

|

||||

|

||||

|

||||

### 访问权限修饰符

|

||||

|

||||

* 如果一个类的成员变量或成员方法被修饰为private,则只能在本类中使用,在子类中不可使用,并且在其他包的类中是不可见的。

|

||||

一个类的成员变量或成员方法

|

||||

* 如果被修饰为private,则只能在本类中使用,在子类中不可使用,并且在其他包的类中是不可见的。

|

||||

* 如果被修饰为public,则在子类和其他包的类中可以使用。

|

||||

* 如果被修饰为protect,则仅在子类中可以使用。

|

||||

* 如果没有权限修饰符,默认访问权限为整个包。

|

||||

|

||||

|

||||

|

||||

## 2 成员变量Field

|

||||

### 变量类型

|

||||

|

||||

* 局部变量:在方法、构造方法或者语句块中定义的变量被称为局部变量。变量声明和初始化都是在方法中,方法结束后,变量就会自动销毁。

|

||||

* 成员变量:成员变量是定义在类中,方法体之外的变量。这种变量在创建对象的时候实例化。成员变量可以被类中方法、构造方法和特定类的语句块访问。只能通过实例化的对象进行访问

|

||||

* 成员变量:成员变量是定义在类中,方法体之外的变量。这种变量在创建对象的时候实例化。成员变量可以被类中的成员方法、构造方法和特定类的语句块访问。只能通过实例化的对象进行访问

|

||||

* 类变量:类变量也声明在类中,方法体之外,但必须声明为 static 类型。只能通过类名进行访问

|

||||

|

||||

```java

|

||||

package com.ykl.extentions;

|

||||

|

||||

/**

|

||||

* 验证静态变量能够被类的实例访问

|

||||

*/

|

||||

|

||||

class Book{

|

||||

private String name;

|

||||

private int price;

|

||||

static final String id="BOOK";

|

||||

public static void main(String[] args) {

|

||||

Book book = new Book();

|

||||

System.out.println(book.name);

|

||||

System.out.println(book.price);

|

||||

// 事实证明这三种方法都能够访问到类变量

|

||||

System.out.println(id);

|

||||

System.out.println(Book.id);

|

||||

System.out.println(book.id);

|

||||

}

|

||||

}

|

||||

```

|

||||

|

||||

### 成员变量

|

||||

|

||||

在Java中对象的属性称为成员变量。为了了解成员变量,在下面的代码中首先定义一个图书类,成员变量对应于类**对象的属性**,在Book类中设置3个成员变量,分别为id,name和category,分别对应于图书编号,图书名称和图书类别3个图书属性。

|

||||

|

||||

@@ -22,6 +22,53 @@

|

||||

|

||||

## 2 使用

|

||||

|

||||

```java

|

||||

|

||||

import java.lang.Thread;

|

||||

/**

|

||||

* AnonymousClass

|

||||

*/

|

||||

public class AnonymousClass {

|

||||

|

||||

private int a;

|

||||

|

||||

public static void main(String[] args){

|

||||

new AnonymousClass().test(2);

|

||||

// 成员内部类需要创建对象

|

||||

AnonymousClass ac = new AnonymousClass();

|

||||

ac.new Inner().getName();

|

||||

//静态内部类可以直接访问

|

||||

new AnonymousClass.StaticInner().getName();

|

||||

}

|

||||

|

||||

public class Inner{

|

||||

public void getName(){

|

||||

System.out.println("成员内部类");

|

||||

}

|

||||

}

|

||||

|

||||

public static class StaticInner{

|

||||

public void getName(){

|

||||

System.out.println("静态内部类");

|

||||

}

|

||||

}

|

||||

|

||||

//事实证明匿名内部类必须访问final类型的变量,或者事实上final类型的变量。

|

||||

public void test(final int a){

|

||||

int b =10;

|

||||

int c =11;

|

||||

new Thread(){

|

||||

public void run() {

|

||||

System.out.println(a);

|

||||

System.out.println(b);

|

||||

}

|

||||

}.start();

|

||||

// b = 12;

|

||||

System.out.print(b);

|

||||

}

|

||||

|

||||

}

|

||||

```

|

||||

### 成员内部类

|

||||

|

||||

在类的内部方法的外部编写的类就是成员内部类。

|

||||

@@ -430,7 +477,7 @@ final com.cxh.test2.Outter this$0;

|

||||

public com.cxh.test2.Outter$Inner(com.cxh.test2.Outter);

|

||||

```

|

||||

|

||||

从这里可以看出,虽然我们在定义的内部类的构造器是无参构造器,编译器还是会默认添加一个参数,该参数的类型为指向外部类对象的一个引用,所以成员内部类中的Outter this&0 指针便指向了外部类对象,因此可以在成员内部类中随意访问外部类的成员。从这里也间接说明了成员内部类是依赖于外部类的,如果没有创建外部类的对象,则无法对Outter this&0引用进行初始化赋值,也就无法创建成员内部类的对象了。、

|

||||

从这里可以看出,虽然我们在定义的内部类的构造器是无参构造器,编译器还是会默认添加一个参数,该参数的类型为指向外部类对象的一个引用,所以成员内部类中的Outter this&0 指针便指向了外部类对象,因此可以在成员内部类中随意访问外部类的成员。从这里也间接说明了成员内部类是依赖于外部类的,如果没有创建外部类的对象,则无法对Outter this&0引用进行初始化赋值,也就无法创建成员内部类的对象了。

|

||||

|

||||

|

||||

### 局部内部类和匿名内部类只能访问局部final变量

|

||||

@@ -515,3 +562,124 @@ public class Test {

|

||||

|

||||

|

||||

> 如果局部变量的值在编译期间就可以确定,则直接在匿名内部里面创建一个拷贝。如果局部变量的值无法在编译期间确定,则通过构造器传参的方式来对拷贝进行初始化赋值。

|

||||

|

||||

### 静态内部类有特殊的地方吗?

|

||||

|

||||

从前面可以知道,静态内部类是不依赖于外部类的,也就说可以在不创建外部类对象的情况下创建内部类的对象。另外,静态内部类是不持有指向外部类对象的引用的,这个读者可以自己尝试反编译class文件看一下就知道了,是没有Outter this&0引用的。

|

||||

|

||||

|

||||

## 4 常见的与内部类相关的笔试面试题

|

||||

|

||||

### 根据注释填写(1),(2),(3)处的代码

|

||||

|

||||

```java

|

||||

public class Test{

|

||||

public static void main(String[] args){

|

||||

// 初始化Bean1

|

||||

(1)

|

||||

bean1.I++;

|

||||

// 初始化Bean2

|

||||

(2)

|

||||

bean2.J++;

|

||||

//初始化Bean3

|

||||

(3)

|

||||

bean3.k++;

|

||||

}

|

||||

class Bean1{

|

||||

public int I = 0;

|

||||

}

|

||||

|

||||

static class Bean2{

|

||||

public int J = 0;

|

||||

}

|

||||

}

|

||||

|

||||

class Bean{

|

||||

class Bean3{

|

||||

public int k = 0;

|

||||

}

|

||||

}

|

||||

```

|

||||

|

||||

从前面可知,对于成员内部类,必须先产生外部类的实例化对象,才能产生内部类的实例化对象。而静态内部类不用产生外部类的实例化对象即可产生内部类的实例化对象。

|

||||

|

||||

**创建静态内部类对象的一般形式为: 外部类类名.内部类类名 xxx = new 外部类类名.内部类类名()**

|

||||

|

||||

**创建成员内部类对象的一般形式为: 外部类类名.内部类类名 xxx = 外部类对象名.new 内部类类名()**

|

||||

|

||||

因此,(1),(2),(3)处的代码分别为:

|

||||

|

||||

```java

|

||||

Test test = new Test();

|

||||

|

||||

Test.Bean1 bean1 = test.new Bean1();

|

||||

```

|

||||

|

||||

```java

|

||||

Test.Bean2 b2 = new Test.Bean2();

|

||||

```

|

||||

|

||||

```java

|

||||

Bean bean = new Bean();

|

||||

|

||||

Bean.Bean3 bean3 = bean.new Bean3();

|

||||

```

|

||||

|

||||

### 下面这段代码的输出结果是什么?

|

||||

|

||||

```java

|

||||

public class Test {

|

||||

public static void main(String[] args) {

|

||||

Outter outter = new Outter();

|

||||

outter.new Inner().print();

|

||||

}

|

||||

}

|

||||

|

||||

|

||||

class Outter

|

||||

{

|

||||

private int a = 1;

|

||||

class Inner {

|

||||

private int a = 2;

|

||||

public void print() {

|

||||

int a = 3;

|

||||

System.out.println("局部变量:" + a);

|

||||

System.out.println("内部类变量:" + this.a);

|

||||

System.out.println("外部类变量:" + Outter.this.a);

|

||||

}

|

||||

}

|

||||

}

|

||||

```

|

||||

|

||||

```shell

|

||||

3

|

||||

2

|

||||

1

|

||||

```

|

||||

|

||||

最后补充一点知识:关于成员内部类的继承问题。一般来说,内部类是很少用来作为继承用的。但是当用来继承的话,要注意两点:

|

||||

|

||||

1)成员内部类的引用方式必须为 Outter.Inner.

|

||||

|

||||

2)构造器中必须有指向外部类对象的引用,并通过这个引用调用super()。这段代码摘自《Java编程思想》

|

||||

|

||||

```java

|

||||

class WithInner {

|

||||

class Inner{

|

||||

|

||||

}

|

||||

}

|

||||

class InheritInner extends WithInner.Inner {

|

||||

|

||||

// InheritInner() 是不能通过编译的,一定要加上形参

|

||||

InheritInner(WithInner wi) {

|

||||

wi.super(); //必须有这句调用

|

||||

}

|

||||

|

||||

public static void main(String[] args) {

|

||||

WithInner wi = new WithInner();

|

||||

InheritInner obj = new InheritInner(wi);

|

||||

}

|

||||

}

|

||||

```

|

||||

|

||||

|

||||

@@ -9,7 +9,7 @@ Java 泛型(generics)是 JDK 5 中引入的一个新特性, 泛型提供了

|

||||

|

||||

|

||||

|

||||

|

||||

与C#中的泛型相比,Java的泛型可以算是“伪泛型”了。在C#中,不论是在程序源码中、在编译后的中间语言,还是在运行期泛型都是真实存在的。Java则不同,Java的泛型只在源代码存在,只供编辑器检查使用,编译后的字节码文件已擦除了泛型类型,同时在必要的地方插入了强制转型的代码。

|

||||

### 泛型的基本用法

|

||||

|

||||

```java

|

||||

|

||||

95

Java基础教程/Java语言基础/15 Java编译原理.md

Normal file

95

Java基础教程/Java语言基础/15 Java编译原理.md

Normal file

@@ -0,0 +1,95 @@

|

||||

> https://www.cnblogs.com/qingshanli/p/9281760.html

|

||||

## 1 Java编译流程

|

||||

|

||||

### 基本流程

|

||||

|

||||

* 前端编译主要指与源语言有关但与目标机无关的部分,包括词法分析、语法分析、语义分析与中间代码生成。把*.java文件转变成*.class文件

|

||||

* 后端编译主要指与目标机有关的部分,包括代码优化和目标代码生成等。指把字节码转变成机器码

|

||||

|

||||

|

||||

|

||||

|

||||

|

||||

关键工具:词法分析器、语法分析器、语义分析器和代码生成器

|

||||

|

||||

1. 读取源码,进行词法分析。也就是找出源码字节中的关键字,识别出合法的关键字,最后得出一些规范化的Token(中文意思是“标记“、”象征”等)流。

|

||||

2. 对Token流进行语法分析,检查关键词的组合是否符合语法,最后得到抽象的语法树(语法树是吧语言的主要此法用一个结构化的形式组合在一起)

|

||||

3. 进行语法分析,把难懂的,复杂的语法转化成更加简单的的语法(对计算机来说),最后得到一个注解过后的抽象语法树

|

||||

4. 通过字节码生成器将经过注解的抽象语法树生成字节码

|

||||

## 2 Java前端编译

|

||||

|

||||

java的前端编译(即javac编译)可分为解析与填充符号表、插入式注解处理器的注解处理、分析与字节码生成等三个过程。

|

||||

|

||||

|

||||

|

||||

|

||||

1. 解析与填充符号表。解析步骤包括词法分析和语法分析两个阶段。词法分析是将源代码的字符流转变为标记(Token)集合, 单个字符是程序编写过程的最小单位, 而标记则是编译过程的最小单位, 关键字、变量名、字面量、运算符都可以成为标记。语法分析是根据Token序列构造抽象语法树的过程, 抽象语法树(AST)是一种用来描述程序代码语法结构的树形表示方式, 语法树的每一个节点都代表着程序代码中的一个语法结构, 如包、类型、修饰符、运算符、接口、返回值都可以是一个语法结构。 符号表是由一组符号地址和符号信息构成的表格。在语法分析中, 符号表所登记的内容将用于语义检查和产生中间代码。在目标代码生成阶段, 符号表是当对符号名进行地址分配时的依据。

|

||||

|

||||

2. 插入式注解处理器。插入式注解处理器可以看做是一组编译器的插件, 在这些插件里面, 可以读取、修改、添加抽象语法树中的任意元素。如果这些插件在处理注解期间对语法数进行了修改, 编译器将回到解析与填充符号表的过程重新处理, 直到所有插入式注解处理器都没有再对语法数进行修改为止, 每一次循环称为一个Round。

|

||||

3. 语义分析与字节码生成。语法分析后, 编译器获得了程序代码的抽象语法树表示, 语法数能表示一个结构正确的源程序的抽象, 但无法保证源程序是符合逻辑的。而语义分析的主要任务是对结构正确的源程序进行上下文有关性质的审查。Javac的编译过程中, 语义分析过程分为标注检查、数据及控制流分析两个步骤。

|

||||

1. 标注检查的内容包括诸如变量使用前是否已被声明、变量与赋值之间的数据类型是否能够匹配等。另外在标注检查步骤中, 还有一个重要的动作称为常量折叠。

|

||||

2. 数据及控制流分析是对程序上下文逻辑更进一步的验证, 他可以检查出诸如程序局部变量在使用前是否有赋值、方法的每条路径是否都有返回值、是否所有的受查异常都被正确处理等问题。

|

||||

|

||||

|

||||

Java中常用的语法糖有泛型、变长参数、自动装箱/拆箱、遍历循环、条件编译等等。虚拟机运行时并不支持这些语法, 它们在编译阶段还原回简单的基础语法结构, 这个过程称为解语法糖。

|

||||

|

||||

字节码生成是Javac编译过程的最后一个阶段, 它将前面各个步骤所生成的信息(语法数、符号表)转化成字节码写到磁盘中, 另外还进行少量的代码添加(如实例构造器)和转换工作。

|

||||

|

||||

## 3 Java中的后端编译

|

||||

在部分商用虚拟机中, Java程序最初是通过解释器进行解释执行的, 当虚拟机发现某个方法或代码块的运行特别频繁时, 就会把这些代码认定为"热点代码"。为了提高热点代码的执行效率, 在运行时, 虚拟机将会把这些代码编译成与本地平台相关的机器码, 并进行各种层析的优化, 完成这个任务的编译器称为即时编译器(JIT编译器)。

|

||||

|

||||

### 编译器与解释器

|

||||

HotSpot虚拟机中内置了两个即时编译器, 分别称为Client Compiler(C1编译器)和Server Compiler(C2编译器)。在HotSpot虚拟机中, 默认采用解释器与其中一个编译器直接配合的方式工作, 程序使用哪个编译器, 取决于虚拟机运行的模式, HotSpot虚拟机会根据自身版本与宿主机器的硬件性能自动选择运行模式, 这种解释器与编译器搭配使用的方式在虚拟机中称为"混合模式"(Mixed Mode)。在个人机器上, 通过java -version命令可查看自己安装的JDK中是哪种模式。

|

||||

|

||||

```sh

|

||||

➜ ~ java -version

|

||||

java version "1.8.0_291"

|

||||

Java(TM) SE Runtime Environment (build 1.8.0_291-b10)

|

||||

Java HotSpot(TM) 64-Bit Server VM (build 25.291-b10, mixed mode)

|

||||

```

|

||||

|

||||

### 分层编译

|

||||

在JDK 1.7的Server模式虚拟机中, 默认开启分层编译的策略。分层编译根据编译器编译、优化的规模与耗时, 划分出不同的编译层次:

|

||||

|

||||

1. 第0层, 程序解释执行, 解释器不开启性能监控功能, 可触发第1层编译。

|

||||

2. 第1层, 也称为C1编译, 将字节码编译为本地代码, 进行简单可靠的优化, 如有必要将加入性能性能监控的逻辑。

|

||||

3. 第2层(或2层以上), 也称为C2编译, 也是将字节码编译为本地代码, 但是会启用一些编译耗时较长的优化, 甚至会根据性能监控信息进行一些不可靠的激进优化。

|

||||

|

||||

实施分层编译后, C1编译器和C2编译器将会同时工作, 用C1编译器获取更高的编译速度, 用C2编译器获取更好的编译质量。

|

||||

|

||||

### 编译对象与触发条件

|

||||

在运行过程中会被即时编译器编译的"热点代码"有如下两类:

|

||||

* 被多次调用的方法。

|

||||

* 被多次执行的循环体。

|

||||

|

||||

对于第一种情况, 编译器会以整个方法作为编译对象, 这种编译也是虚拟机中标准的JIT编译方式。而对于第二种, 尽管编译动作是由循环体所触发的, 但编译器依然会以整个方法(而不是单独的循环体)作为编译对象, 这种编译方式因为编译发生在方法执行过程之中, 因此形象的称之为栈上替换(即OSR编译)。

|

||||

|

||||

### 热点探测

|

||||

|

||||

判断是否需要触发即时编译, 需要先识别出热点代码, 这个行为称之为热点探测。目前主要的热点探测判定方式有以下两种:

|

||||

|

||||

基于采样的热点探测: 虚拟机周期性地检查各个线程的栈顶, 如发现某个方法经常出现在栈顶, 它就是"热点方法"。好处是简单高效, 还可以获取方法调用关系; 缺点是很难精确的确认一个方法的热点, 容易受到线程阻塞或别的外界因素干扰。

|

||||

基于计数器的热点探测: 虚拟机会为每个方法(甚至是代码块)建立计数器, 统计方法的执行次数, 如果执行次数超过一定的阈值就认为是"热点方法"。

|

||||

在HotSpot虚拟机中使用的是第二种————基于计数器的热点探测, 它为每个方法准备了两类计数器: 方法调用计数器和回边计数器。在确定虚拟机运行参数的前提下, 这两个计数器都有一个的确定的阈值, 当计数器超过阈值溢出, 就会触发JIT编译。

|

||||

|

||||

方法调用计数器用于统计方法被调用的次数; 回边计数器用于统计一个方法中循环体代码执行的次数, 在字节码中遇到控制流向后跳转的指令称为"回边"。关于这两种计数器, 读者可参阅<<深入理解Java虚拟机>>, 这里不多做深入分析。

|

||||

|

||||

|

||||

### 编译过程

|

||||

在默认设置下, 无论是方法调用产生的标准JIT编译请求, 还是OSR编译请求, 虚拟机在代码编译器还未完成之前, 都仍然将按照解释方式继续执行, 而编译动作则在后台的编译线程中进行。

|

||||

|

||||

## 4 Java的后端编译优化技术

|

||||

### 公共子表达式消除

|

||||

如果一个表达式E已经计算过了,并且从先前的计算到现在E中所有变量的值都没有发生变化,那E的这次出现就成为了公共子表达式。对于这种表达式, 没必要花时间再对它进行计算, 只需要直接用前面计算过的表达式结果替代E就可以了。

|

||||

|

||||

### 数组边界检查消除

|

||||

顾名思义就是如果编译器根据数据流分析, 访问数组的下标没有越界, 那么就可以消除数组的边界检查, 这样能节省很多的条件判断操作, 提升程序性能。

|

||||

|

||||

### 方法内联

|

||||

内联函数就是在程序编译时,编译器将程序中出现的内联函数的调用表达式用内联函数的函数体来直接进行替换。

|

||||

|

||||

### 逃逸分析

|

||||

逃逸分析的基本行为就是分析对象动态作用域:当一个对象在方法中被定义后,它可能被外部方法所引用,例如作为调用参数传递到其他地方中,称为方法逃逸。甚至还有可能被外部线程访问到,譬如赋值给类变量或可以在其他线程中访问的实例变量,称为线程逃逸。

|

||||

|

||||

如果能证明一个对象不会逃逸到方法或线程外,则可能为这个变量进行一些高效的优化, 如栈上替换、同步消除、标量替换。

|

||||

|

||||

162

Java基础教程/Java语言基础/17 语法糖.md

Normal file

162

Java基础教程/Java语言基础/17 语法糖.md

Normal file

@@ -0,0 +1,162 @@

|

||||

> 参考文献

|

||||

> [](https://blog.csdn.net/ol_beta/article/details/6787234)

|

||||

## 1 Java语法糖

|

||||

|

||||

语法糖(Syntactic Sugar),也叫糖衣语法,是英国计算机科学家彼得·约翰·兰达(Peter J. Landin)发明的一个术语。指的是,在计算机语言中添加某种语法,这种语法能使程序员更方便的使用语言开发程序,同时增强程序代码的可读性,避免出错的机会;但是这种语法对语言的功能并没有影响。

|

||||

|

||||

Java中的泛型,变长参数,自动拆箱/装箱,条件编译等都是语法糖。

|

||||

|

||||

### 泛型

|

||||

|

||||

|

||||

与C#中的泛型相比,Java的泛型可以算是“伪泛型”了。在C#中,不论是在程序源码中、在编译后的中间语言,还是在运行期泛型都是真实存在的。Java则不同,Java的泛型只在源代码存在,只供编辑器检查使用,编译后的字节码文件已擦除了泛型类型,同时在必要的地方插入了强制转型的代码。

|

||||

泛型代码:

|

||||

```java

|

||||

public static void main(String[] args) {

|

||||

List<String> stringList = new ArrayList<String>();

|

||||

stringList.add("oliver");

|

||||

System.out.println(stringList.get(0));

|

||||

}

|

||||

```

|

||||

将上面的代码的字节码反编译后:

|

||||

```java

|

||||

public static void main(String args[])

|

||||

{

|

||||

List stringList = new ArrayList();

|

||||

stringList.add("oliver");

|

||||

System.out.println((String)stringList.get(0));

|

||||

}

|

||||

```

|

||||

|

||||

### 自动拆箱装箱

|

||||

|

||||

自动拆箱/装箱是在编译期,依据代码的语法,决定是否进行拆箱和装箱动作。

|

||||

* 装箱过程:把基本类型用它们对应的包装类型进行包装,使基本类型具有对象特征。

|

||||

* 拆箱过程:与装箱过程相反,把包装类型转换成基本类型。

|

||||

|

||||

|

||||

需要注意的是:

|

||||

1. 包装类型的“==”运算在没有遇到算数运算符的情况下不会自动拆箱,

|

||||

2. 而其包装类型的equals()方法不会处理数据类型转换

|

||||

|

||||

```java

|

||||

Integer a = 1;

|

||||

Integer b = 1;

|

||||

Long c = 1L;

|

||||

System.out.println(a == b);

|

||||

System.out.println(c.equals(a));

|

||||

```

|

||||

|

||||

|

||||

### 循环历遍(foreach)

|

||||

语法:

|

||||

```java

|

||||

List<Integer> list = new ArrayList<Integer>();

|

||||

for(Integer num : list){

|

||||

System.out.println(num);

|

||||

}

|

||||

```

|

||||

Foreach要求被历遍的对象要实现Iterable接口,由此可想而知,foreach迭代也是调用底层的迭代器实现的。反编译上面源码的字节码:

|

||||

```java

|

||||

List list = new ArrayList();

|

||||

Integer num;

|

||||

Integer num;

|

||||

for (Iterator iterator = list.iterator(); iterator.hasNext(); System.out.println(num)){

|

||||

num = (Integer) iterator.next();

|

||||

}

|

||||

```

|

||||

|

||||

### 条件编辑

|

||||

很多编程语言都提供了条件编译的途径,C,C++中使用#ifdef。Java语言并没有提供这种预编译功能,但是Java也能实现预编译。

|

||||

```java

|

||||

if(true){

|

||||

System.out.println("oliver");

|

||||

}else{

|

||||

System.out.println("lee");

|

||||

}

|

||||

```

|

||||

这段代码的字节码反编译后只有一条语句:

|

||||

```java

|

||||

System.out.println("oliver");

|

||||

```

|

||||

在编译器中,将会把分支不成立的代码消除,这一动作发生在编译器解除语法糖阶段。

|

||||

所以说,可以利用条件语句来实现预编译。

|

||||

|

||||

|

||||

|

||||

### 枚举

|

||||

枚举类型其实并不复杂,在JVM字节码文件结构中,并没有“枚举”这个类型。

|

||||

其实源程序的枚举类型,会在编译期被编译成一个普通了类。利用继承和反射,这是完全可以做到的。

|

||||

看下面一个枚举类:

|

||||

|

||||

```java

|

||||

public enum EnumTest {

|

||||

OLIVER,LEE;

|

||||

}

|

||||

```

|

||||

反编译字节码后:

|

||||

```java

|

||||

public final class EnumTest extends Enum {

|

||||

|

||||

private EnumTest(String s, int i) {

|

||||

super(s, i);

|

||||

}

|

||||

|

||||

public static EnumTest[] values() {

|

||||

EnumTest aenumtest[];

|

||||

int i;

|

||||

EnumTest aenumtest1[];

|

||||

System.arraycopy(aenumtest = ENUM$VALUES, 0,

|

||||

aenumtest1 = new EnumTest[i = aenumtest.length], 0, i);

|

||||

return aenumtest1;

|

||||

}

|

||||

|

||||

public static EnumTest valueOf(String s) {

|

||||

return (EnumTest) Enum.valueOf(EnumTest, s);

|

||||

}

|

||||

|

||||

public static final EnumTest OLIVER;

|

||||

public static final EnumTest LEE;

|

||||

private static final EnumTest ENUM$VALUES[];

|

||||

|

||||

static {

|

||||

OLIVER = new EnumTest("OLIVER", 0);

|

||||

LEE = new EnumTest("LEE", 1);

|

||||

ENUM$VALUES = (new EnumTest[] { OLIVER, LEE });

|

||||

}

|

||||

}

|

||||

```

|

||||

至于更多细节,可以参考父类Enum

|

||||

|

||||

|

||||

|

||||

### 变长参数

|

||||

变长参数允许我们传入到方法的参数是不固定个数。

|

||||

对于这个方法:

|

||||

```java

|

||||

public void foo(String str,Object...args){

|

||||

|

||||

}

|

||||

```

|

||||

我们可以这样调用:

|

||||

```java

|

||||

foo("oliver");

|

||||

foo("oliver",new Object());

|

||||

foo("oliver",new Integer(1),"sss");

|

||||

foo("oliver",new ArrayList(),new Object(),true,1);

|

||||

```

|

||||

参数args可以是任意多个。

|

||||

其实,在编译阶段,args是会被编译成Object [] args。

|

||||

```java

|

||||

public transient void foo(String s, Object aobj[])

|

||||

{

|

||||

}

|

||||

```

|

||||

这样,变长参数就可以实现了。

|

||||

但是要注意的是,变长参数必须是方法参数的最后一项。

|

||||

|

||||

|

||||

### 补充

|

||||

除了上面介绍的语法糖,还有内部类,断言以及JDK7的switch支持字符串,自动关闭资源(在try中定义和关闭)等。

|

||||

|

||||

感兴趣的同学可以反编译字节码了解它们的本质。

|

||||

BIN

Java基础教程/Java语言基础/image/2022-08-15-21-55-14.png

Normal file

BIN

Java基础教程/Java语言基础/image/2022-08-15-21-55-14.png

Normal file

Binary file not shown.

|

After Width: | Height: | Size: 63 KiB |

BIN

Java基础教程/Java语言基础/image/2022-08-15-22-21-05.png

Normal file

BIN

Java基础教程/Java语言基础/image/2022-08-15-22-21-05.png

Normal file

Binary file not shown.

|

After Width: | Height: | Size: 49 KiB |

529

kubenets/01.走进Kubernetes.md

Normal file

529

kubenets/01.走进Kubernetes.md

Normal file

@@ -0,0 +1,529 @@

|

||||

# 走进Kubernetes

|

||||

|

||||

|

||||

## 什么是Kubernetes

|

||||

|

||||

随着微服务架构被越来越多的公司使用,大部分单体应用正逐步被拆解成小的、独立运行的微服务。微服务的优势这里不做探讨,但是其带来的服务维护问题大大增加,若想要在管理大量微服务的情况下同时还做到以下几点:

|

||||

|

||||

- 让资源利用率更高

|

||||

|

||||

- 让硬件成本相对更低

|

||||

|

||||

于是就自然而然地就产生了基于容器自动化部署微服务的需求,在容器编排这块的纷争,各大巨头参与,战况惨烈,但最终胜出的是谷歌的Kubernetes[^1],其提供的特性有:

|

||||

|

||||

- **服务发现和负载均衡**

|

||||

- **存储编排**

|

||||

- **自动发布和回滚**

|

||||

- **自愈**

|

||||

- **密钥及配置管理**

|

||||

|

||||

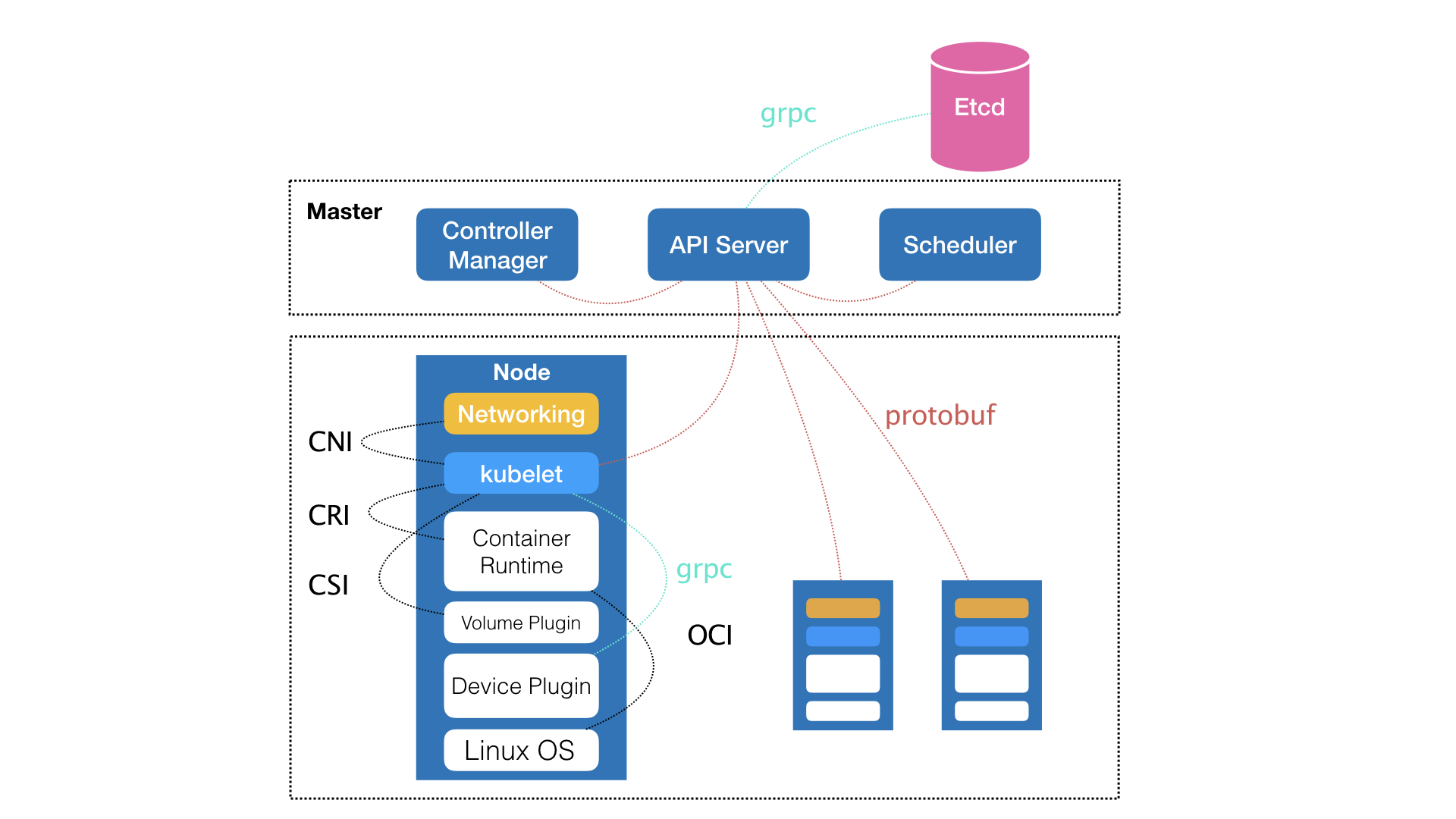

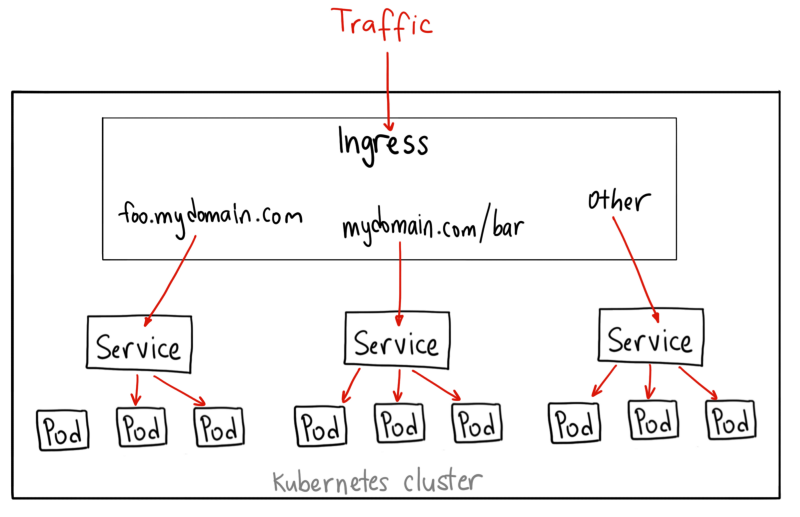

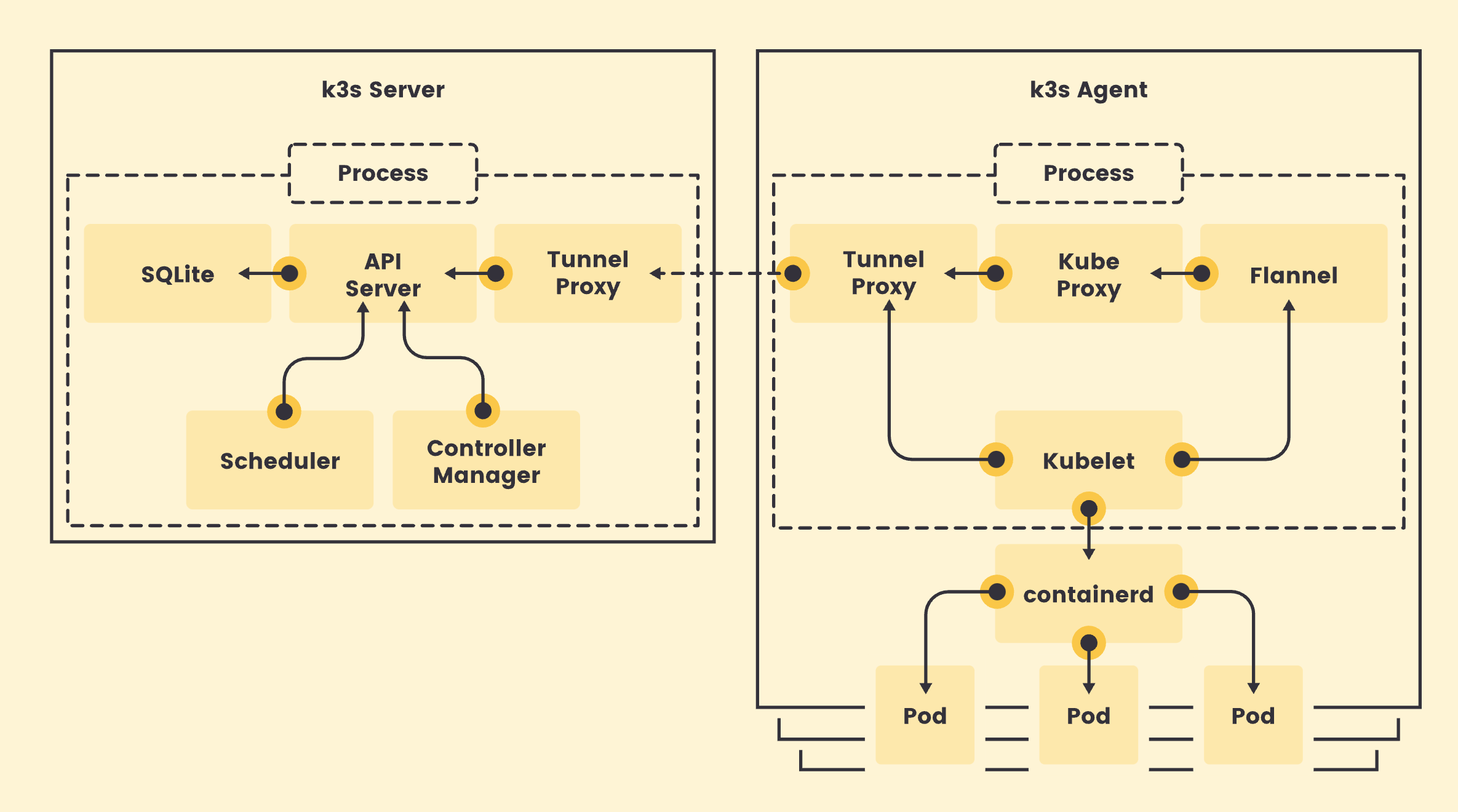

通过下面架构图可以看到其有上下两部分对应的`Master&Node`节点构成,这两种角色分别对应着控制节点和计算节点。

|

||||

|

||||

|

||||

|

||||

> Master控制节点主要出发点在于如何编排、管理、调度用户提交的作业

|

||||

|

||||

Kubernetes控制节点主要由以下几个核心组件组成:

|

||||

|

||||

- etcd保存了整个集群的状态

|

||||

- apiserver提供了资源操作的唯一入口,并提供认证、授权、访问控制、API注册和发现等机制

|

||||

- controller manager负责维护集群的状态,比如故障检测、自动扩展、滚动更新等

|

||||

- scheduler负责资源的调度,按照预定的调度策略将Pod调度到相应的机器上

|

||||

|

||||

对于计算节点:

|

||||

|

||||

- kubelet负责维护容器的生命周期,同时也负责Volume(CSI)和网络(CNI)的管理

|

||||

- Container runtime负责镜像管理以及Pod和容器的真正运行(CRI)

|

||||

- kube-proxy负责为Service提供cluster内部的服务发现和负载均衡

|

||||

|

||||

## 安装

|

||||

|

||||

### 单机安装

|

||||

|

||||

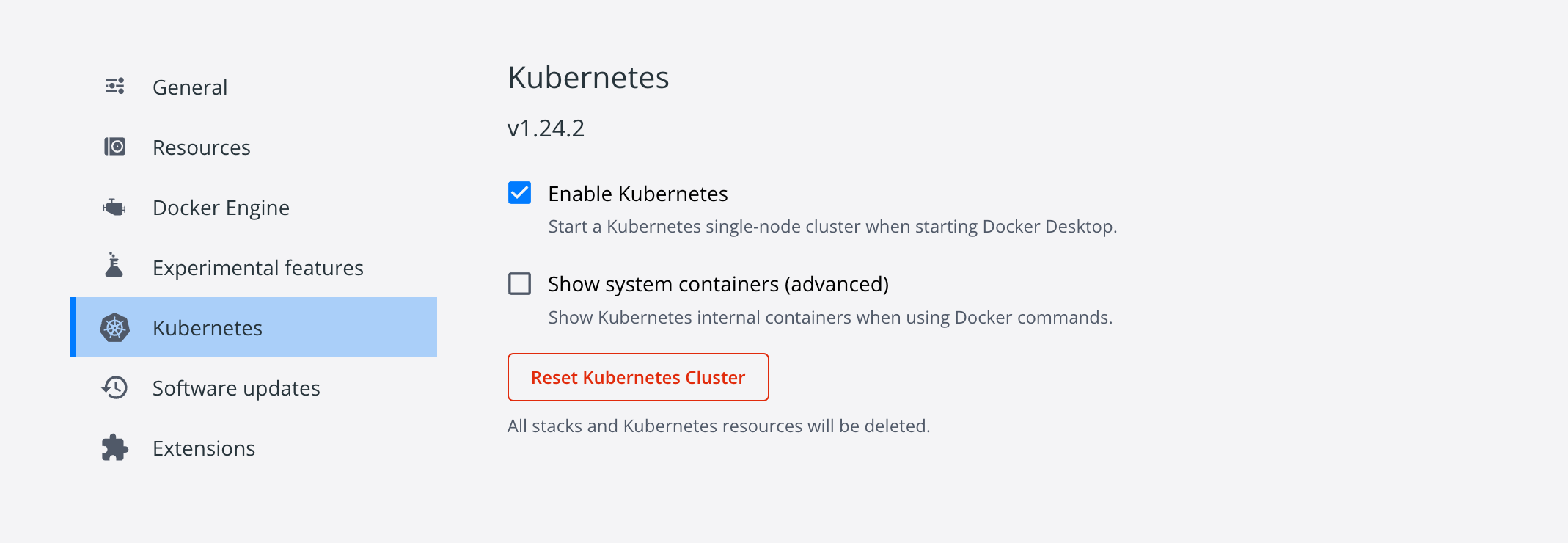

关于单机安装`k8s`,我使用的相关环境如下(于2022-08-13更新):

|

||||

|

||||

- macOS:Monterey 12.4

|

||||

- Docker Desktop Vesion:4.11.1

|

||||

- Kubernetes:v1.24.2

|

||||

|

||||

由于镜像的下载涉及到网络原因,因此这里使用了开源项目[k8s-docker-desktop-for-mac](https://github.com/gotok8s/k8s-docker-desktop-for-mac)来解决这个问题,需要注意的是要修改`images`的相关镜像的版本,要和此时`Kubernetes`配对上才行,比如我设置的是:

|

||||

|

||||

```txt

|

||||

k8s.gcr.io/kube-proxy:v1.24.2=gotok8s/kube-proxy:v1.24.2

|

||||

k8s.gcr.io/kube-controller-manager:v1.24.2=gotok8s/kube-controller-manager:v1.24.2

|

||||

k8s.gcr.io/kube-scheduler:v1.24.2=gotok8s/kube-scheduler:v1.24.2

|

||||

k8s.gcr.io/kube-apiserver:v1.24.2=gotok8s/kube-apiserver:v1.24.2

|

||||

k8s.gcr.io/pause:3.7=gotok8s/pause:3.7

|

||||

k8s.gcr.io/coredns/coredns:v1.8.6=gotok8s/coredns:v1.8.6

|

||||

k8s.gcr.io/etcd:3.5.3-0=gotok8s/etcd:3.5.3-0

|

||||

```

|

||||

|

||||

然后执行`./load_images.sh `即可下载k8s依赖的镜像,随后打开`Docker`,进入设置界面,勾选`Enable Kubernetes`即可:

|

||||

|

||||

|

||||

|

||||

不出意外,界面左下角会出现`Kubernetes running`的提示,这样就安装成功了。

|

||||

|

||||

每个人的 `Docker` 版本都有差别,不同版本如何查找各个依赖容器对应的版本呢?参考一下命令:

|

||||

|

||||

```shell

|

||||

KUBERNETES_VERSION=v1.24.2

|

||||

# Linux 下执行

|

||||

curl -O -L https://storage.googleapis.com/kubernetes-release/release/${KUBERNETES_VERSION}/bin/linux/amd64/kubeadm

|

||||

chmod +x kubeadm

|

||||

./kubeadm config images list --kubernetes-version=${KUBERNETES_VERSION}

|

||||

```

|

||||

|

||||

版本号那里填写你自己的当前版本即可,不出意外可以得到如下输出:

|

||||

|

||||

```shell

|

||||

k8s.gcr.io/kube-apiserver:v1.24.2

|

||||

k8s.gcr.io/kube-controller-manager:v1.24.2

|

||||

k8s.gcr.io/kube-scheduler:v1.24.2

|

||||

k8s.gcr.io/kube-proxy:v1.24.2

|

||||

k8s.gcr.io/pause:3.7

|

||||

k8s.gcr.io/etcd:3.5.3-0

|

||||

k8s.gcr.io/coredns/coredns:v1.8.6

|

||||

```

|

||||

|

||||

查看集群信息:

|

||||

|

||||

```shell

|

||||

kubectl cluster-info

|

||||

```

|

||||

|

||||

输出:

|

||||

|

||||

```shell

|

||||

Kubernetes control plane is running at https://kubernetes.docker.internal:6443

|

||||

CoreDNS is running at https://kubernetes.docker.internal:6443/api/v1/namespaces/kube-system/services/kube-dns:dns/proxy

|

||||

|

||||

To further debug and diagnose cluster problems, use 'kubectl cluster-info dump'.

|

||||

```

|

||||

|

||||

```shell

|

||||

kubectl get nodes

|

||||

```

|

||||

|

||||

输出:

|

||||

|

||||

查看节点信息:

|

||||

|

||||

```shell

|

||||

kubectl get nodes

|

||||

```

|

||||

|

||||

输出:

|

||||

|

||||

```shell

|

||||

NAME STATUS ROLES AGE VERSION

|

||||

docker-desktop Ready control-plane 11m v1.24.2

|

||||

```

|

||||

|

||||

单机版本的`k8s`安装成功!接下来介绍集群安装。

|

||||

|

||||

### 集群安装

|

||||

|

||||

#### 准备

|

||||

|

||||

- 准备三台机器,比如(使用的配置是4核8G,IP换成你自己的):

|

||||

- 192.168.5.91:Master:

|

||||

- 执行:

|

||||

- `hostnamectl set-hostname master`

|

||||

- `echo "127.0.0.1 $(hostname)" >> /etc/hosts`

|

||||

- 192.168.5.92:Node01

|

||||

- 执行:

|

||||

- `hostnamectl set-hostname node01`

|

||||

- `echo "127.0.0.1 $(hostname)" >> /etc/hosts`

|

||||

- 192.168.5.93:Node02

|

||||

- 执行:

|

||||

- `hostnamectl set-hostname node02`

|

||||

- `echo "127.0.0.1 $(hostname)" >> /etc/hosts`

|

||||

|

||||

- Kubernetes版本:v1.19.3

|

||||

- Docker版本:19.03.12

|

||||

|

||||

开始前请检查以下事项:

|

||||

|

||||

- **CentOS 版本**:>= 7.6

|

||||

- **CPU**:>=2

|

||||

- *IP*:互通

|

||||

- 关闭**swap**:`swapoff -a`

|

||||

|

||||

配置国内kubernetes源:

|

||||

|

||||

```shell

|

||||

cat > /etc/yum.repos.d/kubernetes.repo <<EOF

|

||||

[kubernetes]

|

||||

name=Kubernetes

|

||||

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64/

|

||||

enabled=1

|

||||

gpgcheck=1

|

||||

repo_gpgcheck=1

|

||||

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

|

||||

EOF

|

||||

```

|

||||

|

||||

安装相关依赖工具:

|

||||

|

||||

```shell

|

||||

yum install -y kubelet-1.19.3 kubeadm-1.19.3 kubectl-1.19.3

|

||||

# 设置开机启动

|

||||

systemctl enable kubelet.service && systemctl start kubelet.service

|

||||

# 查看状态

|

||||

systemctl status kubelet.service

|

||||

```

|

||||

|

||||

|

||||

|

||||

#### 初始化Master

|

||||

|

||||

在主节点(`192.168.5.91`)执行以下命令:

|

||||

|

||||

```sh

|

||||

export MASTER_IP=192.168.5.91

|

||||

export APISERVER_NAME=apiserver.demo

|

||||

export POD_SUBNET=10.100.0.1/16

|

||||

echo "${MASTER_IP} ${APISERVER_NAME}" >> /etc/hosts

|

||||

```

|

||||

|

||||

新建脚本`init_master.sh`:

|

||||

|

||||

```shell

|

||||

vim init_master.sh

|

||||

```

|

||||

|

||||

添加:

|

||||

|

||||

```bash

|

||||

#!/bin/bash

|

||||

|

||||

# 只在 master 节点执行

|

||||

|

||||

# 脚本出错时终止执行

|

||||

set -e

|

||||

|

||||

if [ ${#POD_SUBNET} -eq 0 ] || [ ${#APISERVER_NAME} -eq 0 ]; then

|

||||

echo -e "\033[31;1m请确保您已经设置了环境变量 POD_SUBNET 和 APISERVER_NAME \033[0m"

|

||||

echo 当前POD_SUBNET=$POD_SUBNET

|

||||

echo 当前APISERVER_NAME=$APISERVER_NAME

|

||||

exit 1

|

||||

fi

|

||||

|

||||

|

||||

# 查看完整配置选项 https://godoc.org/k8s.io/kubernetes/cmd/kubeadm/app/apis/kubeadm/v1beta2

|

||||

rm -f ./kubeadm-config.yaml

|

||||

cat <<EOF > ./kubeadm-config.yaml

|

||||

apiVersion: kubeadm.k8s.io/v1beta2

|

||||

kind: ClusterConfiguration

|

||||

# k8s 版本

|

||||

kubernetesVersion: v1.19.3

|

||||

imageRepository: registry.aliyuncs.com/k8sxio

|

||||

controlPlaneEndpoint: "${APISERVER_NAME}:6443"

|

||||

networking:

|

||||

serviceSubnet: "10.96.0.0/16"

|

||||

podSubnet: "${POD_SUBNET}"

|

||||

dnsDomain: "cluster.local"

|

||||

EOF

|

||||

|

||||

# kubeadm init

|

||||

# 根据您服务器网速的情况,您需要等候 3 - 10 分钟

|

||||

kubeadm config images pull --config=kubeadm-config.yaml

|

||||

kubeadm init --config=kubeadm-config.yaml --upload-certs

|

||||

|

||||

# 配置 kubectl

|

||||

rm -rf /root/.kube/

|

||||

mkdir /root/.kube/

|

||||

cp -i /etc/kubernetes/admin.conf /root/.kube/config

|

||||

|

||||

# 安装 calico 网络插件

|

||||

# 参考文档 https://docs.projectcalico.org/v3.13/getting-started/kubernetes/self-managed-onprem/onpremises

|

||||

echo "安装calico-3.13.1"

|

||||

rm -f calico-3.13.1.yaml

|

||||

wget https://kuboard.cn/install-script/calico/calico-3.13.1.yaml

|

||||

kubectl apply -f calico-3.13.1.yaml

|

||||

```

|

||||

|

||||

如果出错:

|

||||

|

||||

```shell

|

||||

# issue 01

|

||||

# [ERROR FileContent--proc-sys-net-bridge-bridge-nf-call-iptables]: /proc/sys/net/bridge/bridge-nf-call-iptables contents are not set to 1

|

||||

# 所有机器执行

|

||||

echo 1 > /proc/sys/net/bridge/bridge-nf-call-iptables

|

||||

echo 1 > /proc/sys/net/bridge/bridge-nf-call-ip6tables

|

||||

```

|

||||

|

||||

|

||||

|

||||

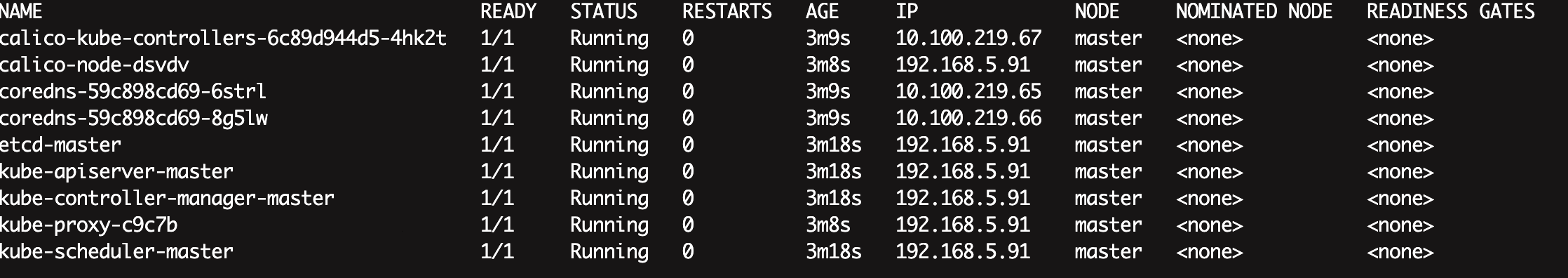

检查`master`初始化结果:

|

||||

|

||||

```shell

|

||||

# 直到所有的容器组处于 Running 状态

|

||||

watch kubectl get pod -n kube-system -o wide

|

||||

# 查看 master 节点初始化结果

|

||||

kubectl get nodes -o wide

|

||||

```

|

||||

|

||||

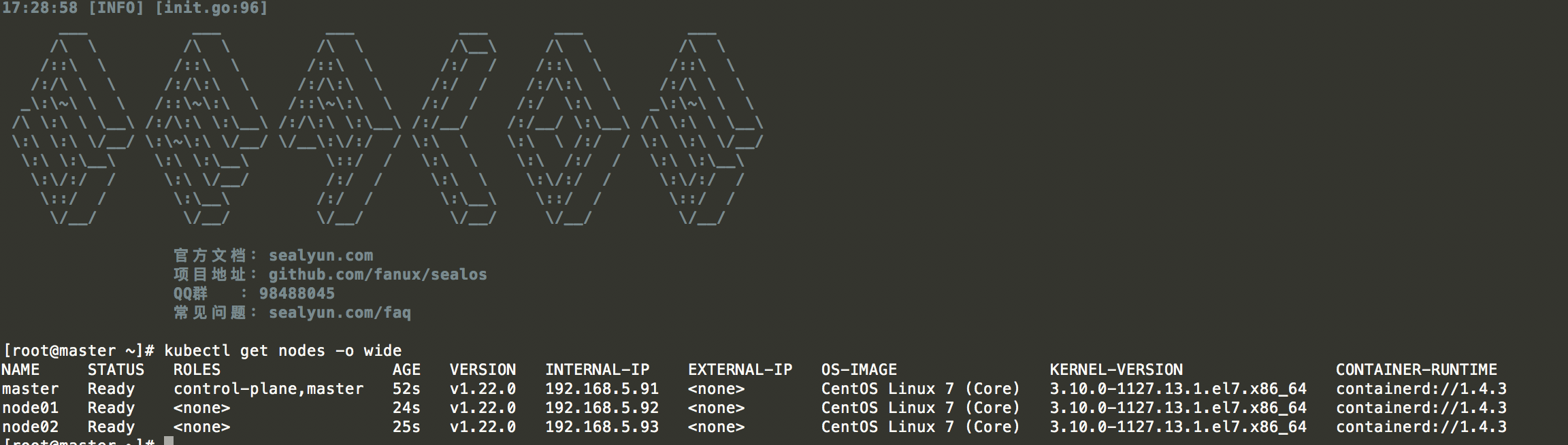

如下图:

|

||||

|

||||

|

||||

|

||||

#### 获得join命令参数

|

||||

|

||||

直接在`master`执行:

|

||||

|

||||

```shell

|

||||

kubeadm token create --print-join-command

|

||||

```

|

||||

|

||||

比如此时输出:

|

||||

|

||||

```shell

|

||||

# 有效期两小时

|

||||

kubeadm join apiserver.demo:6443 --token vh5hl9.9fccw1mzfsmsp4gh --discovery-token-ca-cert-hash sha256:6970397fdc6de5020df76de950c9df96349ca119f127551d109430c114b06f40

|

||||

```

|

||||

|

||||

#### 初始化Node

|

||||

|

||||

在所有`node`执行:

|

||||

|

||||

```shell

|

||||

export MASTER_IP=192.168.5.91

|

||||

export APISERVER_NAME=apiserver.demo

|

||||

echo "${MASTER_IP} ${APISERVER_NAME}" >> /etc/hosts

|

||||

|

||||

# 替换为 master 节点上 kubeadm token create 命令的输出

|

||||

kubeadm join apiserver.demo:6443 --token vh5hl9.9fccw1mzfsmsp4gh --discovery-token-ca-cert-hash sha256:6970397fdc6de5020df76de950c9df96349ca119f127551d109430c114b06f40

|

||||

```

|

||||

|

||||

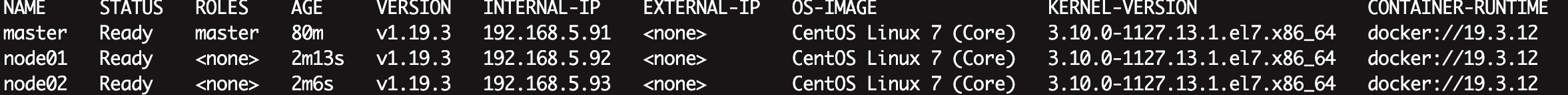

#### 检查初始化结果

|

||||

|

||||

在`master`节点执行:

|

||||

|

||||

```shell

|

||||

kubectl get nodes -o wide

|

||||

```

|

||||

|

||||

输出结果如下:

|

||||

|

||||

|

||||

|

||||

### sealos 快速安装

|

||||

|

||||

经过上面的流程,相信你也能体会到集群部署的麻烦,为了简化这个流程,`Github`上诞生了不少优秀的项目来简化安装流程,接下来以[sealos](https://github.com/fanux/sealos)为例进行命令行一键安装。

|

||||

|

||||

#### 准备

|

||||

|

||||

资源相关以集群安装配置为主,其中集群安装的准备工作也一样做,其他要求如下:

|

||||

|

||||

- ssh 可以访问各安装节点

|

||||

- 各节点主机名不相同,并满足kubernetes的主机名要求。

|

||||

- 各节点时间同步

|

||||

- 网卡名称如果是不常见的,建议修改成规范的网卡名称, 如(eth.*|en.*|em.*)

|

||||

- kubernetes1.20+ 使用containerd作为cri. 不需要用户安装docker/containerd. sealos会安装1.3.9版本containerd。

|

||||

- kubernetes1.19及以下 使用docker作为cri。 也不需要用户安装docker。 sealos会安装1.19.03版本docker

|

||||

|

||||

依赖包:

|

||||

|

||||

```shell

|

||||

yum install socat -y

|

||||

yum remove docker-ce containerd.io -y

|

||||

rm /etc/containerd/config.toml

|

||||

```

|

||||

|

||||

#### 安装

|

||||

|

||||

选一台服务器,我选择安装`v1.22.0`版本,执行命令即可:

|

||||

|

||||

```shell

|

||||

sealos init --passwd 'pwd' --master 192.168.5.91 --node 192.168.5.92 --node 192.168.5.93 --pkg-url /root/kube1.22.0.tar.gz --version v1.22.0

|

||||

```

|

||||

|

||||

#### 检查初始化结果

|

||||

|

||||

在`master`节点执行:

|

||||

|

||||

```shell

|

||||

kubectl get nodes -o wide

|

||||

```

|

||||

|

||||

输出结果如下:

|

||||

|

||||

|

||||

|

||||

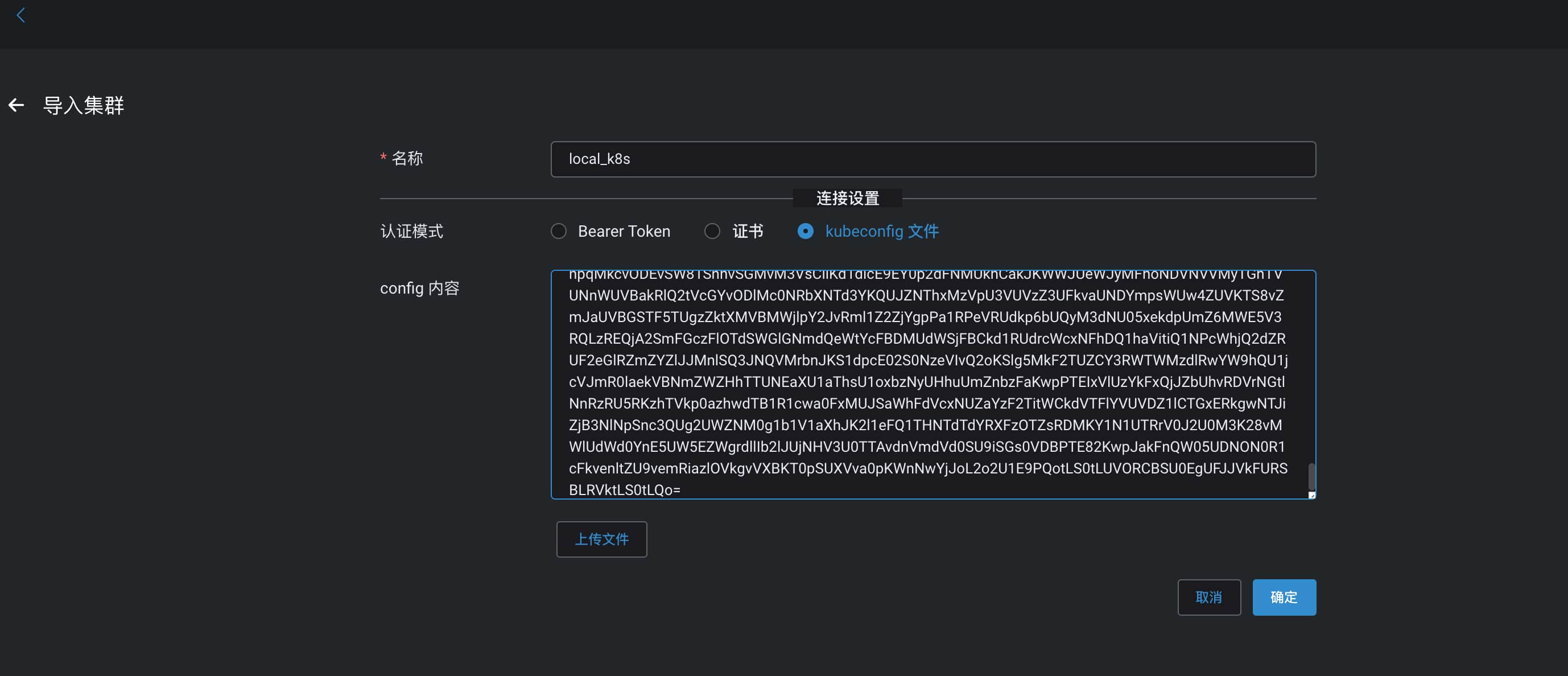

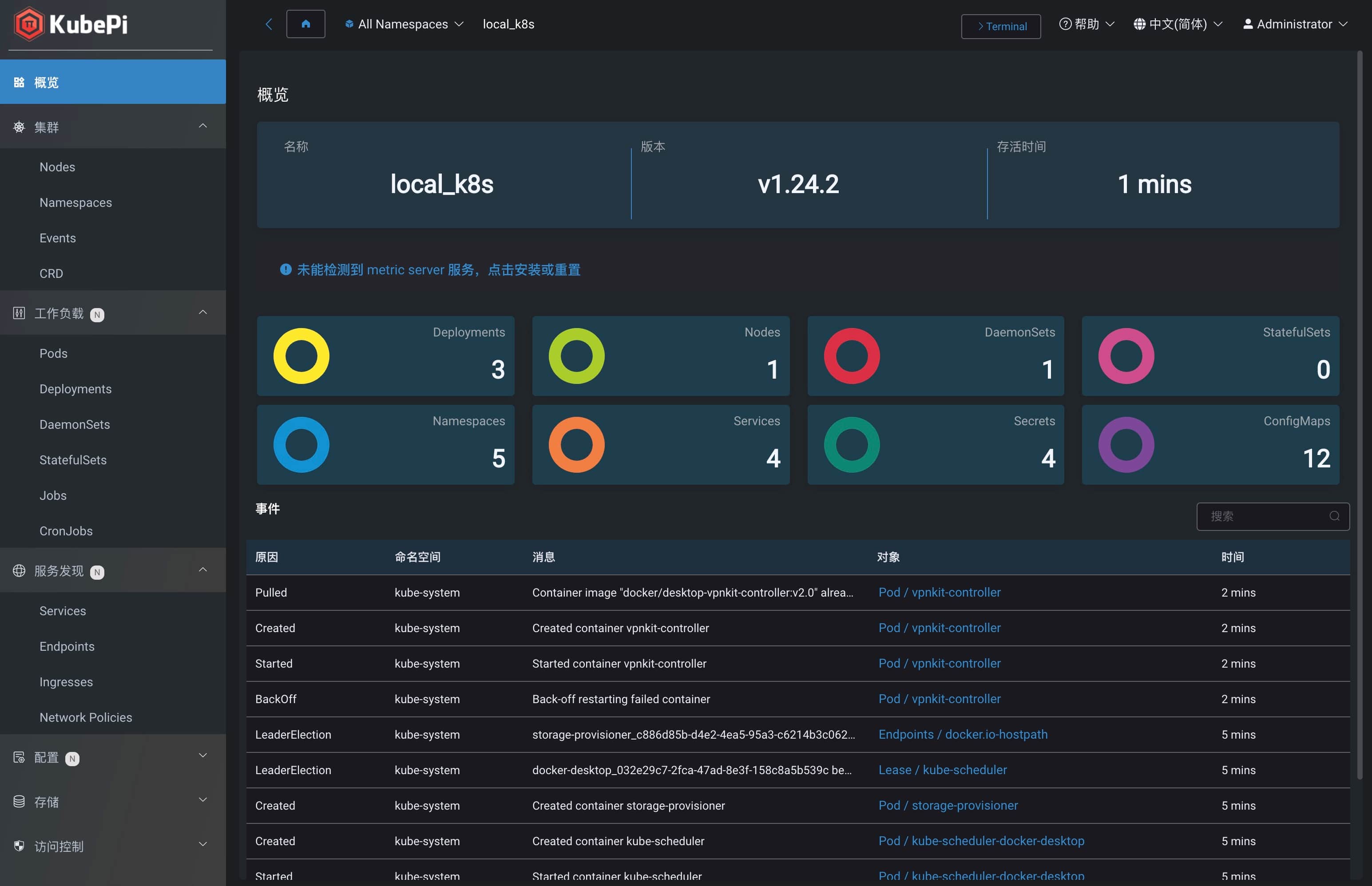

## UI

|

||||

|

||||

### Kubernetes Dashboard

|

||||

|

||||

[Dashboard](https://github.com/kubernetes/dashboard)可以将容器化应用程序部署到`Kubernetes`集群,对容器化应用程序进行故障排除,以及管理集群资源。

|

||||

|

||||

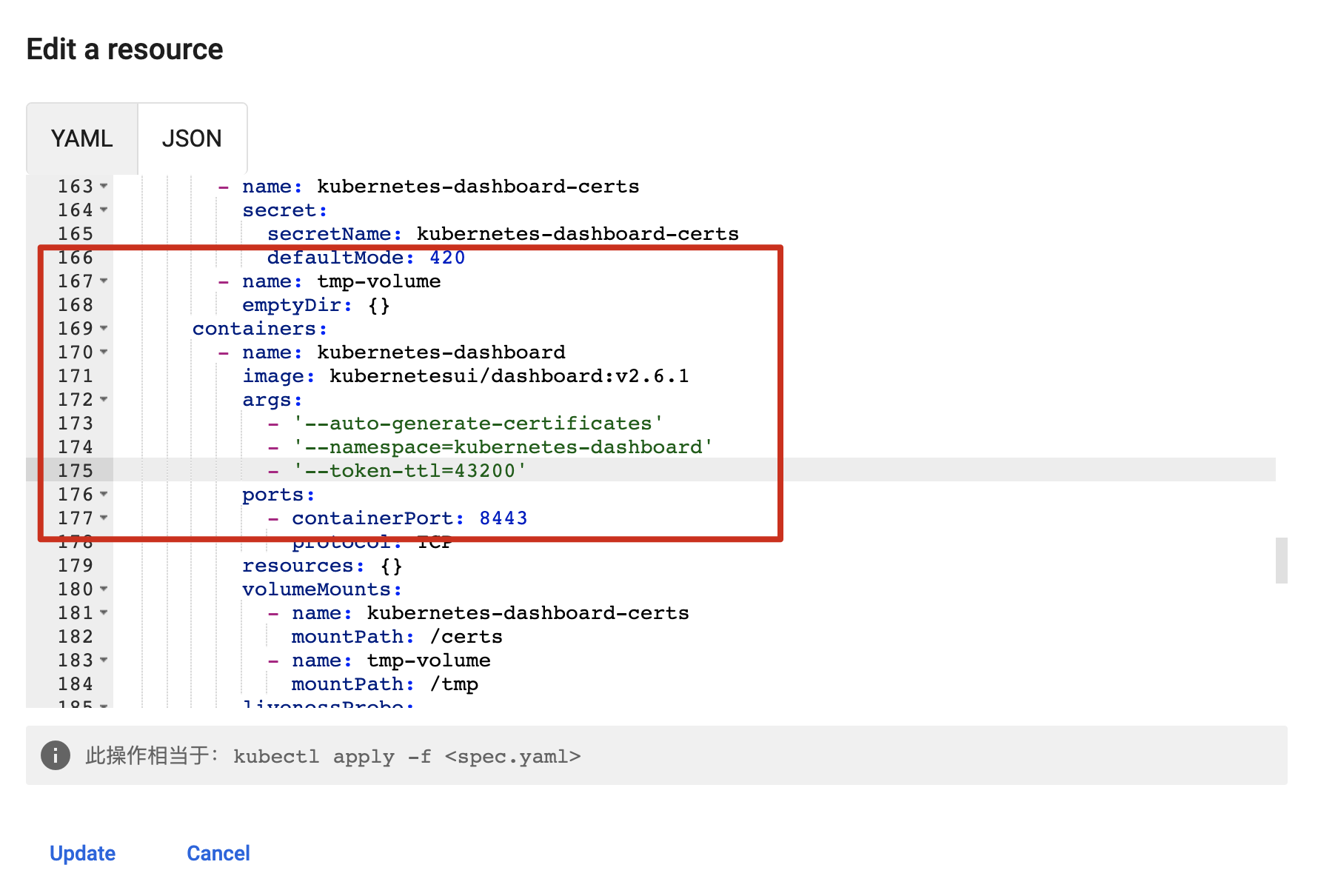

#### 安装

|

||||

|

||||

安装命令如下:

|

||||

|

||||

```shell

|

||||

wget https://raw.githubusercontent.com/kubernetes/dashboard/v2.6.1/aio/deploy/recommended.yaml -O dashboard.yaml

|

||||

|

||||

kubectl apply -f dashboard.yaml

|

||||

kubectl -n kubernetes-dashboard get pods -o wide

|

||||

```

|

||||

|

||||

查看是否成功:

|

||||

|

||||

```shell

|

||||

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

|

||||

dashboard-metrics-scraper-8c47d4b5d-mfb6d 1/1 Running 0 83s 10.1.0.7 docker-desktop <none> <none>

|

||||

kubernetes-dashboard-6c75475678-bdwtn 1/1 Running 0 83s 10.1.0.6 docker-desktop <none> <none>

|

||||

```

|

||||

|

||||

如果执行完发现`STATUS`有`ContainerCreating`,可以查看日志找找原因(注意NAME):

|

||||

|

||||

```shell

|

||||

kubectl describe pod dashboard-metrics-scraper-8c47d4b5d-mfb6d --namespace=kubernetes-dashboard

|

||||

```

|

||||

|

||||

一般都是因为`metrics-scraper:v1.0.8`镜像下载不下来,可以手动执行下载:

|

||||

|

||||

```shell

|

||||

docker pull kubernetesui/metrics-scraper:v1.0.8

|

||||

```

|

||||

|

||||

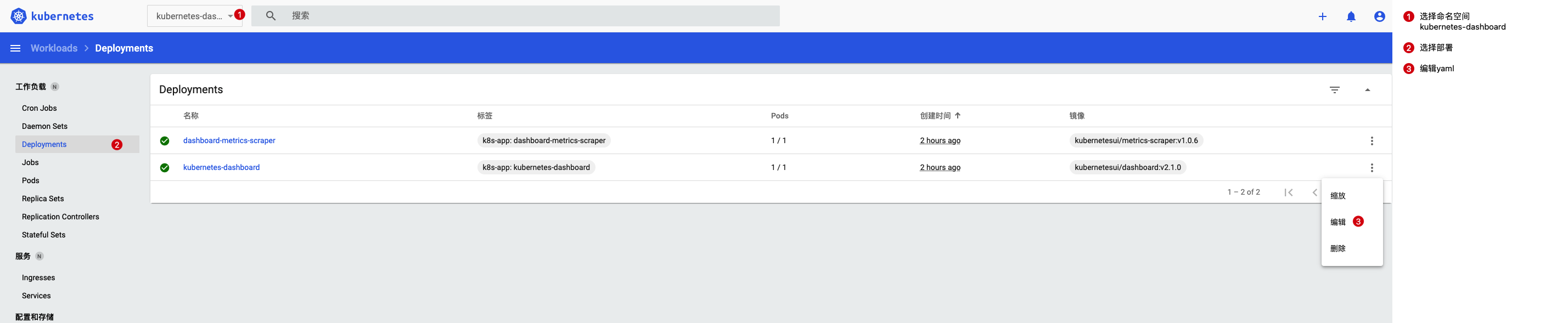

拉下来之后就妥了,还有一个问题就是选用的服务类型是`ClusterIP`(默认类型,服务只能够在集群内部可以访问),所以我们需要将访问形式改为`NodePort`(通过每个 Node 上的 IP 和静态端口访问):

|

||||

|

||||

```shell

|

||||

kubectl --namespace=kubernetes-dashboard edit service kubernetes-dashboard

|

||||

# 将里面的 type: ClusterIP 改为 type: NodePort

|

||||

```

|

||||

|

||||

保存后,执行:

|

||||

|

||||

```shell

|

||||

kubectl --namespace=kubernetes-dashboard get service kubernetes-dashboard

|

||||

```

|

||||

|

||||

终端输出:

|

||||

|

||||

```shell

|

||||

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

|

||||

kubernetes-dashboard NodePort 10.110.197.167 <none> 443:32171/TCP 7m32s

|

||||

```

|

||||

|

||||

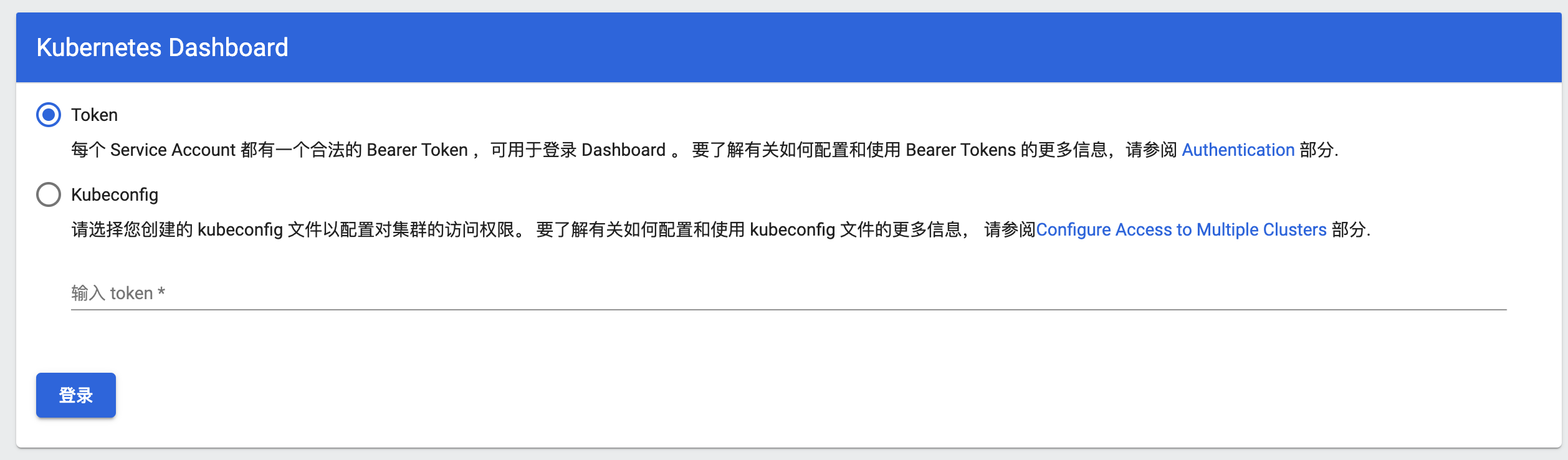

#### Token

|

||||

|

||||

在浏览器访问[https://0.0.0.0:32171/](https://0.0.0.0:32171/):

|

||||

|

||||

|

||||

|

||||

看界面需要生成`Token`:

|

||||

|

||||

```shell

|

||||

vim admin-user.yaml

|

||||

# 输入

|

||||

apiVersion: v1

|

||||

kind: ServiceAccount

|

||||

metadata:

|

||||

name: admin-user

|

||||

namespace: kubernetes-dashboard

|

||||

# 保存退出

|

||||

vim admin-user-role-binding.yaml

|

||||

# 输入

|

||||

apiVersion: rbac.authorization.k8s.io/v1

|

||||

kind: ClusterRoleBinding

|

||||

metadata:

|

||||

name: admin-user

|

||||

roleRef:

|

||||

apiGroup: rbac.authorization.k8s.io

|

||||

kind: ClusterRole

|

||||

name: cluster-admin

|

||||

subjects:

|

||||

- kind: ServiceAccount

|

||||

name: admin-user

|

||||

namespace: kubernetes-dashboard

|

||||

# 保存退出

|

||||

|

||||

# 执行命令加载配置

|

||||

kubectl -n kubernetes-dashboard create -f admin-user.yaml

|

||||

kubectl -n kubernetes-dashboard create -f admin-user-role-binding.yaml

|

||||

|

||||

# 若出现已存在

|

||||

# 执行:kubectl -n kubernetes-dashboard delete -f xxx.yaml 即可

|

||||

```

|

||||

|

||||

获取令牌:

|

||||

|

||||

```shell

|

||||

kubectl -n kubernetes-dashboard create token admin-user

|

||||

```

|

||||

|

||||

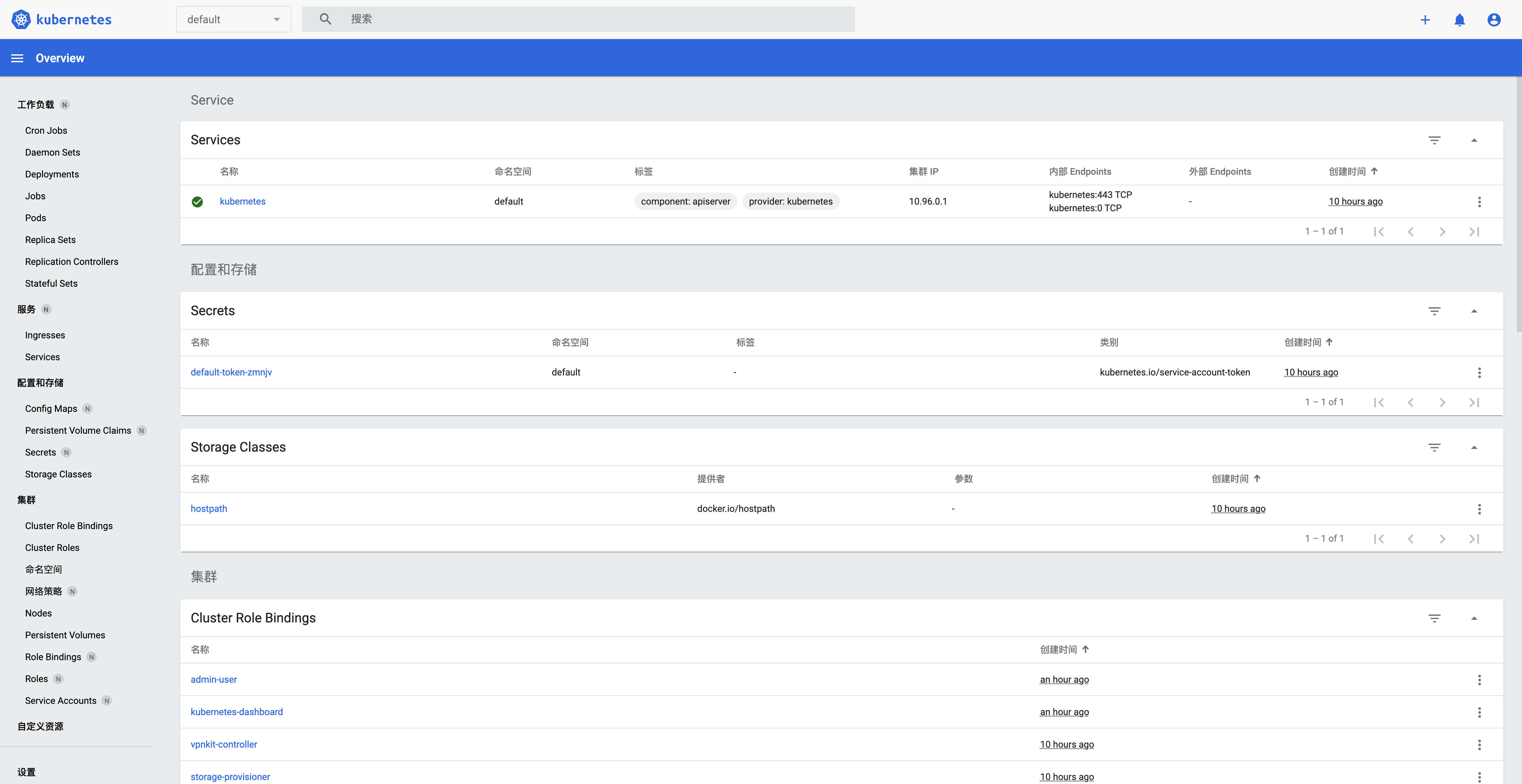

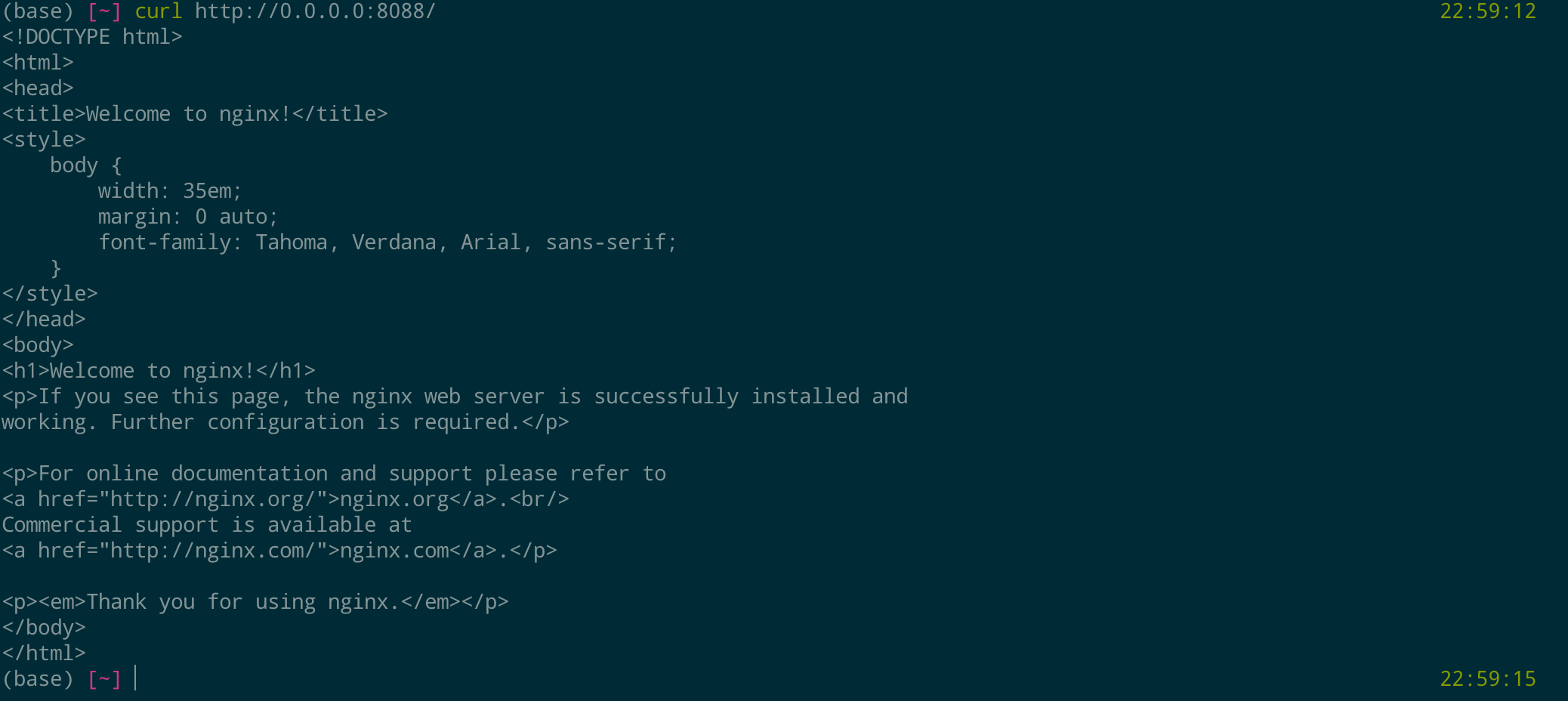

复制`token`到刚才的界面登录即可,登录后界面如下:

|

||||

|

||||

|